2.9: Espacios de probabilidad revisitados

- Page ID

- 152178

En esta sección discutimos los espacios de probabilidad desde el punto de vista más avanzado de la teoría de medidas. Los dos apartados anteriores sobre medidas positivas y existencia y singularidad son requisitos previos. La discusión se divide en dos partes: primero aquellos conceptos que se comparten de manera bastante equitativa entre la teoría de probabilidad y la teoría de medidas generales, y segundo aquellos conceptos que en su mayor parte son únicos de la teoría de probabilidad. En particular, es un error pensar en la teoría de probabilidad como una mera rama de la teoría de medidas. La probabilidad tiene su propia notación, terminología, punto de vista y aplicaciones que la convierten en un tema increíblemente rico por sí mismo.

Conceptos Básicos

Nuestra primera discusión se refiere a temas que fueron discutidos en el apartado de medidas positivas. Entonces no son necesarias pruebas, pero notarás que la notación, y en algunos casos la terminología, es muy diferente.

Definiciones

Ahora podemos dar una definición precisa del espacio de probabilidad, el modelo matemático de un experimento aleatorio.

Un espacio de probabilidad\((S, \mathscr S, \P)\), consta de tres partes esenciales:

- Un conjunto de resultados\(S\).

- A\(\sigma\) -álgebra de eventos\(\mathscr S\).

- Una medida de probabilidad\(\P\) en el espacio muestral\( (S, \mathscr S) \).

A menudo, la notación especial\( (\Omega, \mathscr{F}, \P) \) se usa para un espacio de probabilidad en la literatura; el símbolo\( \Omega \) del conjunto de resultados pretende recordarnos que todos estos son resultados posibles. Sin embargo en este texto, no insistimos en la notación especial, y usamos cualquier notación que parezca más apropiada en un contexto dado.

En probabilidad, las\(\sigma\) álgebras no solo son importantes para fines teóricos y fundacionales, sino que también son importantes para fines prácticos. A\(\sigma\) -álgebra se puede utilizar para especificar información parcial sobre un experimento, un concepto de importancia fundamental. Específicamente, supongamos que\(\mathscr{A}\) es una colección de eventos en el experimento, y que sepamos si\(A\) ocurrió o no para cada uno\(A \in \mathscr{A}\). Entonces de hecho, podemos determinar si\(A\) ocurrió o no para cada uno\(A \in \sigma(\mathscr{A})\), la\(\sigma\) -álgebra generada por\(\mathscr{A}\).

Técnicamente, una variable aleatoria para nuestro experimento es una función medible desde el espacio muestral a otro espacio medible.

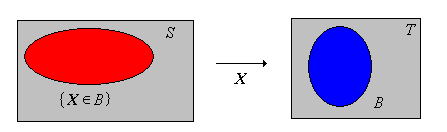

Supongamos que\( (S, \mathscr S, \P) \) es un espacio de probabilidad y ese\( (T, \mathscr T) \) es otro espacio medible. Una variable aleatoria\( X \) con valores adentro\( T \) es una función medible desde\( S \) dentro\( T \).

- La distribución de probabilidad de\( X \) es el mapeo en\( \mathscr T \) dado por\( B \mapsto \P(X \in B) \).

- La colección de eventos\(\{\{X \in B\}: B \in \mathscr T\}\) es un sub\(\sigma\) álgebra de\(\mathscr S\), y es la\(\sigma\) -álgebra generada por\(X\), denotada\(\sigma(X)\).

Detalles

.png)

Si observamos el valor de\(X\), entonces sabemos si cada evento en\(\sigma(X)\) ha ocurrido o no. De manera más general, podemos construir el\( \sigma \) álgebra asociada a cualquier colección de variables aleatorias.

supongamos que\( (T_i, \mathscr T_i) \) es un espacio medible para cada uno\( i \) en un conjunto de índices\( I \), y que\(X_i\) es una variable aleatoria que toma valores\( T_i \) para cada uno\( i \in I \). El\( \sigma \) álgebra generado por\( \{X_i: i \in I\} \) es\[ \sigma\{X_i: i \in I\} = \sigma\left\{\{X \in B_i\}: B_i \in \mathscr T_i, \; i \in I\right\} \]

Si observamos el valor de\(X_i\) para cada uno\(i \in I\) entonces sabemos si cada evento en\(\sigma\{X_i: i \in I\}\) ha ocurrido o no. Esta idea es muy importante en el estudio de los procesos estocásticos.

Eventos nulos, eventos casi seguros y equivalencia

Supongamos que\( (S, \mathscr S, \P) \) es un espacio de probabilidad.

Defina las siguientes colecciones de eventos:

- \(\mathscr{N} = \{A \in \mathscr S: \P(A) = 0\} \), la colección de eventos nulos

- \(\mathscr{M} = \{A \in \mathscr S: \P(A) = 1\}\), la colección de eventos casi seguros

- \( \mathscr{D} = \mathscr{N} \cup \mathscr{M} = \{A \in \mathscr S: \P(A) = 0 \text{ or } \P(A) = 1 \} \), la colección de eventos esencialmente deterministas

La colección de eventos esencialmente deterministas\( \mathscr D \) es un\( \sigma \) subálgebra de\( \mathscr S \).

En el apartado sobre independencia, demostramos que también\( \mathscr{D} \) es una colección de eventos independientes.

Intuitivamente, los eventos equivalentes o variables aleatorias son aquellos que son indistinguibles desde un punto de vista probabilístico. Recordemos primero que la diferencia simétrica entre eventos\( A \) y\( B \) es\( A \bigtriangleup B = (A \setminus B) \cup (B \setminus A) \); es el evento que ocurre si y sólo si ocurre uno de los eventos, pero no el otro, y corresponde a exclusivo o. Aquí está la definición para eventos:

Eventos\(A\) y\(B\) son equivalentes si\( A \bigtriangleup B \in \mathscr{N} \), y denotamos esto por\( A \equiv B \). La relación\( \equiv \) es una relación de equivalencia sobre\( \mathscr S \). Es decir, para\( A, \, B, \, C \in \mathscr S \),

- \(A \equiv A\)(la propiedad reflexiva).

- Si\(A \equiv B\) entonces\(B \equiv A\) (la propiedad simétrica).

- Si\(A \equiv B\) y\(B \equiv C\) entonces\(A \equiv C\) (la propiedad transitiva).

Así\(A \equiv B\) si y sólo si y sólo\(\P(A \bigtriangleup B) = \P(A \setminus B) + \P(B \setminus A) = 0\) si y sólo si\(\P(A \setminus B) = \P(B \setminus A) = 0\). La relación de equivalencia\( \mathscr S \) se\( \equiv \) divide en clases disjuntas de eventos mutuamente equivalentes. La equivalencia se conserva bajo las operaciones establecidas.

Supongamos que\( A, \, B \in \mathscr S \). Si\( A \equiv B \) entonces\( A^c \equiv B^c \).

Supongamos que\( A_i, \, B_i \in \mathscr S \) para\( i \) en un conjunto de índices contables\( I \). Si\( A_i \equiv B_i \) para\( i \in I \) entonces

- \( \bigcup_{i \in I} A_i \equiv \bigcup_{i \in I} B_i \)

- \( \bigcap_{i \in I} A_i \equiv \bigcap_{i \in I} B_i \)

Los eventos equivalentes tienen la misma probabilidad.

Si\( A, \, B \in \mathscr S \) y\(A \equiv B\) entonces\(\P(A) = \P(B)\).

Lo contrario falla trivialmente, y a continuación se da un contraejemplo Sin embargo, los eventos nulos y casi seguros sí forman clases de equivalencia.

Supongamos que\( A \in \mathscr S \).

- Si\(A \in \mathscr{N}\) entonces\(A \equiv B\) si y solo si\(B \in \mathscr{N}\).

- Si\(A \in \mathscr{M}\) entonces\(A \equiv B\) si y solo si\(B \in \mathscr{M}\).

Podemos extender la noción de equivalencia a variables aleatorias tomando valores en un mismo espacio. Así supongamos que\( (T, \mathscr T) \) es otro espacio medible. Si\( X \) y\( Y \) son variables aleatorias con valores en\( T \), entonces\( (X, Y) \) es una variable aleatoria con valores en\( T \times T \), a la que se le da el producto habitual\( \sigma \) -álgebra\( \mathscr T \otimes \mathscr T \). Suponemos que el conjunto diagonal\( D = \{(x, x): x \in T\} \in \mathscr T \otimes \mathscr T \), que casi siempre es cierto en las aplicaciones.

Las variables aleatorias\(X\) y\(Y\) tomar valores en\(T\) son equivalentes si\( \P(X = Y) = 1 \). Nuevamente escribimos\( X \equiv Y \). La relación\( \equiv \) es una relación de equivalencia sobre la colección de variables aleatorias que toman valores\(T\). Es decir, para variables aleatorias\( X \)\( Y \), y\( Z \) con valores en\( T \),

- \(X \equiv X\)(la propiedad reflexiva).

- Si\(X \equiv Y\) entonces\(Y \equiv X\) (la propiedad simétrica).

- Si\( X \equiv Y\) y\(Y \equiv Z\) entonces\(X \equiv Z\) (la propiedad transitiva).

Entonces, la colección de variables aleatorias con valores en\( T \) se divide en clases disjuntas de variables mutuamente equivalentes.

Supongamos que\(X\) y\(Y\) son variables aleatorias que toman valores\(T\) y eso\( X \equiv Y \). Entonces

- \( \{X \in B\} \equiv \{Y \in B\} \)para cada\(B \in \mathscr T\).

- \( X \)y\( Y \) tienen la misma distribución de probabilidad en\( (T, \mathscr T) \).

Nuevamente, lo contrario a la parte (b) falla con pasión, y a continuación se da un contraejemplo. A menudo sucede que una definición para variables aleatorias subsume la definición correspondiente para eventos, al considerar las variables indicadoras de los eventos. Así es con equivalencia.

Supongamos que\(A, \, B \in \mathscr S\). Entonces\(A \equiv B\) si y sólo si\(\bs 1_A \equiv \bs 1_B\).

La equivalencia se conserva bajo una transformación determinista de las variables. Para el siguiente resultado, supongamos que\( (U, \mathscr U) \) es otro espacio medible más, junto con\( (T, \mathscr T) \).

Supongamos que\( X, \, Y \) son variables aleatorias con valores en\( T \) y que\( g: T \to U \) es medible. Si\(X \equiv Y\) entonces\( g(X) \equiv g(Y) \).

Supongamos nuevamente que\( (S, \mathscr S, \P) \) es un espacio de probabilidad correspondiente a un experimento aleatorio. Let\( \mathscr V \) denotar la colección de todas las variables aleatorias de valor real para el experimento, es decir, todas las funciones medibles desde\( S \) dentro\( \R \). Con las definiciones habituales de suma y multiplicación escalar,\( (\mathscr V, +, \cdot) \) es un espacio vectorial. Sin embargo, en la teoría de la probabilidad, muchas veces no queremos distinguir entre variables aleatorias que son equivalentes, por lo que es bueno saber que la estructura del espacio vectorial se conserva cuando identificamos variables aleatorias equivalentes. Formalmente, vamos a\( [X] \) denotar la clase de equivalencia generada por una variable aleatoria de valor real\( X \in \mathscr V \), y vamos a\( \mathscr W \) denotar la colección de todas esas clases de equivalencia. En notación modular,\( \mathscr W\) es el conjunto\(\mathscr V \big/ \equiv \). Definimos suma y multiplicación escalar en\( \mathscr{V} \) por\[ [X] + [Y] = [X + Y], \; c [X] = [c X]; \quad [X], \; [Y] \in \mathscr{V}, \; c \in \R \]

\( (\mathscr W, +, \cdot) \)es un espacio vectorial.

A menudo no nos molestamos en usar la notación especial para la clase de equivalencia asociada a una variable aleatoria. Más bien, se entiende que las variables aleatorias equivalentes representan el mismo objeto. Los espacios de funciones en un espacio de medida general se estudian en el capítulo Distribuciones, y los espacios de variables aleatorias se estudian con más detalle en el capítulo sobre Valor Esperado.

Finalización

Supongamos nuevamente que\( (S, \mathscr S, \P) \) es un espacio de probabilidad, y eso\( \mathscr N \) denota la colección de eventos nulos, como arriba. Supongamos\( A \in \mathscr N \) que para eso\( \P(A) = 0 \). Si\( B \subseteq A \) y\( B \in \mathscr S \), entonces sabemos que\( \P(B) = 0 \) así\( B \in \mathscr{N} \) también. No obstante, en general podría haber subconjuntos de los\( A \) que no están en\( \mathscr S \). Esto lleva naturalmente a la siguiente definición.

El espacio de probabilidad\( (S, \mathscr S, \P) \) es completo si\( A \in \mathscr N \) e\( B \subseteq A \) implica\( B \in \mathscr S \) (y por lo tanto\( B \in \mathscr{N} \)).

Entonces el espacio de probabilidad está completo si cada subconjunto de un evento con probabilidad 0 también es un evento (y por lo tanto también tiene probabilidad 0). Sabemos por nuestro trabajo sobre medidas positivas que cada espacio de medida\( \sigma \) -finita que no esté completo puede ser completado. Entonces, en particular, se puede completar un espacio de probabilidad que no esté completo. Para revisar la construcción, recordemos que la relación de equivalencia\( \equiv \) que usamos anteriormente\( \mathscr S \) se extiende a\( \mathscr{P}(S) \) (el conjunto de potencias de\( S \)).

Para\( A, \, B \subseteq S \), definir\( A \equiv B \) si y sólo si existe\( N \in \mathscr{N} \) tal que\( A \bigtriangleup B \subseteq N \). La relación\( \equiv \) es una relación de equivalencia sobre\( \mathscr{P}(S) \).

Así es como se completa el espacio de probabilidad:

Vamos\( \mathscr S_0 = \{A \subseteq S: A \equiv B \text{ for some } B \in \mathscr S \} \). Para\( A \in \mathscr S_0 \), definir\( \P_0(A) = \P(B) \) dónde\( B \in \mathscr S \) y\( A \equiv B \). Entonces

- \( \mathscr S_0 \)es un\( \sigma \) álgebra de subconjuntos de\( S \) y\( \mathscr S \subseteq \mathscr S_0 \).

- \( \P_0 \)es una medida de probabilidad en\( (S, \mathscr S_0) \).

- \( (S, \mathscr S_0, \P_0) \)está completo, y es la finalización de\( (S, \mathscr S, \P) \).

Espacios de Productos

Nuestra siguiente discusión se refiere a la construcción de espacios probabilísticos que corresponden a distribuciones específicas. Para poner el escenario, supongamos que\( (S, \mathscr S, \P) \) es un espacio de probabilidad. Si dejamos\( X \) denotar la función de identidad encendido\( S \), de modo que\( X(x) = x \) para\( x \in S \), entonces\( \{X \in A\} = A \) para\( A \in \mathscr S \) y por lo tanto\( \P(X \in A) = \P(A) \). Es decir,\( \P \) es la distribución de probabilidad de\( X \). Esto lo hemos visto antes, cada medida de probabilidad puede considerarse como la distribución de una variable aleatoria. El siguiente resultado muestra cómo construir un espacio de probabilidad que corresponda a una secuencia de variables aleatorias independientes con distribuciones especificadas.

Supongamos\( n \in \N_+ \) y ese\( (S_i, \mathscr S_i, \P_i) \) es un espacio de probabilidad para\( i \in \{1, 2, \ldots, n\} \). El espacio de medida del producto correspondiente\( (S, \mathscr S, \P) \) es un espacio de probabilidad. Si\( X_i: S \to S_i \) es la función de coordenada\( i \) th en\( S\) modo que\( X_i(\bs x) = x_i \) para\( \bs x = (x_1, x_2, \ldots, x_n) \in S \) entonces\( (X_1, X_2, \ldots, X_n) \) es una secuencia de variables aleatorias independientes en\( (S, \mathscr{S}, \P) \), y\( X_i \) tiene distribución\( \P_i \) en\( (S_i, \mathscr S_i) \) para cada uno\( i \in \{1, 2, \ldots, n \} \).

Prueba

Por supuesto, la existencia del espacio de producto\( (S, \mathscr S, \P) \) se desprende inmediatamente del resultado más general para productos de espacios de medida positiva. Recordemos que\( S = \prod_{i=1}^n S_i \) y esa\( \mathscr S \) es la\( \sigma \) -álgebra generada por conjuntos de la desde\( \prod_{i=1}^n A_i \) donde\( A_i \in \mathscr S_i \) para cada uno\( i \in \{1, 2, \ldots, n\} \). Por último,\( \P \) es el único sarro positivo en\( (S, \mathscr S) \) satisfacer\[ \P\left(\prod_{i=1}^n A_i\right) = \prod_{i=1}^n \P_i(A_i) \] donde de nuevo,\( A_i \in \mathscr S_i \) para cada uno\( i \in \{1, 2, \ldots, n\} \). Claramente\( \P \) es una medida de probabilidad ya que\( \P(S) = \prod_{i=1}^n \P_i(S_i) = 1 \). Supongamos que\( A_i \in \mathscr S_i \) para\( i \in \{1, 2, \ldots, n\} \). Entonces\( \{X_1 \in A_1, X_2 \in A_2 \ldots, X_n \in A_n\} = \prod_{i=1}^n A_i \in \mathscr S\). De ahí que\[ \P(X_1 \in A_1, X_2 \in A_2, \ldots, X_n \in A_n) = \prod_{i=1}^n \P_i(A_i) \] si arreglamos\( i \in \{1, 2, \ldots, n\} \) y dejamos\( A_j = S_j \) para\( j \ne i \), entonces la ecuación mostrada da\( \P(X_i \in A_i) = \P_i(A_i) \), así\( X_i \) tiene distribución\( \P_i \) encendida\( (S_i, \mathscr S_i) \). Volviendo a la ecuación mostrada tenemos\[ \P(X_1 \in A_1, X_2 \in A_2, \ldots, X_n \in A_n) = \prod_{i=1}^n \P(X_i \in A_i) \] así que\( (X_1, X_2, \ldots, X_n) \) somos independientes.

Intuitivamente, los espacios de probabilidad dados corresponden a experimentos\( n \) aleatorios. El espacio del producto es entonces el espacio de probabilidad que corresponde a los experimentos realizados independientemente. Al modelar un experimento aleatorio, si decimos que tenemos una secuencia finita de variables aleatorias independientes con distribuciones especificadas, podemos estar seguros de que realmente hay un espacio de probabilidad que admita esta declaración

Podemos extender el último resultado a una secuencia infinita de espacios de probabilidad. Supongamos que\( (S_i, \mathscr S_i) \) es un espacio medible para cada uno\( i \in \N_+ \). Recordemos que el espacio del producto\( \prod_{i=1}^\infty S_i \) consiste en todas las secuencias\( \bs x = (x_1, x_2, \ldots) \) tales que\( x_i \in S_i \) para cada una\( i \in \N_+ \). El producto\( \sigma \) -álgebra correspondiente\( \mathscr S \) es generado por la colección de juegos de cilindros. Es decir,\( \mathscr S = \sigma(\mathscr B) \) donde\[ \mathscr{B} = \left\{\prod_{i=1}^\infty A_i: A_i \in \mathscr S_i \text{ for each } i \in \N_+ \text{ and } A_i = S_i \text{ for all but finitely many } i \in \N_+\right\} \]

Supongamos que\( (S_i, \mathscr{S}_i, \P_i) \) es un espacio de probabilidad para\(i \in \N_+ \). Deje\( (S, \mathscr S) \) denotar el espacio medible del producto para que\( \mathscr S = \sigma(\mathscr B) \) donde\( \mathscr B \) esté la colección de juegos de cilindros. Entonces existe una medida de probabilidad única\( \P \) en\( (S, \mathscr S) \) que satisface\[ \P\left(\prod_{i=1}^\infty A_i\right) = \prod_{i=1}^\infty \P_i(A_i), \quad \prod_{i=1}^\infty A_i \in \mathscr B\] Si\( X_i: S \to S_i \) es la función de coordenada\( i \) th on\( S\) for\( i \in \N_+ \), de modo que\( X_i(\bs x) = x_i \) for\( \bs x = (x_1, x_2, \ldots) \in S \), entonces\( (X_1, X_2, \ldots) \) es una secuencia de variables aleatorias independientes on\( (S, \mathscr{S}, \P) \), y\( X_i \) tiene distribución\( \P_i \) encendida\( (S_i, \mathscr S_i) \) para cada uno\( i \in \N_+ \).

Prueba

La prueba es similar a la de los espacios de medida positiva en el apartado sobre existencia y singularidad. Primero recordemos que la colección de juegos de cilindros\( \mathscr B \) es una semiálgebra. Definimos\( \P: \mathscr{B} \to [0, 1] \) como en el enunciado del teorema. Tenga en cuenta que todos menos finitamente muchos factores son 1. Se cumplen las condiciones de consistencia, por lo que se\( \P \) puede extender a una medida de probabilidad sobre el álgebra\( \mathscr A \) generada por\( \mathscr{B} \). Es decir,\( \mathscr A \) es la colección de todas las uniones finitas y disjuntas de los juegos de cilindros. El teorema de extensión estándar y el teorema de singularidad ahora se aplican, por lo que se\( \P\) puede extender de manera única a una medida en\( \mathscr S = \sigma(\mathscr A)\) La prueba de que\( (X_1, X_2, \ldots) \) son independientes y que\( X_i \) tiene distribución\( \P_i \) para cada uno\( i \in \N_+ \) es igual que en el teorema anterior.

Una vez más, si modelamos un proceso aleatorio comenzando con una secuencia infinita de variables aleatorias independientes, podemos estar seguros de que existe un espacio de probabilidad que soporte esta secuencia. El espacio de probabilidad particular construido en el último teorema se denomina espacio de probabilidad canónico asociado a la secuencia de variables aleatorias. Tenga en cuenta también que era importante que tuviéramos medidas de probabilidad en lugar de solo medidas positivas generales en la construcción, ya que el producto infinito siempre\( \prod_{i=1}^\infty \P_i(A_i) \) está bien definido. La siguiente sección sobre Procesos Estocásticos continúa la discusión de cómo construir espacios de probabilidad que correspondan a una colección de variables aleatorias con propiedades de distribución especificadas.

Conceptos de probabilidad

Nuestra siguiente discusión se refiere a temas que son exclusivos de la teoría de la probabilidad y que no tienen analogías simples en la teoría de medidas generales.

Independencia

Como es habitual, supongamos que\( (S, \mathscr S, \P) \) es un espacio de probabilidad. Ya hemos estudiado la independencia de colecciones de eventos y la independencia de colecciones de variables aleatorias. Un tratamiento más completo y general resulta si definimos la independencia de colecciones de colecciones de eventos, y lo más importante, la independencia de colecciones de\( \sigma \) álgebras. Esta extensión en realidad ya ocurrió, cuando pasamos de la independencia de una colección de eventos a la independencia de una colección de variables aleatorias, pero no la notamos en ese momento. A pesar de las capas de la teoría de conjuntos, la idea básica es la misma.

Supongamos que\( \mathscr{A}_i \) es una colección de eventos para cada uno\( i \) en un conjunto de índices\( I \). Entonces\( \mathscr{A} = \{\mathscr{A}_i: i \in I\} \) es independiente si y solo si por cada elección de\( A_i \in \mathscr{A}_i \) for\( i \in I \), la colección de eventos\(\{ A_i: i \in I\} \) es independiente. Es decir, por cada finito\(J \subseteq I \),\[ \P\left(\bigcap_{j \in J} A_j\right) = \prod_{j \in J} \P(A_j) \]

Como se señaló anteriormente, la independencia de las variables aleatorias, como definimos anteriormente, es un caso especial de nuestra nueva definición.

Supongamos que\( (T_i, \mathscr T_i) \) es un espacio medible para cada uno\( i \) en un conjunto de índices\( I \), y que\( X_i \) es una variable aleatoria que toma valores en un conjunto\( T_i \) para cada uno\( i \in I \). La independencia de\( \{X_i: i \in I\} \) es equivalente a la independencia de\( \{\sigma(X_i): i \in I\} \).

La independencia de los acontecimientos es también un caso especial de la nueva definición, y así nuestra nueva definición realmente subsume a la anterior.

Supongamos que\( A_i \) es un evento para cada uno\( i \in I \). La independencia de\( \{A_i: i \in I\} \) equivale a la independencia de\( \{\mathscr{A}_i: i \in I\} \) dónde\( \mathscr{A}_i = \sigma\{A_i\} = \{S, \emptyset, A_i, A_i^c\} \) para cada uno\( i \in I \).

Por cada colección de objetos que hemos considerado (colecciones de eventos, colecciones de variables aleatorias, colecciones de colecciones de eventos), la noción de independencia tiene la propiedad básica de herencia.

Supongamos que\( \mathscr{A} \) es una colección de colecciones de eventos.

- Si\( \mathscr{A} \) es independiente entonces\( \mathscr{B} \) es independiente para cada\( \mathscr{B} \subseteq \mathscr{A} \).

- Si\( \mathscr{B} \) es independiente para cada finito\( \mathscr{B} \subseteq \mathscr{A} \) entonces\( \mathscr{A} \) es independiente.

Nuestras colecciones más importantes son\( \sigma \) -álgebras, por lo que estamos más interesados en la independencia de una colección de\( \sigma \) -álgebras. El siguiente resultado nos permite pasar de la independencia de ciertos tipos de colecciones a la independencia de las\( \sigma \) -álgebras generadas por estas colecciones. Para entender el resultado, deberá revisar las definiciones y teoremas relativos a\( \pi \) -sistemas y\( \lambda \) -sistemas. La prueba utiliza el\( \lambda \) teorema de\( \pi \) Dynkin, llamado así por Eugene Dynkin.

Supongamos que\( \mathscr{A}_i \) es una colección de eventos para cada uno\( i \) en un conjunto de índices\( I \), y que\( \mathscr{A_i} \) es un\( \pi \) -sistema para cada uno\( i \in I \). Si\( \left\{\mathscr{A}_i: i \in I\right\} \) es independiente, entonces\( \left\{\sigma(\mathscr{A}_i): i \in I\right\} \) es independiente.

Prueba

A la luz del resultado anterior, basta con considerar un conjunto finito de colecciones. Así, supongamos que eso\( \{\mathscr{A}_1, \mathscr{A}_2, \ldots, \mathscr{A}_n\} \) es independiente. Ahora,\( A_i \in \mathscr{A}_i \) arregla\( i \in \{2, 3, \ldots, n\} \) y deja\( E = \bigcap_{i=2}^n A_i \). Vamos\( \mathscr{L} = \{B \in \mathscr S: \P(B \cap E) = \P(B) \P(E)\} \). Trivialmente\( S \in \mathscr{L} \) desde\( \P(S \cap E) = \P(E) = \P(S) \P(E) \). Siguiente supongamos eso\( A \in \mathscr{L} \). Entonces\[ \P(A^c \cap E) = \P(E) - \P(A \cap E) = \P(E) - \P(A) \P(E) = [1 - \P(A)] \P(E) = \P(A^c) \P(E) \] Así\( A^c \in \mathscr{L} \). Por último, supongamos que\( \{A_j: j \in J\} \) es una colección contable de conjuntos disjuntos en\( \mathscr{L} \). Entonces\[ \P\left[\left(\bigcup_{j \in J} A_j \right) \cap E \right] = \P\left[ \bigcup_{j \in J} (A_j \cap E) \right] = \sum_{j \in J} \P(A_j \cap E) = \sum_{j \in J} \P(A_j) \P(E) = \P(E) \sum_{j \in J} \P(A_j) = \P(E) \P\left(\bigcup_{j \in J} A_j \right) \] Por lo tanto\( \bigcup_{j \in J} A_j \in \mathscr{L} \) y así\( \mathscr{L} \) es un\( \lambda \) -sistema. Trivialmente\( \mathscr{A_1} \subseteq \mathscr{L} \) por la asunción original de la independencia, así por el\( \pi \) -\( \lambda \) teorema,\( \sigma(\mathscr{A}_1) \subseteq \mathscr{L} \). Así, tenemos eso para todos\( A_1 \in \sigma(\mathscr{A}_1) \) y\( A_i \in \mathscr{A}_i \) para\( i \in \{2, 3, \ldots, n\} \),\[ \P\left(\bigcap_{i=1}^n A_i \right) = \prod_{i=1}^n \P(A_i) \] Así hemos demostrado que\( \left\{\sigma(\mathscr{A}_1), \mathscr{A}_2, \ldots, \mathscr{A}_n\right\} \) es independiente. Repitiendo el argumento veces\( n - 1 \) adicionales, obtenemos que\( \{\sigma(\mathscr{A}_1), \sigma(\mathscr{A}_2), \ldots, \sigma(\mathscr{A}_n)\} \) es independiente.

El siguiente resultado es una declaración rigurosa de la fuerte independencia que implica la independencia de una colección de eventos.

Supongamos que\( \mathscr{A} \) es una colección independiente de eventos, y que\( \left\{\mathscr{B}_j: j \in J\right\} \) es una partición de\( \mathscr{A} \). Es decir,\( \mathscr{B}_j \cap \mathscr{B}_k = \emptyset \) para\( j \ne k \) y\( \bigcup_{j \in J} \mathscr{B}_j = \mathscr{A} \). Entonces\( \left\{\sigma(\mathscr{B}_j): j \in J\right\} \) es independiente.

Prueba

Dejar\( \mathscr{B}_j^* \) denotar el conjunto de todas las intersecciones finitas de conjuntos en\( \mathscr{B}_j \), para cada uno\( j \in J \). Entonces claramente\( \mathscr{B}_j^* \) es un\( \pi \) -sistema para cada uno\( j \), y\( \left\{\mathscr{B}_j^*: j \in J\right\} \) es independiente. Por el teorema anterior,\( \left\{\sigma(\mathscr{B}_j^*): j \in J\right\} \) es independiente. Pero claramente\( \sigma(\mathscr{B}_j^*) = \sigma(\mathscr{B}_j) \) para\( j \in J \).

Vamos a llevar el resultado a la tierra. Supongamos que\( A, B, C, D \) son eventos independientes. En nuestra discusión elemental sobre la independencia, se le pidió que demostrara, por ejemplo, eso\( A \cup B^c \) y\( C^c \cup D^c \) sea independiente. Esto es consecuencia de la afirmación mucho más fuerte de que las\( \sigma \) -álgebras\( \sigma\{A, B\} \) y\( \sigma\{C, D\} \) son independientes.

Intercambiabilidad

Como es habitual, supongamos que\( (S, \mathscr S, \P) \) es un espacio de probabilidad correspondiente a un experimento aleatorio En términos generales, una secuencia de eventos o una secuencia de variables aleatorias es intercambiable si la ley de probabilidad que gobierna la secuencia no cambia cuando se cambia el orden de los eventos o variables. Las variables intercambiables surgen naturalmente en experimentos de muestreo y muchos otros entornos, y son una generalización natural de una secuencia de variables independientes, distribuidas idénticamente (IID). Por el contrario, resulta que cualquier secuencia intercambiable de variables puede construirse a partir de una secuencia IID. Primero damos la definición para eventos:

Supongamos que\(\mathscr A = \{A_i: i \in I\}\) es una colección de eventos, donde\(I\) es un conjunto de índices no vacíos. Entonces\( \mathscr A \) es intercambiable si la probabilidad de la intersección de un número finito de los eventos depende únicamente del número de eventos. Es decir, si\(J\) y\(K\) son subconjuntos finitos de\(I\) y\(\#(J) = \#(K)\) luego\[\P\left( \bigcap_{j \in J} A_j\right) = \P \left( \bigcap_{k \in K} A_k\right)\]

La intercambiabilidad tiene la misma propiedad de herencia básica que hemos visto antes.

Supongamos que\(\mathscr A\) es una colección de eventos.

- Si\(\mathscr A \) es intercambiable entonces\(\mathscr B\) es intercambiable por cada\(\mathscr B \subseteq \mathscr A\).

- Por el contrario, si\(\mathscr B\) es intercambiable por cada finito\(\mathscr B \subseteq \mathscr A\) entonces\(\mathscr A\) es intercambiable.

Para una colección de eventos intercambiables, la ley de exclusión de inclusión para la probabilidad de una unión es mucho más simple que la versión general.

Supongamos que\(\{A_1, A_2, \ldots, A_n\}\) es una colección intercambiable de eventos. Para\(J \subseteq \{1, 2, \ldots, n\}\) con\(\#(J) = k\), vamos\(p_k = \P\left( \bigcap_{j \in J} A_j\right)\). Entonces\[\P\left(\bigcup_{i = 1}^n A_i\right) = \sum_{k=1}^n (-1)^{k-1} \binom{n}{k} p_k\]

Prueba

La regla de inclusión-exclusión da\[\P \left( \bigcup_{i \in I} A_i \right) = \sum_{k = 1}^n (-1)^{k - 1} \sum_{J \subseteq I, \; \#(J) = k} \P \left( \bigcap_{j \in J} A_j \right)\] Pero\(p_k = \P\left( \bigcap_{j \in J} A_j\right)\) para cada uno\( J \subseteq \{1, 2, \ldots, n\} \) con\( \#(J) = k \), y hay\( \binom{n}{k} \) tales subconjuntos.

El concepto de capacidad de intercambio puede extenderse a variables aleatorias de forma natural. Supongamos que\( (T, \mathscr T) \) es un espacio medible.

Supongamos que\(\mathscr A \) es una colección de variables aleatorias, cada una tomando valores\(T\). La colección\(\mathscr A\) es intercambiable si por alguna\(\{X_1, X_2, \ldots, X_n\} \subseteq \mathscr A \), la distribución del vector aleatorio\((X_1, X_2, \ldots, X_n)\) depende únicamente de\(n\).

Así, la distribución del vector aleatorio no cambia si se permutan las coordenadas. Una vez más, la intercambiabilidad tiene la misma propiedad de herencia básica que una colección de variables independientes.

Supongamos que\(\mathscr{A}\) es una colección de variables aleatorias, cada una tomando valores\( T \).

- Si\(\mathscr A\) es intercambiable entonces\(\mathscr B\) es intercambiable por cada\(\mathscr B \subseteq \mathscr A\).

- Por el contrario, si\(\mathscr B\) es intercambiable por cada finito\(\mathscr B \subseteq \mathscr A\) entonces\(\mathscr A\) es intercambiable.

Supongamos que\( \mathscr A \) es una colección de variables aleatorias, cada una tomando valores\( T \), y que\( \mathscr A \) es intercambiable. Entonces trivialmente las variables se distribuyen de manera idéntica: si\( X, \, Y \in \mathscr A \) y\( A \in \mathscr T \), entonces\( \P(X \in A) = \P(Y \in A) \). Además, la definición de variables intercambiables subsume la definición de eventos:

Supongamos que\(\mathscr A\) es una colección de eventos, y vamos a\(\mathscr B = \{\bs 1_A: A \in \mathscr A \}\) denotar la colección correspondiente de variables aleatorias indicadoras. Entonces\(\mathscr A\) es intercambiable si y solo si\(\mathscr B\) es intercambiable.

Eventos y variables de cola

Supongamos nuevamente que tenemos un experimento aleatorio modelado por un espacio de probabilidad\( (S, \mathscr S, \P) \).

Supongamos que\((X_1, X_2, \ldots)\) se trata de una secuencia de variables aleatorias. El álgebra sigma de cola de la secuencia es\[ \mathscr T = \bigcap_{n=1}^\infty \sigma\{X_n, X_{n+1}, \ldots\} \]

- Un evento\(B \in \mathscr T\) es un evento de cola para la secuencia.

- Una variable aleatoria\( Y \) que es medible con respecto a\( \mathscr T \) es una variable aleatoria de cola para la secuencia.

Informalmente, un evento de cola (variable aleatoria) es un evento (variable aleatoria) que se puede definir en términos de\(\{X_n, X_{n+1}, \ldots\}\) para cada uno\(n \in \N_+\). El álgebra sigma de cola para una secuencia de eventos\( (A_1, A_2, \ldots) \) se define análogamente (o simplemente dejar\(X_k = \bs{1}(A_k)\), la variable indicadora de\(A\), para cada uno\(k\)). Para los siguientes resultados, es posible que deba revisar algunas de las definiciones en la sección Convergencia.

Supongamos que\((A_1, A_2, \ldots)\) es una secuencia de eventos.

- Si la secuencia está aumentando entonces\(\lim_{n \to \infty} A_n = \bigcup_{n=1}^\infty A_n\) es un evento cola de la secuencia.

- Si la secuencia es decreciente entonces\(\lim_{n \to \infty} A_n = \bigcap_{n=1}^\infty A_n\) es un evento cola de la secuencia.

Prueba

- Si la secuencia va en aumento entonces\( \bigcup_{n=1}^\infty A_n = \bigcup_{n=k}^\infty A_n \in \sigma\{A_k, A_{k+1}, \ldots\}\) para cada\( k \in \N_+ \).

- Si la secuencia es decreciente entonces\( \bigcap_{n=1}^\infty A_n = \bigcap_{n=k}^\infty A_k \in \sigma\{A_k, A_{k+1}, \ldots\} \) para cada\( k \in \N_+ \)

Supongamos nuevamente que\( (A_1, A_2, \ldots) \) es una secuencia de eventos. Cada uno de los siguientes es un evento de cola de la secuencia:

- \(\limsup_{n \to \infty} A_n = \bigcap_{n=1}^\infty \bigcup_{i=n}^\infty A_i\)

- \(\liminf_{n \to \infty} A_n = \bigcup_{n=1}^\infty \bigcap_{i=n}^\infty A_i\)

Prueba

- Los eventos\( \bigcup_{i=n}^\infty A_i \) están disminuyendo en\( n \) y\( \limsup_{n \to \infty} A_n = \lim_{n \to \infty} \bigcup_{i=n}^\infty A_i \in \mathscr T \) por lo tanto por el resultado anterior.

- Los eventos\( \bigcap_{i=n}^\infty A_i \) están aumentando en\( n \) y\( \liminf_{n \to \infty} A_n = \lim_{n \to \infty} \bigcap_{i=n}^\infty A_i \in \mathscr T \) por lo tanto por el resultado anterior.

Supongamos que\( \bs X = (X_1, X_2, \ldots) \) es una secuencia de variables aleatorias de valor real.

- \(\{X_n \text{ converges as } n \to \infty\}\)es un evento de cola para\( \bs X \).

- \( \liminf_{n \to \infty} X_n \)es una variable aleatoria de cola para\( \bs X \).

- \( \limsup_{n \to \infty} X_n \)es una variable aleatoria de cola para\( \bs X \).

Prueba

- El criterio de convergencia de Cauchy (llamado así por Augustin Cauchy por supuesto) establece que\( X_n \) converge como\( n \to \infty \) si un solo si por cada\( \epsilon > 0 \) existe\( N \in \N_+ \) (dependiendo de\( \epsilon \)) tal que si\(m, \, n \ge N \) entonces\( \left|X_n - X_m\right| \lt \epsilon \). En este criterio, podemos sin pérdida de generalidad tomar\( \epsilon \) para ser racionales, y por un hecho\( k \in \N_+ \) podemos insistir en eso\( m, \, n \ge k \). Con estas restricciones, el criterio de Cauchy es una intersección contable de eventos, cada uno de los cuales se encuentra en\( \sigma\{X_k, X_{k+1}, \ldots\} \).

- Recordemos eso\( \liminf_{n \to \infty} X_n = \lim_{n \to \infty} \inf\{X_k: k \ge n\} \).

- De igual manera, recordemos eso\( \limsup_{n \to \infty} X_n = \lim_{n \to \infty} \sup\{X_k: k \ge n\} \).

La variable aleatoria en la parte (b) puede tomar el valor\( -\infty \), y la variable aleatoria en (c) puede tomar el valor\( \infty \). De las partes (b) y (c) juntas, tenga en cuenta que si\( X_n \to X_\infty \) como\( n \to \infty \) en el espacio de muestra\( \mathscr S \), entonces\( X_\infty \) es una variable aleatoria de cola para\( \bs X \).

Hay una serie de leyes cero-uno en probabilidad. Se trata de teoremas que dan condiciones bajo las cuales un evento será esencialmente determinista; es decir, tener probabilidad 0 o probabilidad 1. Curiosamente, a veces puede ser difícil determinar cuál de estos extremos es realmente el caso. El siguiente resultado es la ley de Kolmogorov cero-uno, llamada así por Andrey Kolmogorov. Afirma que un evento en la cola\(\sigma\) -álgebra de una secuencia independiente tendrá probabilidad 0 o 1.

Supongamos que\( \bs X = (X_1, X_2, \ldots) \) es una secuencia independiente de variables aleatorias

- Si\(B\) es un evento de cola para\( \bs X \) entonces\(\P(B) = 0\) o\(\P(B) = 1\).

- Si\( Y \) es una variable aleatoria de cola de valor real para\( \bs X \) entonces\( Y \) es constante con probabilidad 1.

Prueba

- Por definición\( B \in \sigma\{X_{n+1}, X_{n+2}, \ldots\} \) para cada uno\( n \in \N_+ \), y por lo tanto\(\{X_1, X_2, \ldots, X_n, \bs{1}_B\}\) es un conjunto independiente de variables aleatorias. Así\(\{X_1, X_2, \ldots, \bs{1}_B\}\) es un conjunto independiente de variables aleatorias. Pero\( B \in \sigma\{X_1, X_2, \ldots\} \), así se deduce que el evento\(B\) es independiente de sí mismo. Por lo tanto\(\P(B) = 0\) o\(\P(B) = 1\).

- La función\(y \mapsto \P(Y \le y) \) on\( \R \) es la función de distribución (acumulativa) de\( Y \). Esta función está claramente en aumento. Además, las aplicaciones simples de los teoremas de continuidad muestran que es correcto continuo y que\( \P(Y \le y) \to 0 \) como\( y \to -\infty \) y\( \P(Y \le y) \to 1 \) como\( y \to \infty \). (Las pruebas explícitas se dan en la sección sobre funciones de distribución en el capítulo sobre Distribuciones.) Pero dado que\( Y \) es una variable aleatoria de cola,\( \{Y \le y\} \) es un evento tail y por lo tanto\( \P(Y \le y) \in \{0, 1\} \) para cada uno\( y \in \R \). De ello se deduce que existe\( c \in \R \) tal que\( \P(Y \le y) = 0 \) para\( y \lt c \) y\( \P(Y \le y) = 1 \) para\( y \ge c \). De ahí\( \P(Y = c) = 1 \).

De la ley de Komogorov cero-uno y el resultado anterior, señalar que si\((A_1, A_2, \ldots)\) es una secuencia de eventos independientes, entonces\(\limsup_{n \to \infty} A_n\) debe tener probabilidad 0 o 1. Los lemmas de Borel-Cantelli dan condiciones para cuál de estas es la correcta:

Supongamos que\( (A_1, A_2, \ldots) \) es una secuencia de eventos independientes.

- Si\( \sum_{i=1}^\infty \P(A_i) \lt \infty \) entonces\( \P\left(\limsup_{n \to \infty} A_n\right) = 0 \).

- Si\( \sum_{i=1}^\infty \P(A_i) = \infty \) entonces\( \P\left(\limsup_{n \to \infty} A_n\right) = 1 \).

Otra prueba de la ley de Kolmogorov cero-uno se dará utilizando el teorema de convergencia de la martingala.

Ejemplos y ejercicios

Como siempre, asegúrate de probar los ejercicios computacionales y pruebas antes de leer las respuestas y pruebas en el texto.

Contraejemplos

La igualdad de probabilidad ciertamente no implica eventos equivalentes.

Considera el simple experimento de lanzar una moneda justa. El evento de que la moneda aterrice cabezas y el evento de que la moneda aterrice colas tienen la misma probabilidad, pero no son equivalentes.

Prueba

Dejar\( S \) denotar el espacio de muestra, y\( H \) el evento de cabezas, así que ese\( H^c \) es el evento de colas. Dado que la moneda es justa,\( \P(H) = \P(H^c) = \frac{1}{2} \). Pero\( H \bigtriangleup H^c = S\), así\( \P(H \bigtriangleup H^c) = 1 \), así\( H \) y\( H^c \) están lo más lejos de ser equivalentes como sea posible.

Del mismo modo, las distribuciones equivalentes no implican variables aleatorias equivalentes.

Considera el experimento de enrollar una matriz estándar y justa. Vamos a\( X \) denotar la puntuación y\( Y = 7 - X \). Entonces\( X \) y\( Y \) tienen la misma distribución pero no son equivalentes.

Prueba

Dado que el dado es justo,\( X \) se distribuye uniformemente sobre\(S = \{1, 2, 3, 4, 5, 6\} \). También\( \P(Y = k) = \P(X = 7 - k) = \frac{1}{6} \) para\( k \in S \), por lo que\( Y \) también tiene la distribución uniforme encendida\( S \). Pero\( \P(X = Y) = \P\left(X = \frac{7}{2}\right) = 0 \), así\( X \) y\( Y \) están lo más lejos de ser equivalentes como sea posible.

Considera el experimento de rodar dos dados estándar, justos y registrar la secuencia de partituras\( (X, Y) \). Entonces\( X \) y\( Y \) son independientes y tienen la misma distribución, pero no son equivalentes.

Prueba

Dado que los dados son justos,\( (X, Y) \) tiene la distribución uniforme encendida\( \{1, 2, 3, 4, 5, 6\}^2 \). Equivalentemente,\( X \) y\( Y \) son independientes, y cada uno tiene la distribución uniforme en\( \{1, 2, 3, 4, 5, 6\} \). Pero\( \P(X = Y) = \frac{1}{6} \), así\( X \) y no\( Y \) son equivalentes.