5.17: La distribución beta

- Page ID

- 151644

En esta sección, estudiaremos la distribución beta, la distribución más importante que tiene soporte acotado. Pero antes de poder estudiar la distribución beta debemos estudiar la función beta.

La función Beta

Definición

La función beta\( B \) se define de la siguiente manera:\[ B(a, b) = \int_0^1 u^{a-1} (1 - u)^{b - 1} du; \quad a, \, b \in (0, \infty) \]

Prueba que\( B \) está bien definida

Tenemos que demostrar eso\(B(a, b) \lt \infty\) para cada uno\(a, \, b \in (0, \infty)\). El integrando es positivo en\( (0, 1) \), por lo que la integral existe, ya sea como un número real o\( \infty \). Si\( a \ge 1 \) y\( b \ge 1 \), el integrando es continuo encendido\( [0, 1] \), entonces por supuesto la integral es finita. Así, los únicos casos de interés son cuándo\( 0 \lt a \lt 1 \) o\( 0 \lt b \lt 1 \). Tenga en cuenta que\[ \int_0^1 u^{a-1} (1 - u)^{b - 1} du = \int_0^{1/2} u^{a-1} (1 - u)^{b - 1} du + \int_{1/2}^1 u^{a-1} (1 - u)^{b - 1} du \] Si\(0 \lt a \lt 1\),\((1 - u)^{b-1}\) está acotado en\(\left(0, \frac{1}{2}\right]\) y\( \int_0^{1/2} u^{a - 1} \, du = \frac{1}{a 2^a} \). De ahí que la primera integral a la derecha en la ecuación mostrada sea finita. De igual manera\(0 \lt b \lt 1\), Si,\(u^{a-1}\) está acotado en\(\left[\frac{1}{2}, 1\right)\) y\( \int_{1/2}^1 (1 - u)^{b-1} \, du = \frac{1}{b 2^b} \). De ahí que la segunda integral a la derecha en la ecuación mostrada también sea finita.

La función beta fue introducida por primera vez por Leonhard Euler.

Propiedades

La función beta satisface las siguientes propiedades:

- \(B(a, b) = B(b, a)\)para\( a, \, b \in (0, \infty) \), así\( B \) es simétrico.

- \(B(a, 1) = \frac{1}{a}\)para\( a \in (0, \infty) \)

- \( B(1, b) = \frac{1}{b} \)para\( b \in (0, \infty) \)

Prueba

- Usando la sustitución\( v = 1 - u \) que tenemos\[ B(a, b) = \int_0^1 u^{a-1}(1 - u)^{b-1} du = \int_0^1 (1 - v)^{a-1} v^{b-1} dv = B(b, a) \]

- \( B(a, 1) = \int_0^1 u^{a-1} du = \frac{1}{a} \)

- Esto se desprende de los apartados a) y b).

La función beta tiene una expresión simple en términos de la función gamma:

Si\( a, \, b \in (0, \infty) \) entonces\[ B(a, b) = \frac{\Gamma(a) \Gamma(b)}{\Gamma(a + b)} \]

Prueba

A partir de las definiciones, podemos expresar\(\Gamma(a + b) B(a, b)\) como una doble integral:\[ \Gamma(a + b) B(a, b) = \int_0^\infty x^{a + b -1} e^{-x} dx \int_0^1 y^{a-1} (1 - y)^{b-1} dy = \int_0^\infty \int_0^1 (x y)^{a-1}[x (1 - y)]^{b-1} x e^{-x} dx \, dy \] A continuación usamos la transformación\(w = x y\),\(z = x (1 - y)\) que mapea\((0, \infty) \times (0, 1) \) uno a uno sobre\( (0, \infty) \times (0, \infty) \). La transformación inversa es\( x = w + z \),\( y = w \big/(w + z) \) y el valor absoluto del jacobiano es\[ \left|\det\frac{\partial(x, y)}{\partial(w, z)}\right| = \frac{1}{(w + z)} \] Así, utilizando el teorema de cambio de variables para múltiples integrales, la integral anterior se convierte en la\[ \int_0^\infty \int_0^\infty w^{a-1} z^{b-1} (w + z) e^{-(w + z)} \frac{1}{w + z} dw \, dz \] cual después de simplificar es\( \Gamma(a) \Gamma(b) \).

Recordemos que la función gamma es una generalización de la función factorial. Aquí está el resultado correspondiente para la función beta:

Si\(j, \, k \in \N_+\) entonces\[ B(j, k) = \frac{(j - 1)! (k - 1)!}{(j + k - 1)!} \]

Prueba

Recordemos que\( \Gamma(n) = (n - 1)! \) para\( n \in \N_+ \), por lo que este resultado se desprende del anterior.

Generalicemos este resultado. Primero, recordar de nuestro estudio de las estructuras combinatorias que para\(a \in \R\) y\(j \in \N\), el poder ascendente de base\( a \) y orden\( j \) es\[ a^{[j]} = a (a + 1) \cdots [a + (j - 1)] \]

Si\(a, \, b \in (0, \infty)\), y\(j, \, k \in \N\), entonces\[ \frac{B(a + j, b + k)}{B(a, b)} = \frac{a^{[j]} b^{[k]}}{(a + b)^{[j + k]}} \]

Prueba

Recordemos eso\( \Gamma(a + j) = a^{[j]} \Gamma(a) \), por lo que el resultado se desprende de la representación anterior para la función beta en términos de la función gamma.

\(B\left(\frac{1}{2}, \frac{1}{2}\right) = \pi\).

Prueba

La función beta incompleta

La integral que define la función beta puede generalizarse cambiando el intervalo de integración de\((0, 1)\) a\((0, x)\) dónde\(x \in [0, 1]\).

La función beta incompleta se define de la siguiente manera\[ B(x; a, b) = \int_0^x u^{a-1} (1 - u)^{b-1} du, \quad x \in (0, 1); \; a, \, b \in (0, \infty) \]

Por supuesto, la función beta ordinaria (completa) es\(B(a, b) = B(1; a, b)\) para\( a, \, b \in (0, \infty) \).

La distribución beta estándar

Funciones de distribución

Las distribuciones beta son una familia de distribuciones continuas en el intervalo\( (0, 1) \).

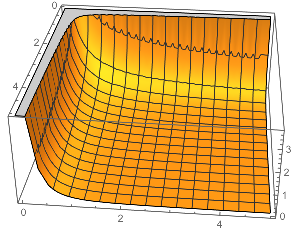

La distribución beta (estándar) con el parámetro izquierdo\( a \in (0, \infty) \) y el parámetro derecho\( b \in (0, \infty) \) tiene la función de densidad de probabilidad\( f \) dada por\[ f(x) = \frac{1}{B(a, b)} x^{a-1} (1 - x)^{b-1}, \quad x \in (0, 1) \]

Por supuesto, la función beta es simplemente la constante normalizadora, por lo que está claro que\( f \) es una función de densidad de probabilidad válida. Si\( a \ge 1 \),\( f \) se define en 0, y if\( b \ge 1 \),\( f \) se define en 1. En estos casos, es costumbre extender el dominio de\( f \) a estos puntos finales. La distribución beta es útil para modelar probabilidades y proporciones aleatorias, particularmente en el contexto del análisis bayesiano. La distribución tiene solo dos parámetros y, sin embargo, una rica variedad de formas (por lo que en particular, ambos parámetros son parámetros de forma). Cualitativamente, las propiedades de primer orden de\( f \) dependen de si cada parámetro es menor que, igual o mayor que 1.

Para\( a, \, b \in (0, \infty) \) con\( a + b \ne 2 \), definir\[ x_0 = \frac{a - 1}{a + b - 2} \]

- Si\(0 \lt a \lt 1\) y\(0 \lt b \lt 1\),\( f \) disminuye y luego aumenta con el valor mínimo en\(x_0 \) y con\( f(x) \to \infty \) as\( x \downarrow 0 \) y como\( x \uparrow 1 \).

- Si\(a = 1\) y\(b = 1\),\( f \) es constante.

- Si\(0 \lt a \lt 1\) y\(b \ge 1\),\( f \) es decreciente con\( f(x) \to \infty \) as\( x \downarrow 0 \).

- Si\(a \ge 1\) y\(0 \lt b \lt 1\),\( f \) está aumentando con\( f(x) \to \infty \) as\( x \uparrow 1 \).

- Si\(a = 1\) y\(b \gt 1\),\( f \) está disminuyendo con el modo en\( x = 0 \).

- Si\(a \gt 1\) y\(b = 1\),\( f \) está aumentando con el modo en\( x = 1 \).

- Si\(a \gt 1\) y\(b \gt 1\),\( f \) aumenta y luego disminuye con el modo en\( x_0 \).

Prueba

Estos resultados se derivan del cálculo estándar. La primera derivada es\[ f^\prime(x) = \frac{1}{B(a, b)} x^{a - 2}(1 - x)^{b - 2} [(a - 1) - (a + b - 2) x], \quad 0 \lt x \lt 1 \]

De la parte (b), señalar que el caso especial\(a = 1\) y\(b = 1\) da la distribución uniforme continua en el intervalo\((0, 1)\) (la distribución uniforme estándar). Obsérvese también que cuando\(a \lt 1\) o\(b \lt 1\), la función de densidad de probabilidad no está acotada, y por lo tanto la distribución no tiene modo. Por otro lado, si\(a \ge 1\),\(b \ge 1\), y una de las inequalitas es estricta, la distribución tiene un modo único en\( x_0 \). Las propiedades de segundo orden son más complicadas.

Para\( a, \, b \in (0, \infty) \) con\( a + b \notin \{2, 3\} \) y\( (a - 1)(b - 1)(a + b - 3) \ge 0 \), define\ begin {align} x_1 &=\ frac {(a - 1) (a + b - 3) -\ sqrt {(a - 1) (b - 1) (a + b - 3)}} {(a + b - 3) (a + b - 2)}\\ x_2 &=\ frac {(a - 1) (a + b - 3) +\ sqrt {(a - 1) (b - 1) (a + b - 3)}} {(a + b - 3) (a + b - 2)}\ end {align} Para\( a \lt 1 \) y\( a + b = 2 \) o para\( b \lt 1 \) y\( a + b = 2 \), definir\( x_1 = x_2 = 1 - a / 2 \).

- Si\( a \le 1 \) y\( b \le 1 \), o si\( a \le 1 \) y\( b \ge 2 \), o si\( a \ge 2 \) y\( b \le 1 \),\( f \) es cóncavo hacia arriba.

- Si\( a \le 1 \) y\( 1 \lt b \lt 2 \),\( f \) es cóncava hacia arriba y luego hacia abajo con punto de inflexión en\( x_1 \).

- Si\( 1 \lt a \lt 2 \) y\( b \le 1 \),\( f \) es cóncava hacia abajo y luego hacia arriba con punto de inflexión en\( x_2 \).

- Si\( 1 \lt a \le 2 \) y\( 1 \lt b \le 2 \),\( f \) es cóncava hacia abajo.

- Si\( 1 \lt a \le 2 \) y\( b \gt 2 \),\( f \) es cóncava hacia abajo y luego hacia arriba con punto de inflexión en\( x_2 \).

- Si\( a \gt 2 \) y\( 1 \lt b \le 2 \),\( f \) es cóncava hacia arriba y luego hacia abajo con punto de inflexión en\( x_1 \).

- Si\( a \gt 2 \) y\( b \gt 2 \),\( f \) es cóncavo hacia arriba, luego hacia abajo, luego hacia arriba nuevamente, con puntos de inflexión en\( x_1 \) y\( x_2 \).

Prueba

Estos resultados se derivan del cálculo estándar (pero muy tedioso). La segunda derivada es\[ f^{\prime\prime}(x) = \frac{1}{B(a, b)} x^{a - 3}(1 - x)^{b - 3} \left[(a + b - 2)(a + b - 3) x^2 - 2 (a - 1)(a + b - 3) x + (a - 1)(a - 2)\right] \]

En el simulador de distribución especial, seleccione la distribución beta. Varíe los parámetros y anote la forma de la función de densidad beta. Para valores seleccionados de los parámetros, ejecute la simulación 1000 veces y compare la función de densidad empírica con la función de densidad verdadera.

El caso especial\(a = \frac{1}{2}\),\(b = \frac{1}{2}\) es la distribución del arcoseno, con la función de densidad de probabilidad dada por\[ f(x) = \frac{1}{\pi \, \sqrt{x (1 - x)}}, \quad x \in (0, 1) \] Esta distribución es importante en una serie de aplicaciones, por lo que la distribución del arcoseno se estudia en una sección separada.

La función de distribución beta se\(F\) puede expresar fácilmente en términos de la función beta incompleta. Como de costumbre\(a\) denota el parámetro izquierdo y\(b\) el parámetro derecho.

La función de distribución beta\( F \) con parámetros\(a, \, b \in (0, \infty)\) viene dada por\[ F(x) = \frac{B(x; a, b)}{B(a, b)}, \quad x \in (0, 1) \]

La función de distribución a veces\( F \) se conoce como la función beta incompleta regularizada. En algunos casos especiales, la función de distribución\(F\) y su inversa, la función cuantil\(F^{-1}\), se pueden calcular en forma cerrada, sin recurrir a funciones especiales.

Si\(a \in (0, \infty)\) y\(b = 1\) entonces

- \(F(x) = x^a\)para\(x \in (0, 1)\)

- \(F^{-1}(p) = p^{1/a}\)para\(p \in (0, 1)\)

Si\(a = 1\) y\(b \in (0, \infty)\) entonces

- \(F(x) = 1 - (1 - x)^b\)para\(x \in (0, 1)\)

- \(F^{-1}(p) = 1 - (1 - p)^{1/b}\)para\(p \in (0, 1)\)

Si\(a = b = \frac{1}{2}\) (la distribución del arcoseno) entonces

- \(F(x) = \frac{2}{\pi} \arcsin\left(\sqrt{x}\right)\)para\(x \in (0, 1)\)

- \(F^{-1}(p) = \sin^2\left(\frac{\pi}{2} p\right)\)para\(p \in (0, 1)\)

Existe una relación interesante entre las funciones de distribución de la distribución beta y la distribución binomial, cuando los parámetros beta son enteros positivos. Para exponer la relación necesitamos embellecer nuestra notación para indicar la dependencia de los parámetros. Así, vamos a\(F_{a, b}\) denotar la función de distribución beta con parámetro left\(a \in (0, \infty)\) y right parámetro\(b \in (0, \infty)\), y let\(G_{n,p}\) denotar la función de distribución binomial con parámetro trial\(n \in \N_+\) y parámetro success\(p \in (0, 1)\).

Si\(j, \, k \in \N_+\) y\(x \in (0, 1)\) entonces\[ F_{j,k}(x) = G_{j + k - 1, 1 - x}(k - 1) \]

Prueba

Por definición\[ F_{j,k}(x) = \frac{1}{B(j,k)} \int_0^x t^{j-1} (1 - t)^{k-1} dt \] Integrar por partes con\( u = (1 - t)^{k-1} \) y\( dv = t^{j-1} dt \), para que\( du = -(k -1) (1 - t)^{k-2} \) y\( v = t^j / j \). El resultado es\[ F_{j,k}(x) = \frac{1}{j B(j, k)} (1 - x)^{k-1} x^j + \frac{k-1}{j B(j, k)} \int_0^x t^j (1 - t)^{k-2} dt\] Pero por la propiedad de la función beta anterior,\( B(j, k) = (j - 1)! (k - 1)! \big/(j + k - 1)! \). De ahí\( 1 \big/ j B(j, k) = \binom{j + k - 1}{k - 1} \) y\( (k - 1) \big/ j B(j, k) = 1 \big/ B(j + 1, k - 1) \). Así, la última ecuación mostrada puede reescribirse como\[F_{j,k}(x) = \binom{j + k - 1}{k - 1} (1 - x)^{k-1} x^j + F_{j + 1, k - 1}(x)\] Recall del caso especial anterior a eso\(F_{j + k - 1, 1}(x) = x^{j + k - 1}\). Iterando la última ecuación mostrada da el resultado.

En la calculadora de distribución especial, seleccione la distribución beta. Varíe los parámetros y anote la forma de la función de densidad y la función de distribución. En cada uno de los siguientes casos, encuentre la mediana, el primer y tercer cuartiles y el rango intercuartil. Esbozar el diagrama de caja.

- \(a = 1\),\(b = 1\)

- \(a = 1\),\(b = 3\)

- \(a = 3\),\(b = 1\)

- \(a = 2\),\(b = 4\)

- \(a = 4\),\(b = 2\)

- \(a = 4\),\(b = 4\)

Momentos

Los momentos de la distribución beta son fáciles de expresar en términos de la función beta. Como antes, supongamos que\(X\) tiene la distribución beta con parámetro izquierdo\(a \in (0, \infty)\) y parámetro derecho\(b \in (0, \infty)\).

Si\(k \in [0, \infty)\) entonces\[ \E\left(X^k\right) = \frac{B(a + k, b)}{B(a, b)} \] En particular, si\( k \in \N \) entonces\[ \E\left(X^k\right) = \frac{a^{[k]}}{(a + b)^{[k]}} \]

Prueba

Tenga en cuenta que\[ \E\left(X^k\right) = \int_0^1 x^k \frac{1}{B(a, b)} x^{a-1} (1 - x)^{b - 1} dx = \frac{1}{B(a, b)} \int_0^1 x^{a + k - 1} (1 - x)^{b - 1} dx = \frac{B(a + k, b)}{B(a, b)}\] If\( k \in \N \), la fórmula se simplifica por la propiedad de la función beta anterior.

A partir de la fórmula general para los momentos, es sencillo calcular la media, varianza, asimetría y curtosis.

La media y varianza de\( X \) son\ begin {align}\ E (X) &=\ frac {a} {a + b}\\\ var (X) &=\ frac {a b} {(a + b) ^2 (a + b + 1)}\ end {align}

Prueba

La fórmula para la media y varianza sigue de la fórmula para los momentos y la fórmula computacional\( \var(X) = \E(X^2) - [\E(X)]^2 \)

Tenga en cuenta que la varianza depende de los parámetros\( a \) y\( b \) sólo a través del producto\( a b \) y la suma\( a + b \).

Abra el simulador de distribución especial y seleccione la distribución beta. Varíe los parámetros y anote el tamaño y la ubicación de la barra de desviación\(\pm\) estándar media. Para valores seleccionados de los parámetros, ejecute la simulación 1000 veces y compare la media de la muestra y la desviación estándar con la media de distribución y la desviación estándar.

La asimetría y curtosis de\( X \) son\ begin {align}\ skw (X) &=\ frac {2 (b - a)\ sqrt {a + b + 1}} {(a + b + 2)\ sqrt {a b}}\\ kur (X) &=\ frac {3 a^3 b + 3 a b^3 + 6 a^2 b^2 + a^2 + ^3 + b^3 + 13 a^2 b + 13 a b^2 + a^2 + b^2 + 14 a b} {a b (a + b + 2) (a + b + 3)}\ end {align}

Prueba

Estos resultados se derivan de las fórmulas computacionales que dan la asimetría y curtosis en términos de\( \E(X^k) \) for\( k \in \{1, 2, 3, 4\} \), y la fórmula para los momentos anteriores.

En particular, tenga en cuenta que la distribución está sesgada positivamente si\( a \lt b \), no sesgada si\( a = b \) (la distribución es simétrica\( x = \frac{1}{2} \) en este caso) y sesgada negativamente si\( a \gt b \).

Abra el simulador de distribución especial y seleccione la distribución beta. Varíe los parámetros y anote la forma de la función de densidad de probabilidad a la luz del resultado anterior sobre la asimetría. Para varios valores de los parámetros, ejecute la simulación 1000 veces y compare la función de densidad empírica con la función de densidad de probabilidad verdadera.

Distribuciones Relacionadas

La distribución beta está relacionada con otras distribuciones especiales.

Si\(X\) tiene la distribución beta con el parámetro izquierdo\(a \in (0, \infty)\) y el parámetro derecho\(b \in (0, \infty)\) entonces\(Y = 1 - X\) tiene la distribución beta con el parámetro izquierdo\(b\) y el parámetro derecho\(a\).

Prueba

Esto se desprende de la fórmula estándar de cambio de variables. Si\( f \) y\( g \) denotan los PDF de\( X \) y\( Y \) respectivamente, entonces\[ g(y) = f(1 - y) = \frac{1}{B(a, b)} (1 - y)^{a - 1} y^{b - 1} = \frac{1}{B(b, a)} y^{b - 1} (1 - y)^{a - 1}, \quad y \in (0, 1)\]

La distribución beta con parámetro derecho 1 tiene una relación recíproca con la distribución de Pareto.

Supongamos que\( a \in (0, \infty) \).

- Si\(X\) tiene la distribución beta con el parámetro izquierdo\(a \) y el parámetro derecho 1 entonces\(Y = 1 / X\) tiene la distribución de Pareto con el parámetro shape\(a\).

- Si\( Y \) tiene la distribución de Pareto con el parámetro shape\( a \) entonces\( X = 1 / Y \) tiene la distribución beta con el parámetro izquierdo\( a \) y el parámetro derecho 1.

Prueba

Los dos resultados son equivalentes. En (a), supongamos que\( X \) tiene la distribución beta con parámetros\( a \) y 1. La transformación\( y = 1 / x \) mapea\( (0, 1) \) uno a uno en\( (0, \infty) \). El inverso es\( x = 1 / y \) con\( dx/dy = -1/y^2 \). Recordemos también eso\( B(a, 1) = 1 / a \). Por el cambio de fórmula de variables, el PDF\( g \) de\( Y = 1 / X \) viene dado por\[ g(y) = f\left(\frac{1}{y}\right) \frac{1}{y^2} = a \left(\frac{1}{y}\right)^{a-1} \frac{1}{y^2} = \frac{a}{y^{a+1}}, \quad y \in (0, \infty) \] Reconocemos\( g \) como el PDF de la distribución de Pareto con parámetro shape\( a \).

El siguiente resultado da una conexión entre la distribución beta y la distribución gamma.

Supongamos que\(X\) tiene la distribución gamma con el parámetro shape\(a \in (0, \infty)\) y el parámetro rate\(r \in (0, \infty)\),\(Y\) tiene la distribución gamma con el parámetro shape\(b \in (0, \infty)\) y el parámetro rate\(r\), y que\(X\) y\(Y\) son independientes. Después\(V = X \big/ (X + Y)\) tiene la distribución beta con parámetro izquierdo\(a\) y parámetro derecho\(b\).

Prueba

Dejar\( U = X + Y \) y\( V = X \big/ (X + Y) \). En realidad vamos a demostrar resultados más fuertes:\( U \) y\( V \) son independientes,\( U \) tiene la distribución gamma con parámetro de forma\( a + b \) y parámetro de tasa\( r \), y\( V \) tiene la distribución beta con parámetros\( a \) y\( b \). Primera nota que\( (X, Y) \) tiene PDF conjunto\( f \) dado por\[ f(x, y) = \frac{r^a}{\Gamma(a)} x^{a-1} e^{-r x} \frac{r^b}{\Gamma(b)} y^{b-1} e^{-r y} = \frac{r^{a+b}}{\Gamma(a) \Gamma(b)} x^{a-1} y^{b-1} e^{-r(x + y)}; \quad x, \, y \in (0, \infty) \] La transformación\( u = x + y \) y\( v = x \big/ (x + y) \) mapea\( (0, \infty) \times (0, \infty) \) uno a uno en\( (0, \infty) \times (0, 1) \). Lo inverso es\( x = u v \),\( y = u(1 - v) \) y el valor absoluto del jacobiano es\[ \left|\det \frac{\partial(x, y)}{\partial(u, v)}\right| = u \] De ahí que por el cambio multivariado de las variables teorema, el PDF\( g \) de\( (U, V) \) viene dado por\ begin {align} g (u, v) & = f [u v, u (1 - v)] u =\ frac {r^ {a+b}} {\ Gamma (a)\ Gamma (b)} (u v) ^ {a-1} [u (1 - v)] ^ {b- 1} e^ {-ru} u\\ & =\ frac {r^ {a+b}} {\ Gamma (a)\ Gamma (b)} u^ {a+b-1} e^ {-ru} v^ {a-1} (1 - v) ^ {b-1}\\ & =\ frac {r^ {a+b}} {\ Gamma (a + b)} u^ {a+b-1} e^ {-ru}\ frac {\ Gamma (a + b)} {\ Gamma (a)\ Gamma (b)} v^ {a-1} (1 - v) ^ {b-1};\ quad u\ in (0,\ infty), v\ in (0, 1)\ end {align} Los resultados ahora siguen de la Teorema de factorización. El factor in\( u \) es el PDF gamma con parámetro shape\( a + b \) y parámetro rate\( r \) mientras que el factor in\( v \) es el PDF beta con parámetros\( a \) y\( b \).

El siguiente resultado da una conexión entre la distribución beta y la\(F\) distribución. Esta conexión es una variación menor del resultado anterior.

Si\(X\) tiene la\(F\) distribución con\(n \in (0, \infty)\) grados de libertad en el numerador y\(d \in (0, \infty)\) grados de libertad en el denominador entonces\[ Y = \frac{(n / d) X}{1 + (n / d)X} \] tiene la distribución beta con parámetro izquierdo\(a = n / 2\) y parámetro derecho\(b = d / 2\).

Prueba

Si\(X\) tiene la\(F\) distribución con\(n \gt 0\) grados de libertad en el numerador y\(d \gt 0\) grados de libertad en el denominador entonces se\( X \) puede escribir como\[ X = \frac{U / n}{V / d} \] donde\( U \) tiene la distribución chi-cuadrada con\( n \) grados de libertad,\( V \) tiene el chi- distribución cuadrada con\( d \) grados de libertad, y\( U \) y\( V \) son independientes. De ahí\[ Y = \frac{(n / d) X}{1 + (n / d) X} = \frac{U / V}{1 + U / V} = \frac{U}{U + V} \] Pero la distribución chi-cuadrada es un caso especial de la distribución gamma. Específicamente,\( U \) tiene la distribución gamma con parámetro de forma\( n / 2 \) y parámetro de tasa\( 1/2 \),\( V \) tiene la distribución gamma con parámetro de forma\( d / 2 \) y parámetro de tasa\( 1/2 \), y de nuevo\( U \) y\( V \) son independientes. De ahí que por el resultado anterior,\( Y \) tenga la distribución beta con parámetro izquierdo\( n/2 \) y parámetro derecho\( d/2 \).

Nuestro siguiente resultado es que la distribución beta es miembro de la familia exponencial general de distribuciones.

Supongamos que\(X\) tiene la distribución beta con parámetro izquierdo\(a \in (0, \infty)\) y parámetro derecho\(b \in (0, \infty)\). Entonces la distribución es una familia exponencial de dos parámetros con parámetros naturales\(a - 1\) y\(b - 1\), y estadísticas naturales\(\ln(X)\) y\(\ln(1 - X)\).

Prueba

Esto se desprende de la definición de la distribución exponencial general, ya que el PDF\( f \) de\( X \) puede escribirse como\[ f(x) = \frac{1}{B(a, b)} \exp\left[(a - 1) \ln(x) + (b - 1) \ln(1 - x)\right], \quad x \in (0, 1) \]

La distribución beta es también la distribución de las estadísticas de orden de una muestra aleatoria a partir de la distribución uniforme estándar.

Supongamos\( n \in \N_+ \) y que\( (X_1, X_2, \ldots, X_n) \) es una secuencia de variables independientes, cada una con la distribución uniforme estándar. Para\( k \in \{1, 2, \ldots, n\} \), la estadística de orden\( k \) th\( X_{(k)} \) tiene la distribución beta con parámetro izquierdo\( a = k \) y parámetro derecho\( b = n - k + 1 \).

Prueba

Consulte el apartado de estadísticas de pedidos.

Una de las propiedades más importantes de la distribución beta, y una de las principales razones de su amplio uso en estadística, es que forma una familia conjugada para la probabilidad de éxito en las distribuciones binomiales y binomiales negativas.

Supongamos que\( P \) es una probabilidad aleatoria que tiene la distribución beta con parámetro izquierdo\( a \in (0, \infty) \) y parámetro derecho\( b \in (0, \infty) \). Supongamos también que\( X \) es una variable aleatoria tal que la distribución condicional de\( X \) dada\( P = p \in (0, 1) \) es binomial con parámetro trial\( n \in \N_+ \) y parámetro success\( p \). Entonces la distribución condicional de\( P \) dado\( X = k \) es beta con parámetro izquierdo\( a + k \) y parámetro derecho\( b + n - k \).

Prueba

El PDF conjunto\( f \) de\( (P, X) \) on\( (0, 1) \times \{0, 1, \ldots n\} \) viene dado por\[ f(p, k) = \frac{1}{B(a, b)} p^{a-1} (1 - p)^{b-1} \binom{n}{k} p^k (1 - p)^{n-k} = \frac{1}{B(a, b)} \binom{n}{k} p^{a + k - 1} (1 - p)^{b + n - k - 1} \] El PDF condicional de\( P \) dado\( X = k \) es simplemente la versión normalizada de la función\( p \mapsto f(p, k) \). Podemos decir por la forma funcional que esta distribución es beta con los parámetros dados en el teorema.

Supongamos nuevamente que\( P \) es una probabilidad aleatoria que tiene la distribución beta con parámetro izquierdo\( a \in (0, \infty) \) y parámetro derecho\( b \in (0, \infty) \). Supongamos también que\( N \) es una variable aleatoria tal que la distribución condicional de\( N \) dado\( P = p \in (0, 1) \) es binomio negativo con parámetro de parada\( k \in \N_+ \) y parámetro de éxito\( p \). Entonces la distribución condicional de\( P \) dado\( N = n \) es beta con parámetro izquierdo\( a + k \) y parámetro derecho\( b + n - k \).

Prueba

El PDF conjunto\( f \) de\( (P, N) \) on\( (0, 1) \times \{k, k + 1, \ldots\} \) viene dado por\[ f(p, n) = \frac{1}{B(a, b)} p^{a-1} (1 - p)^{b-1} \binom{n - 1}{k - 1} p^k (1 - p)^{n-k} = \frac{1}{B(a, b)} \binom{n - 1}{k - 1} p^{a + k - 1} (1 - p)^{b + n - k - 1} \] El PDF condicional de\( P \) dado\( N = n \) es simplemente la versión normalizada de la función\( p \mapsto f(p, n) \). Podemos decir por la forma funcional que esta distribución es beta con los parámetros dados en el teorema.

en ambos casos, tenga en cuenta que en la distribución posterior de\( P \), el parámetro izquierdo se incrementa por el número de éxitos y el parámetro derecho por el número de fallas. Para más información sobre esto, consulte la sección sobre estimación bayesiana en el capítulo sobre estimación puntual.

La distribución general de la beta

La distribución beta puede generalizarse fácilmente desde el intervalo de soporte\((0, 1)\) a un intervalo acotado arbitrario usando una transformación lineal. Por lo tanto, esta generalización es simplemente la familia de escala de ubicación asociada a la distribución beta estándar.

Supongamos que\(Z\) tiene la distribución beta estándar con parámetro izquierdo\(a \in (0, \infty)\) y parámetro derecho\(b \in (0, \infty)\). Para\(c \in \R\) y variable\(d \in (0, \infty)\) aleatoria\(X = c + d Z\) tiene la distribución beta con parámetro izquierdo\( a \), parámetro derecho\( b \), parámetro de ubicación\( c \) y parámetro de escala\( d \).

Para lo que resta de esta discusión, supongamos que\( X \) tiene la distribución en la definición anterior.

\(X\)tiene función de densidad de probabilidad

\[ f(x) = \frac{1}{B(a, b) d^{a + b - 1}} (x - c)^{a - 1} (c + d - x)^{b - 1}, \quad x \in (c, c + d) \]Prueba

Esto se desprende de un resultado estándar para familias a escala de ubicación. Si\( g \) denota el PDF beta estándar de\( Z \), entonces\( X \) tiene PDF\( f \) dado por\[ f(x) = \frac{1}{d} g\left(\frac{x - c}{d}\right), \quad x \in (c, c + d) \]

La mayoría de los resultados de las secciones anteriores tienen extensiones simples a la distribución beta general.

La media y varianza\( X \) de

- \(\E(X) = c + d \frac{a}{a + b}\)

- \(\var(X) = d^2 \frac{a b}{(a + b)^2 (a + b + 1)}\)

Prueba

Esto se desprende de la media estándar y varianza y las propiedades básicas del valor esperado y varianza.

- \( \E(X) = c + d \E(Z)\)

- \( \var(X) = d^2 \var(Z) \)

Recordemos que la asimetría y varianza se definen en términos de puntuaciones estándar y, por lo tanto, no se modifican bajo transformaciones de escala de ubicación. De ahí que la asimetría y curtosis de\( X \) son igual que para la distribución beta estándar.