8: Datos de Imagen Detectados Remotamente

- Page ID

- 88196

Datos de Imagen Detectados Remotamente

David DiBiase

8.1. Descripción general

El capítulo 7 concluyó con la afirmación de que el enfoque ráster es muy adecuado no solo para las superficies del terreno, sino también para otros fenómenos continuos. Este capítulo considera las características y usos de los datos ráster producidos con sistemas de teledetección satelital. La teledetección es una fuente clave de datos para el uso del suelo y la cartografía de la cubierta terrestre, la gestión de recursos agrícolas y ambientales, la exploración de minerales, la previsión meteorológica y la investigación del cambio global.

Objetivos

El objetivo general de la lección es darle a conocer las propiedades de los datos producidos por los sensores basados en satélites. Específicamente, en la lección aprenderás a:

- Comparar y contrastar las características de los datos de imagen producidos por la fotografía y los sistemas de teledetección digital;

- Usar la Web para encontrar datos de Landsat para un lugar y hora en particular;

- Explicar por qué y cómo se procesan los datos de imágenes de detección remota; y

- Realizar una clasificación simulada no supervisada de los datos de imágenes ráster.

Comentarios y preguntas

Los estudiantes registrados son bienvenidos a publicar comentarios, preguntas y respuestas a preguntas sobre el texto. Particularmente bienvenidos son las anécdotas que relacionan el texto del capítulo con su experiencia personal o profesional. Además, hay foros de discusión disponibles en el sistema de gestión de cursos ANGEL para comentarios y preguntas sobre temas que quizás no desees compartir con todo el mundo.

Para publicar un comentario, desplácese hacia abajo hasta el cuadro de texto debajo de “Publicar nuevo comentario” y comience a escribir en el cuadro de texto, o puede optar por responder a un hilo existente. Cuando termine de escribir, haga clic en el botón “Vista previa” o “Guardar” (Guardar enviará realmente su comentario). Una vez publicado tu comentario, podrás editarlo o eliminarlo según sea necesario. Además, podrás responder a otras publicaciones en cualquier momento.

Nota: las primeras palabras de cada comentario se convierten en su “título” en el hilo.

8.2. Lista de comprobación

La siguiente lista de verificación es para estudiantes de Penn State que están registrados para clases en las que se les ha asignado este texto, así como cuestionarios y proyectos asociados en el sistema de gestión de cursos ANGEL. Puede resultarle útil imprimir primero esta página para que pueda seguir las instrucciones.

| Paso | Actividad | Acceso/Direcciones |

|---|---|---|

| 1 | Leer Capítulo 8 | Esta es la segunda página del Capítulo. Haga clic en los enlaces en la parte inferior de la página para continuar o para volver a la página anterior, o para ir a la parte superior del capítulo. También puedes navegar por el texto a través de los enlaces del menú del GEOG 482 de la izquierda. |

| 2 | Presentar cuatro cuestionarios de práctica que incluyen:

Los cuestionarios de práctica no se califican y pueden presentarse más de una vez. | Ir a ANGEL > [la sección de tu curso] > Pestaña Lecciones > Carpeta Capítulo 8 > [quiz] |

| 3 | Realiza actividades de “Prueba esto” que incluyen:

Las actividades de “Prueba esto” no están calificadas. | Se proporcionan instrucciones para cada actividad. |

| 4 | Enviar el cuestionario calificado del Capítulo 8 | ANGEL > [la sección de tu curso] > Pestaña Lecciones > Carpeta Capítulo 8 > Capítulo 8 Cuestionario Calificado. Consulte la pestaña Calendario en ANGEL para conocer las fechas de vencimiento. |

| 5 | Leer comentarios y preguntas publicadas por compañeros de estudios. Agrega comentarios y preguntas propias, si las hubiere. | Los comentarios y preguntas pueden ser publicados en cualquier página del texto, o en un foro de discusión específico del Capítulo en ANGEL. |

8.3. Naturaleza de los datos de imagen de detección remota

Los datos, como ustedes saben, consisten en mediciones. Aquí consideramos la naturaleza del fenómeno que muchos, aunque no todos, los sistemas de teledetección miden: la energía electromagnética. Muchos de los objetos que componen la superficie de la Tierra reflejan y emiten energía electromagnética de maneras únicas. El atractivo de la teledetección multiespectral es que los objetos que son indistinguibles a una longitud de onda de energía pueden ser fáciles de distinguir en otras longitudes de onda. Verás que la teledetección digital es un poco como escanear un documento en papel con un escáner de escritorio, solo que mucho más complicado.

8.4. Espectro Electromagnético

La mayoría de los instrumentos de teledetección miden lo mismo: radiación electromagnética. La radiación electromagnética es una forma de energía emitida por toda la materia por encima de la temperatura cero absoluta (0 Kelvin o -273° Celsius). Los rayos X, los rayos ultravioleta, la luz visible, la luz infrarroja, el calor, las microondas y las ondas de radio y televisión son ejemplos de energía electromagnética.

Una porción del espectro electromagnético, que va desde longitudes de onda de 0.1 micrómetro (un micrómetro es una millonésima de metro) a un metro, dentro del cual operan la mayoría de los sistemas de teledetección. (Adaptado de Lillesand & Kiefer, 1994).

El gráfico anterior muestra las cantidades relativas de energía electromagnética emitida por el Sol y la Tierra a través del rango de longitudes de onda llamado espectro electromagnético. Los valores a lo largo del eje horizontal de la gráfica van desde longitudes de onda muy cortas (diez millonésimas de metro) hasta longitudes de onda largas (metros). Tenga en cuenta que el eje horizontal se escala logarítmicamente, de manera que cada incremento representa un aumento de diez veces en la longitud de onda. El eje se ha interrumpido tres veces en el extremo de onda larga de la escala para que el diagrama sea lo suficientemente compacto como para caber en su pantalla. El eje vertical de la gráfica representa la magnitud de la radiación emitida en cada longitud de onda.

Los objetos más calientes irradian más energía electromagnética que los objetos más fríos. Los objetos más calientes también irradian energía a longitudes de onda más cortas que los objetos más fríos. Así, como muestra la gráfica, el Sol emite más energía que la Tierra, y la radiación del Sol alcanza su punto máximo a longitudes de onda más cortas. La porción del espectro electromagnético en el pico de la radiación del Sol se llama banda visible porque el sistema de percepción visual humana es sensible a esas longitudes de onda. La visión humana es un medio poderoso para detectar la energía electromagnética dentro de la banda visual. Las tecnologías de teledetección extienden nuestra capacidad de percibir la energía electromagnética más allá de la banda visible, lo que nos permite ver la superficie de la Tierra de nuevas formas, lo que a su vez revela patrones que normalmente son invisibles.

El espectro electromagnético se divide en cinco bandas de longitud de onda. (Adaptado de Lillesand & Kiefer, 1994).

El gráfico anterior nombra varias regiones del espectro electromagnético. Los sistemas de teledetección se han desarrollado para medir la energía reflejada o emitida en diversas longitudes de onda para diferentes propósitos. Este capítulo destaca los sistemas diseñados para registrar la radiación en las bandas comúnmente utilizadas para el mapeo de uso del suelo y cobertura del suelo: las bandas visible, infrarroja y microondas.

La transmisividad de la atmósfera a través de un rango de longitudes de onda. Las áreas negras indican longitudes de onda en las que la atmósfera es parcial o totalmente opaca. (Adaptado de Lillesand & Kiefer, 1994).

A ciertas longitudes de onda, la atmósfera plantea un obstáculo para la teledetección satelital al absorber energía electromagnética. Por lo tanto, los sistemas de detección están diseñados para medir longitudes de onda dentro de las ventanas donde la transmisividad de la atmósfera es mayor.

8.5. Patrones de respuesta espectral

La superficie terrestre de la Tierra refleja alrededor del tres por ciento de toda la radiación solar entrante de regreso al espacio. El resto es reflejado por la atmósfera, o absorbido y re-radiado como energía infrarroja. Los diversos objetos que componen la superficie absorben y reflejan diferentes cantidades de energía a diferentes longitudes de onda. La magnitud de la energía que un objeto refleja o emite a través de un rango de longitudes de onda se llama su patrón de respuesta espectral.

La gráfica siguiente ilustra los patrones de respuesta espectral de agua, suelo gris parduzco y pasto entre aproximadamente 0.3 y 6.0 micrómetros. La gráfica muestra que el pasto, por ejemplo, refleja relativamente poca energía en la banda visible (aunque el pico en medio de la banda visible explica por qué la hierba se ve verde). Como la mayoría de la vegetación, la clorofila en el pasto absorbe energía visible (particularmente en las longitudes de onda azul y roja) para su uso durante la fotosíntesis. Alrededor de la mitad de la radiación entrante del infrarrojo cercano se refleja, sin embargo, lo cual es característico de la vegetación saludable e hidratada. El suelo gris parduzco refleja más energía a longitudes de onda más largas que el pasto. El agua absorbe la mayor parte de la radiación entrante en todo el rango de longitudes de onda. Conociendo sus características típicas de respuesta espectral, es posible identificar bosques, cultivos, suelos y formaciones geológicas en imágenes de teledetección, y evaluar su condición.

Los patrones de respuesta espectral de suelo gris parduzco (mollisol), pasto y agua. Para explorar las características de respuesta espectral de miles de materiales naturales y artificiales, visite la Biblioteca Espectral ASTER en http://speclib.jpl.nasa.gov/. (Instituto Tecnológico de California, 2002).

El siguiente gráfico demuestra una de las ventajas de poder ver más allá del espectro visible. Las dos líneas representan los patrones de respuesta espectral de coníferas y árboles caducifolios. Observe que las reflectancias dentro de la banda visual son casi idénticas. A longitudes de onda más largas, cercanas y medias del infrarrojo, sin embargo, los dos tipos son mucho más fáciles de diferenciar. Como verá más adelante, el mapeo de uso del suelo y cobertura del suelo se logró previamente mediante inspección visual de imágenes fotográficas. Los datos multiespectrales y el procesamiento digital de imágenes permiten automatizar parcialmente el mapeo de cobertura terrestre, lo que a su vez hace que sea rentable identificar algunas categorías de uso del suelo y cobertura del suelo automáticamente, todo lo cual permite mapear áreas de mayor tamaño con mayor frecuencia.

Los patrones de respuesta espectral de coníferas y árboles caducifolios (California Institute of Technology, 1999).

Los patrones de respuesta espectral a veces se denominan firmas espectrales. Este término es engañoso, sin embargo, porque la reflectancia de una entidad varía con su condición, la época del año, e incluso la hora del día. En lugar de líneas finas, las respuestas espectrales del agua, el suelo, la hierba y los árboles podrían representarse mejor como franjas anchas para dar cuenta de estas variaciones.

8.6. Escaneo ráster

Los sistemas de teledetección funcionan de la misma manera que el escáner digital plano que puede haber conectado a su computadora personal. Un escáner de escritorio crea una imagen digital de un documento al registrar, píxel a píxel, la intensidad de la luz reflejada desde el documento. El componente que mide la reflectancia se llama cabeza de escaneo, que consiste en una fila de pequeños sensores que convierten la luz en cargas eléctricas. Los escáneres de color pueden tener tres fuentes de luz y tres conjuntos de sensores, uno para cada una de las longitudes de onda azul, verde y roja de la luz visible. Cuando presiona un botón para escanear un documento, el cabezal de escaneo se impulsa rápidamente a través de la imagen, un pequeño paso a la vez, registrando nuevas filas de señales eléctricas a medida que avanza. Los datos detectados de forma remota, como las imágenes producidas por su escáner de escritorio, consisten en valores de reflectancia dispuestos en filas y columnas que componen cuadrículas ráster.

Escáner de escritorio, circa 2000.

Después de que el cabezal de escaneo convierte las reflectancias en señales eléctricas, otro componente, llamado convertidor analógico a digital, convierte las cargas eléctricas en valores digitales. Aunque las reflectancias pueden variar de 0 por ciento a 100 por ciento, los valores digitales suelen oscilar entre 0 y 255. Esto se debe a que los valores digitales se almacenan como unidades de memoria llamadas bits. Un bit representa un único entero binario, 1 o 0. Cuantos más bits de datos se almacenen para cada píxel, más precisamente se pueden representar las reflectancias en una imagen escaneada. El número de bits almacenados para cada píxel se denomina profundidad de bits de una imagen. Una imagen de 8 bits es capaz de representar 28 (256) valores únicos de reflectancia. Un escáner de escritorio en color puede producir imágenes de 24 bits en las que se almacenan 8 bits de datos para cada una de las longitudes de onda azul, verde y roja de la luz visible.

Interpretación artística del satélite de teledetección Landsat 7. El satélite realmente no proyecta un haz de luz de cuatro lados sobre la superficie de la Tierra, por supuesto. En cambio, simplemente registra la energía electromagnética reflejada o emitida por la Tierra. (NASA, 2001).

Como se podría imaginar, escanear la superficie de la Tierra es considerablemente más complicado que escanear un documento en papel con un escáner de escritorio. A diferencia del documento, la superficie de la Tierra es demasiado grande para ser escaneada de una vez, por lo que debe escanearse pieza por pieza, y luego mosaicos juntos. Los documentos son planos, pero la forma de la Tierra es curva y compleja. Los documentos permanecen quietos mientras están siendo escaneados, pero la Tierra gira continuamente alrededor de su eje a una velocidad de más de 1,600 kilómetros por hora. En el escáner de escritorio, el cabezal de escaneo y el documento están separados solo por una placa de vidrio; los sistemas de detección basados en satélites pueden estar a cientos o miles de kilómetros de distancia de sus objetivos, separados por una atmósfera que no es tan transparente como el vidrio. Y si bien un documento en un escáner de escritorio se ilumina de manera uniforme y consistente, la cantidad de energía solar reflejada o emitida desde la superficie de la Tierra varía con la latitud, la época del año, e incluso la hora del día. Todas estas complejidades se combinan para producir datos con distorsiones geométricas y radiométricas que deben corregirse antes de que los datos sean útiles para el análisis. Más adelante en este capítulo conocerás algunas de las técnicas de procesamiento de imágenes utilizadas para corregir los datos de imagen detectados remotamente.

8.7. Resolución

Hasta ahora has leído que los sistemas de teledetección miden la radiación electromagnética, y que registran mediciones en forma de datos de imágenes ráster. La resolución de los datos de imagen de detección remota varía de varias maneras. Como usted recuerda, la resolución es la diferencia menos detectable en una medición. En este contexto, tres de los tipos más importantes son la resolución espacial, la resolución radiométrica y la resolución espectral.

La resolución espacial se refiere a la aspereza o finura de una cuadrícula ráster. Las celdas de cuadrícula en datos de alta resolución, como las producidas por imágenes aéreas digitales, o por el satélite Ikonos, corresponden a áreas terrestres pequeñas o menores de un metro cuadrado. Los datos de detección remota cuyas celdas de cuadrícula oscilan entre 15 y 80 metros en un lado, como los sensores Landsat ETM+ y MSS, se consideran de resolución media. Las celdas en datos de baja resolución, como las producidas por el sensor AVHRR de la NOAA, se miden en kilómetros. (Aprenderás más sobre todos estos sensores más adelante en este capítulo).

La resolución espacial es una medida de la aspereza o finura de una cuadrícula ráster.

Cuanto mayor sea la resolución espacial de una imagen digital, más detalle contiene. El detalle es valioso para algunas aplicaciones, pero también es costoso. Consideremos, por ejemplo, que una imagen de 8 bits de toda la Tierra cuya resolución espacial es de un metro podría llenar 78,400 discos CD-ROM, una pila de más de 250 pies de altura (asumiendo que los datos no fueron comprimidos). Aunque las técnicas de compresión de datos reducen en gran medida los requisitos de almacenamiento, los costos de almacenamiento y procesamiento asociados con los datos satelitales de alta resolución a menudo hacen que los datos de resolución media y baja sean preferibles para análisis de

Un segundo aspecto de la resolución es la resolución radiométrica, la medida de la capacidad de un sensor para discriminar pequeñas diferencias en la magnitud de la radiación dentro del área terrestre que corresponde a una sola celda ráster. Cuanto mayor sea la profundidad de bits (número de bits de datos por píxel) de las imágenes que registra un sensor, mayor es su resolución radiométrica. El sensor AVHRR, por ejemplo, almacena 210 bits por píxel, a diferencia de los 28 bits que registran los sensores Landsat. Así, aunque su resolución espacial es muy gruesa (~4 km), el Radiómetro Avanzado de Muy Alta Resolución toma su nombre de su alta resolución radiométrica.

Resolución radiométrica. El área bajo la curva representa la magnitud de la energía electromagnética emitida por el Sol a diversas longitudes de onda. Los sensores con baja resolución radiométrica son capaces de detectar solo diferencias relativamente grandes en la magnitud de la energía (como lo representa la banda púrpura más clara y gruesa). Los sensores con alta resolución radiométrica son capaces de detectar diferencias relativamente pequeñas (representadas por la banda más oscura y más delgada).

Finalmente, existe la resolución espectral, la capacidad de un sensor para detectar pequeñas diferencias en la longitud de onda. Por ejemplo, la película pancromática es sensible a una amplia gama de longitudes de onda. Un objeto que refleje mucha energía en la porción verde de la banda visible sería indistinguible en una foto pancromática de un objeto que reflejara la misma cantidad de energía en la banda roja, por ejemplo. Un sistema de detección con mayor resolución espectral facilitaría distinguir los dos objetos.

Resolución espectral. El área bajo la curva representa la magnitud de la energía electromagnética emitida por el Sol a diversas longitudes de onda. Los sensores de baja resolución registran energía dentro de bandas de longitud de onda relativamente anchas (representadas por la banda púrpura más ligera y gruesa). Los sensores de alta resolución registran energía dentro de bandas estrechas (representadas por la banda más oscura y más delgada)

8.8. Visita al sitio a USGS Earthshots

¡PRUEBA ESTO!

El siguiente ejercicio implica una visita a Earthshots, un sitio World Wide Web creado por el USGS para dar a conocer las múltiples contribuciones de la teledetección al campo de la ciencia ambiental. Allí podrá ver y comparar ejemplos de imágenes producidas a partir de datos de Landsat.

El USGS ha revisado recientemente el sitio web de Earthshots y lo ha hecho más amigable para los laicos. Desafortunadamente, el nuevo sitio es mucho menos valioso para nuestra misión educativa. Afortunadamente, sin embargo, las páginas web más antiguas todavía están disponibles. Entonces, después de llevarte brevemente a la nueva página de Earthshots, en el paso 1, te dirigiré a las páginas más antiguas que son más informativas para nosotros.

1. Para comenzar, apunte su navegador al sitio más nuevo de Earthshots. Sigue adelante y explora este sitio. Anote la información que se encuentra siguiendo el botón Acerca de Earthshots.

2. A continuación, vaya al sitio de USGS Earthshots.

3. Ver imágenes producidas a partir de datos de Landsat Sigue el enlace al ejemplo de Garden City, Kansas. Se te presentará una imagen creada a partir de datos Landsat de Garden City, Kansas en 1972. Al hacer clic en el enlace de fecha debajo de la esquina inferior izquierda de la imagen, puede comparar imágenes producidas a partir de los datos de Landsat recopilados en 1972 y 1988.

4. Amplíe una porción de la imagen Cuatro marcas de esquina amarillas delinean una porción de la imagen que está vinculada a una vista ampliada. Haga clic dentro de las garrapatas para ver la imagen ampliada.

5. Ver una fotografía tomada en el suelo Haga clic en uno de los pequeños iconos de cámara dispuestos uno encima del otro en el barrio occidental de la imagen. Aparecerá una fotografía tomada en el suelo.

6. Explora artículos vinculados al ejemplo Encuentra respuestas a las siguientes preguntas en los artículos relacionados titulados Qué significan los colores, Cómo representan las imágenes los datos de Landsat, bandas MSS y TM, y Más allá de mirar imágenes.

- ¿Cuál es la sensibilidad espectral del sensor Landsat MSS utilizado para capturar los datos de la imagen?

- ¿Qué bandas de longitud de onda están representadas en la imagen?

- ¿Qué significa el color rojo?

- ¿Cómo se utilizó el “estiramiento de contraste” para mejorar las imágenes?

- ¿Cuál es la resolución espacial de los datos MSS a partir de los cuales se produjeron las imágenes?

PRÁCTICA

Los estudiantes registrados de Penn State deben regresar ahora a la carpeta Capítulo 8 en ANGEL (a través del menú Recursos a la izquierda) para realizar un cuestionario de autoevaluación sobre la Naturaleza de los Datos de Imagen.

Puedes tomar cuestionarios de práctica tantas veces como desees. No se califican y no afectan tu calificación de ninguna manera.

8.9. Datos de Imagen Visible e Infrarroja

A continuación, exploramos ejemplos de datos de imágenes de detección remota producidos mediante la medición de energía electromagnética en las bandas visible, infrarrojo cercano e infrarrojo térmico. La fotografía aérea se reconsidera como un dato de imagen analógico a digital. Se comparan las características de los datos pancromáticos producidos por cámaras satelitales y sensores como KVR 1000, IKONOS y DMSP, así como datos multiespectrales producidos por AVHRR, Landsat y SPOT. Concluimos con la oportunidad de comprar datos de imágenes satelitales en línea.

8.10. Imágenes Aéreas

Sin contar la visión humana, la fotografía aérea es la tecnología de teledetección más temprana. Un fotógrafo parisino presuntamente tomó la primera foto aérea de un globo en 1858. Si eres (o fuiste) un fotógrafo que usa cámaras de cine, probablemente sepas que las películas fotográficas están compuestas por capas. Una o más capas consisten en emulsiones de cristales de haluro de plata sensibles a la luz. La película en blanco y negro utilizada con mayor frecuencia para la fotografía aérea consiste en una sola capa de cristales de plata que son sensibles a toda la banda visible del espectro electromagnético. Los datos producidos a partir de películas fotográficas y sensores digitales que son sensibles a toda la banda visible se denominan pancromáticos.

Cuando se exponen a la luz, los cristales de haluro de plata se reducen a plata metálica negra. Cuanta más luz absorbe un cristal, más oscuro se vuelve cuando se desarrolla la película. Una foto pancromática en blanco y negro representa así las intensidades de la energía electromagnética visible registrada a través de la superficie de la película en el momento de la exposición. Se puede pensar en un cristal de haluro de plata como un análogo físico para un píxel en una imagen digital.

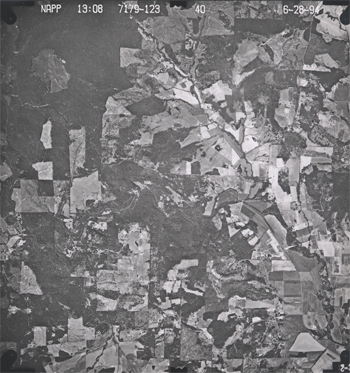

Fotografía aérea vertical producida a partir de película pancromática.

Los fotógrafos de películas experimentados saben usar películas de alta velocidad para capturar una imagen en un entorno de poca luz. También saben que las películas más rápidas tienden a producir imágenes más granuladas. Esto se debe a que las películas rápidas contienen granos de haluro de plata más grandes, que son más sensibles a la luz que los granos más pequeños. Las películas utilizadas para la fotografía aérea deben ser lo suficientemente rápidas como para capturar imágenes nítidas de aviones que se mueven a cientos de pies por segundo, pero no tan rápidas como para producir imágenes tan granuladas que enmascaren detalles importantes. Así, el tamaño de grano de una película fotográfica es un análogo físico para la resolución espacial de una imagen digital. Cowen y Jensen (1998) estimaron que la resolución espacial de una fotografía aérea de alta resolución era de aproximadamente 0.3-0.5 metros (30-50 cm). Desde entonces, la resolución que se puede lograr mediante imágenes aéreas digitales ha aumentado hasta llegar a 0.05 metros (5 cm). Para aplicaciones en las que se necesitan resoluciones espaciales y temporales máximas, la imagen aérea (a diferencia de satélite) aún tiene sus ventajas.

Anteriormente en el curso aprendiste (o quizás ya sabías) que el Programa Nacional de Imágenes Agrícolas de Estados Unidos (NAIP) vuela gran parte de los 48 estados inferiores cada año. Las organizaciones que necesitan imágenes más oportunas suelen contratar empresas privadas de reconocimiento aéreo para volar misiones de fotografía personalizadas. La mayoría de las organizaciones preferirían tener datos de imagen en forma digital, si es posible, ya que el procesamiento digital de imágenes (incluyendo la corrección geométrica y radiométrica) es más eficiente que los métodos de cuarto oscuro comparables, y porque la mayoría de los usuarios quieren combinar imágenes con otras capas de datos en bases de datos GIS. Los datos de imagen digital se están convirtiendo en una alternativa rentable para muchas aplicaciones a medida que aumenta la resolución espacial y radiométrica de los sensores digitales.

8.11. Datos de imagen pancromática de alta resolución

Así como las cámaras digitales han reemplazado a las cámaras de película para muchos de nosotros en el suelo, los sensores digitales están reemplazando a las cámaras para levantamientos aéreos. Esta sección describe dos fuentes de imágenes pancromáticas digitales con suficiente resolución geométrica para algunas, aunque ciertamente no todas, tareas de mapeo a gran escala. También se considera un sistema de detección pancromática con suficiente resolución radiométrica para detectar desde el espacio la luz emitida por los asentamientos humanos por la noche.

KVR-1000/SPIN-2

Los datos de imágenes pancromáticas de alta resolución se pusieron a disposición de los civiles por primera vez en 1994, cuando la agencia espacial rusa SOVINFORMSPUTNIK comenzó a vender fotos de vigilancia para recaudar dinero tras la ruptura de la Unión Soviética. Las fotos son tomadas con un extraordinario sistema de cámara llamado KVR 1000. Las cámaras KVR 1000 están montadas en cápsulas espaciales no tripuladas muy parecidas a aquella en la que el cosmonauta ruso Yuri Gagarin viajó por primera vez al espacio en 1961. Después de orbitar la Tierra a altitudes de 220 kilómetros durante unos 40 días, las cápsulas se separan de los cohetes Cosmos que las impulsaron al espacio, y en espiral lentamente de regreso a la Tierra. Después de que las cápsulas salen en paracaídas a la superficie, el personal de tierra recupera las cámaras y las transporta a Moscú, donde se desarrolla la película. Las fotografías son luego enviadas a Estados Unidos, donde son escaneadas y procesadas por Kodak Corporation. El producto final es de dos metros de resolución, georreferenciados y datos digitales ortorrectificados llamados SPIN-2 (Información Espacial 2-Meter). Una firma llamada Aerial Images Inc. fue licenciada en 1998 para distribuir datos SPIN-2 en Estados Unidos (SPIN-2, 1999).

Porción de una imagen SPIN-2 de Dallas, Texas.

© 2006 Aerial Images, Inc. Todos los derechos reservados. Usado por Permiso.

IKONOS

También en 1994, cuando la agencia espacial rusa comenzó a vender sus imágenes de vigilancia espacial, se fletó en Estados Unidos una nueva compañía llamada Space Imaging, Inc. reconociendo que las imágenes de alta resolución estaban disponibles comercialmente de fuentes extranjeras competidoras, el gobierno de Estados Unidos autorizó firmas privadas bajo su jurisdicción para producir y comercializar datos de teledetección a resoluciones espaciales de hasta un metro. Para 1999, después de un primer intento fallido, Space Imaging lanzó con éxito su satélite Ikonos I en una trayectoria orbital que rodea la Tierra 640 km sobre la superficie, de polo a polo, cruzando el ecuador a la misma hora del día todos los días. Tal órbita se denomina órbita polar síncrona solar, en contraste con las órbitas geosincrónicas de las comunicaciones y algunos satélites meteorológicos que permanecen sobre el mismo punto en la superficie de la Tierra en todo momento.

Porción de una imagen pancromática de 1 metro de resolución de Washington, DC producida por el sensor

Ikonos I. © 2001 Space Imaging, inc. Todos los Derechos Reservados. Usado con permiso.

El sensor pancromático de Iconos registra reflectancias en la banda visible a una resolución espacial de un metro y una profundidad de bit de once bits por píxel. La profundidad de bits expandida permite que el sensor registre reflectancias con mayor precisión y permite a los técnicos filtrar la neblina atmosférica de manera más efectiva de lo que es posible con imágenes de 8 bits. Las imágenes de Ikonos archivadas, no rectificadas y pancromáticas dentro de Estados Unidos están disponibles por tan solo 7 dólares por kilómetro cuadrado, pero las nuevas imágenes ortorrectificadas cuestan 28 dólares por kilómetro cuadrado y más.

Una firma competidora llamada ORBIMAGE adquirió Space Imaging a principios de 2006, después de que ORBIMAGE obtuvo un contrato de 500 millones de dólares con la Agencia Nacional de Inteligencia Geoespacial. Las empresas fusionadas se llamaron GeoEye, Inc. A principios de 2013 GeoEye se fusionó con la corporación DigitalGlobe. Un satélite llamado GeoEye-1 fue lanzado en 2008 y proporciona resolución pancromática submétrica (0.41 metros) (GeoEye, 2007). En 2013 entrará en funcionamiento un nuevo satélite llamado GeoEye-2. Tendrá una resolución pancromática de 0.34 metros.

DMSP

La Fuerza Aérea de Estados Unidos inició su Programa Satélite de Meteorología de Defensa (DMSP) a mediados de la década de 1960. Para 2001, habían lanzado quince satélites DMSP. Los satélites siguen órbitas polares a altitudes de unos 830 km, dando vueltas a la Tierra cada 101 minutos.

El objetivo original del programa era proporcionar imágenes que ayudaran a la navegación a gran altitud por parte de los pilotos de la Fuerza Aérea. Los satélites DMSP llevan varios sensores, uno de los cuales es sensible a una banda de longitudes de onda que abarca las longitudes de onda visibles y del infrarrojo cercano (0.40-1.10 µm). La resolución espacial de este sensor pancromático es baja (2.7 km), pero su resolución radiométrica es lo suficientemente alta como para registrar la luz de la luna reflejada desde las cimas de las nubes por la noche. Durante lunas nuevas sin nubes, el sensor es capaz de detectar las luces emitidas por ciudades y pueblos. Los analistas de imagen han correlacionado satisfactoriamente patrones de luces nocturnas con estimaciones de densidad de población producidas por la Oficina del Censo de Estados Unidos, lo que permite a los analistas utilizar imágenes DMSP (en combinación con otras capas de datos, como redes de transporte) para monitorear los cambios en la distribución global de la población.

Imagen compuesta de la Tierra en la noche mostrando luces de ciudades y pueblos de todo el mundo. Esta imagen fue registrada por sensores satelitales DMSP. (Centro de Datos Geofísicos, 2005).

8.12. Datos de imagen multiespectrales

En la sección anterior se destacaron los datos pancromáticos de un metro producidos por el sensor satelital IKONOS. Sin embargo, los datos de pan no son todo lo que produce IKONOS. Es un sensor multiespectral que registra reflectancias dentro de otras cuatro bandas (más estrechas), incluyendo las longitudes de onda azul, verde y roja del espectro visible, y la banda del infrarrojo cercano. El rango (s) de longitudes de onda que un sensor es capaz de detectar se llama su sensibilidad espectral.

| Sensibilidad espectral | Resolución espacial |

|---|---|

| 0.45 — 0.90 μm (pancromático) | 1m |

| 0.45 — 0.52 μm (azul visible) | 4m |

| 0.51 — 0.60 μm (verde visible) | 4m |

| 0.63 — 0.70 μm (rojo visible) | 4m |

| 0.76 — 0.85 μm (cerca de IR) | 4m |

Sensibilidades espectrales y resolución espacial del sensor IKONOS I. Las longitudes de onda se expresan en micrómetros (millonésimas de metro). La resolución espacial se expresa en metros.

Esta sección perfila dos familias de sensores multiespectrales que desempeñan un papel importante en la caracterización del uso del suelo y la cobertura del suelo: AVHRR y Landsat.

AVHRR

AVHRR significa “Radiómetro avanzado de muy alta resolución”. Los sensores AVHRR han estado a bordo de dieciséis satélites mantenidos por la Administración Nacional Oceánica y Atmosférica (NOAA) desde 1979 (TIROS-N, NOAA-6 a NOAA-15). Los datos que producen los sensores son ampliamente utilizados para estudios de gran superficie de vegetación, humedad del suelo, capa de nieve, susceptibilidad al fuego e inundaciones, entre otras cosas.

Los sensores AVHRR miden la energía electromagnética dentro de cinco bandas espectrales, incluyendo rojo visible, infrarrojo cercano y tres infrarrojos térmicos. Las bandas visibles rojas e infrarrojas cercanas son particularmente útiles para el monitoreo de vegetación de gran área. El Índice de Vegetación de Diferencia Normalizada (NDVI), una medida ampliamente utilizada de la actividad fotosintética que se calcula a partir de los valores de reflectancia en estas dos bandas, se discute más adelante.

| Sensibilidad espectral | Resolución espacial |

|---|---|

| 0.58 — 0.68 μm (rojo visible) | 1-4 km* |

| 0.725 — 1.10 μm (cerca de IR) | 1-4 km* |

| 3.55 — 3.93 μm (IR térmico) | 1-4 km* |

| 10.3 — 11.3 μm (IR térmico) | 1-4 km* |

| 11.5 — 12.5 μm (IR térmico) | 1-4 km* |

Sensibilidades espectrales y resolución espacial del sensor AVHRR. Las longitudes de onda se expresan en micrómetros (millonésimas de metro). La resolución espacial se expresa en kilómetros (miles de metros). *La resolución espacial de los datos AVHRR varía de 1 km a 16 km. Los datos procesados consisten en cuadrículas uniformes de 1 km o 4 km.

Los satélites NOAA que transportan sensores AVHRR trazan órbitas polares sincrónicas solares a altitudes de aproximadamente 833 km. Al viajar a velocidades terrestres de más de 6.5 kilómetros por segundo, los satélites orbitan la Tierra 14 veces al día (cada 102 minutos), cruzando los mismos lugares a lo largo del ecuador a la misma hora todos los días. A medida que orbita, el sensor AVHRR barre un cabezal de escaneo a lo largo de un arco de 110° de ancho debajo del satélite, tomando muchas mediciones cada segundo. (Se dice que el movimiento de barrido de ida y vuelta del cabezal de escaneo se asemeja a una escoba batidora). El arco corresponde a una franja de tierra de unos 2400 km. Debido a que el cabezal de escaneo atraviesa un arco tan ancho, su campo de visión instantáneo (IFOV: el área del suelo cubierta por un solo píxel) varía mucho. Directamente debajo del satélite, el IFOV tiene aproximadamente 1 km cuadrados. Cerca del borde de la franja, sin embargo, el IFOV se expande a más de 16 kilómetros cuadrados. Para lograr una resolución uniforme, los IFOV distorsionados cerca de los bordes de la franja deben remuestrearse a una cuadrícula de 1 km (El remuestreo se discute más adelante en este capítulo). El sensor AVHRR es capaz de producir cobertura global diaria en la banda visible y cobertura dos veces al día en la banda térmica IR.

Para obtener más información, visite la página de inicio de AVHRR de USGS.

LANDSAT MSS

Las imágenes televisivas de la Tierra tomadas de satélites meteorológicos tempranos (como TIROS-1, lanzado en 1960), y fotografías tomadas por astronautas durante los programas espaciales tripulados de Estados Unidos en la década de 1960, hicieron que los científicos se preguntaran sobre cómo podrían usarse tales imágenes para el manejo de recursos ambientales. A mediados de la década de 1960, la Administración Nacional de Aeronáutica y del Espacio de Estados Unidos (NASA) y el Departamento del Interior comenzaron a trabajar en un plan para lanzar una serie de sensores orbitales basados en satélites. El programa de Satélite de Tecnología de Recursos Terrestres lanzó su primer satélite, ERTS-1, en 1972. Cuando se lanzó el segundo satélite en 1975, la NASA renombró el programa Landsat. Desde entonces, ha habido seis lanzamientos exitosos de Landsat (Landsat 6 fracasó poco después del despegue en 1993; Landsat 7 se lanzó con éxito en 1999).

Dos sistemas de detección estaban a bordo del Landsat 1 (antes ERTS-1): un Videcon de Haz de Retorno (RBV) y un Escáner Multiespectral (MSS). El sistema RBV es análogo a las cámaras digitales actuales. Detectó radiación en la banda visible durante una escena completa de 185 km cuadrados a la vez, produciendo imágenes comparables a las fotografías en color. El sensor RBV se suspendió después de Landsat 3, debido a un rendimiento errático y una falta general de interés en los datos que produjo.

El sensor MSS, sin embargo, gozó de mucho más éxito. De 1972 a 1992 se utilizó para producir un archivo de más de 630,000 escenas. El MSS mide la radiación dentro de cuatro bandas estrechas: una que abarca longitudes de onda verdes visibles, otra que abarca longitudes de onda rojas visibles y dos más que abarcan longitudes de onda del infrarrojo cercano ligeramente más largas.

| Sensibilidad espectral | Resolución espacial |

|---|---|

| 0.5 — 0.6 μm (verde visible) | 79/82 m* |

| 0.6 — 0.7 μm (rojo visible) | 79/82 m* |

| 0.7 — 0.8 μm (cerca de IR) | 79/82 m* |

| 0.8 — 1.1 μm (cerca de IR) | 79/82 m* |

Sensibilidades espectrales y resolución espacial del sensor Landsat MSS. Las longitudes de onda se expresan en micrómetros (millonésimas de metro). La resolución espacial se expresa en metros. *Los sensores MSS a bordo de Landsats 4 y 5 tenían una resolución nominal de 82 m, lo que incluye 15 metros de superposición con escena anterior.

Los Landsats 1 a 3 trazaron órbitas casi polares a altitudes de aproximadamente 920 km, orbitando la Tierra 14 veces al día (cada 103 minutos). Landsats 4 y 5 orbitan a 705 km de altitud. El sensor MSS barre una matriz de seis detectores de energía a través de un arco de menos de 12°, produciendo seis filas de datos simultáneamente en una franja de tierra de 185 km. Los satélites Landsat orbitan la Tierra a altitudes y velocidades similares a las de los satélites que transportan AVHRR, pero debido a que la franja de exploración MSS es mucho más estrecha que AVHRR, tarda mucho más (18 días para Landsat 1-3, 16 días para Landsats 4 y 5) para escanear toda la superficie de la Tierra.

Tres escenas producidas por un Escáner Multiespectral Landsat. Las imágenes revelan la selva amazónica despejada en el estado brasileño de Rondonia entre 1975 y 1992. Las áreas rojas representan vegetación saludable (USGS, 2001).

La secuencia de tres imágenes mostradas arriba cubren la misma porción del estado de Rondonia, Brasil. Las reflectancias en la banda del infrarrojo cercano están codificadas en rojo en estas imágenes; las reflectancias medidas en las bandas visible verde y roja se codifican en azul y verde. Dado que la vegetación absorbe la luz visible, pero refleja energía infrarroja, las áreas azul-verdes indican tierras despejadas. La detección de cambios en el uso del suelo es uno de los usos más valiosos de la imagen multiespectral.

Para obtener más información, visite la página de inicio Landsat de USGS

LANDSAT TM Y ETM+

Mientras la NASA se preparaba para lanzar Landsat 4 en 1982, reemplazó el fallido sensor RBV por un nuevo sistema de detección llamado Thematic Mapper (TM). TM fue una versión nueva y mejorada de MSS que presentó mayor resolución espacial (30 metros en la mayoría de los canales) y sensibilidad espectral expandida (siete bandas, incluyendo azul visible, verde visible, rojo visible, infrarrojo cercano, dos longitudes de onda de infrarrojo medio e infrarrojo térmico). Un sensor Enhanced Thematic Mapper Plus (ETM+), que incluye una octava banda (pancromática) con una resolución espacial de 15 metros, estaba a bordo del Landsat 7 cuando se lanzó con éxito en 1999.

| Sensibilidad espectral | Resolución espacial |

|---|---|

| 0.522 -0.90 μm (pancromático) * | 15 m* |

| 0.45 — 0.52 μm (azul visible) | 30 m |

| 0.52 — 0.60 μm (verde visible) | 30 m |

| 0.63 — 0.69 μm (rojo visible) | 30 m |

| 0.76 — 0.90 μm (cerca de IR) | 30 m |

| 1.55 — 1.75 μm (IR medio) | 30 m |

| 10.40 — 12.50 μm (IR térmico) | 120 m (Landsat 4-5) 60 m (Landsat 7) |

| 2.08 — 2.35 μm (IR medio) | 30 m |

Sensibilidades espectrales y resolución espacial de los sensores Landsat TM y ETM. Las longitudes de onda se expresan en micrómetros (millonésimas de metro). La resolución espacial se expresa en metros. Observe la menor resolución espacial en la banda térmica IR, lo que permite una mayor resolución radiométrica. *ETM+/Landsat 7 solamente.

Las sensibilidades espectrales de los sensores TM y ETM+ están en sintonía tanto con las características de respuesta espectral de los fenómenos que los sensores están diseñados para monitorear, como con las ventanas dentro de las cuales la energía electromagnética es capaz de penetrar en la atmósfera. En la siguiente tabla se describen algunos de los fenómenos que son revelados por cada una de las bandas de longitudes de onda, fenómenos que son mucho menos evidentes solo en los datos de imagen pancromática.

| Banda | Fenómenos Revelados |

|---|---|

| 0.45 — 0.52 μm (azul visible) | Líneas de costa y profundidades de agua (estas longitudes de onda penetran en el agua) |

| 0.52 — 0.60 μm (verde visible) | Tipos de plantas y vigor (la vegitación máxima refleja estas longitudes de onda fuertemente) |

| 0.63 — 0.69 μm (rojo visible) | Actividad fotosintética (las plantas absorben estas longitudes de onda durante la fotosíntesis) |

| 0.76 — 0.90 μm (cerca de IR) | Vigor de la planta (el tejido vegetal sano refleja estas longitudes de onda fuertemente) |

| 1.55 — 1.75 μm (IR medio) | Estrés hídrico de las plantas, humedad del suelo, tipos de rocas, nubosidad vs nieve |

| 10.40 — 12.50 μm (IR themal) | Cantidades relativas de calor, humedad del suelo |

| 2.08 — 2.35 μm (IR medio) | Estrés hídrico de las plantas, minerales y tipos de roca |

Imágenes producidas a partir de 8 bandas de datos Landsat 7 ETM de Denver, CO. Cada imagen en la ilustración representa los valores de reflectancia registrados en cada banda de longitud de onda. Las imágenes en color falso se producen coloreando tres bandas (por ejemplo, las bandas visibles verdes, rojas visibles y cercanas al infrarrojo) usando azul, verde y rojo, como las capas en la película fotográfica en color.

Hasta 1984, los datos Landsat fueron distribuidos por el gobierno federal de Estados Unidos (originalmente por el Centro de Datos EROS del USGS, más tarde por la NOAA). Los datos producidos por las misiones Landsat 1 a 4 todavía están disponibles para la venta de EROS. Sin embargo, con la Ley de Comercialización de Teledetección Terrestre de 1984, el Congreso de Estados Unidos privatizó el programa Landsat, transfiriendo la responsabilidad de construcción y lanzamiento de Landsat 5, y de distribución de los datos que produjo, a una firma llamada EOSAT.

Insatisfechos con los costos prohibitivos de los datos no subsidiados (hasta $4,400 por una sola escena de 185 km por 170 km), los usuarios impulsaron al Congreso a aprobar la Ley de Política de Teledetección Terrestre de 1992. La nueva legislación devolvió la responsabilidad del programa Landsat al gobierno de Estados Unidos. Los datos producidos por Landsat 7 son distribuidos por el USGS a un costo a los usuarios de 600 dólares por escena (alrededor de 2 centavos por kilómetro cuadrado). Las escenas que incluyen brechas de datos causadas por una falla de “corrector de línea de escaneo” se venden por 250 dólares; 275 dólares por escenas en las que los huecos se llenan con datos anteriores.

¡PRUEBA ESTO!

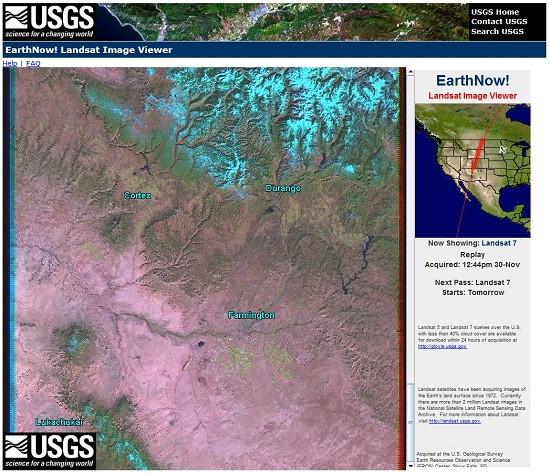

Usted puede optar por visitar EarthNow de USGS! Landsat Image Viewer, que permite visualizar en vivo la adquisición de imágenes Landsat 5 y Landsat 7. Este sitio tiene un enlace al Visor de Visualización Global de USGS donde se pueden buscar imágenes basadas en el porcentaje de cobertura de nubes.

Una instantánea de EarthNow en vivo! Visor de imágenes Landsat (USGS, 2011).

8.13. Uso de EarthExplorer para buscar datos de Landsat

¡PRUEBA ESTO!

Esta actividad implica utilizar el sistema EarthExplorer del USGS para encontrar datos Landsat que corresponden a la escena del área de Denver, Colorado ilustrada anteriormente. Al final del experimento puedes buscar datos en tu propia área de interés.

EarthExplorer es una aplicación web que permite a los usuarios encontrar, previsualizar y descargar o ordenar datos digitales publicados por el Servicio Geológico de los Estados Unidos. Además de los datos de Landsat MSS, TM y ETM+, AVHRR, DOQ, fotografía aérea y otros datos también están disponibles en el sitio.

Comience apuntando su navegador a EarthExplorer. (Al hacer clic en este enlace se abre una ventana separada con el sitio web de EarthExplorer. Puede ampliar la ventana y trabajar dentro de ella, o si lo prefiere, abrir un navegador separado y escribir la dirección web de EarthExplorer.)

- No es necesario registrarse para utilizar EarthExplorer, a menos que quiera descargar datos.

- Para descomprimir los archivos de datos que podrías elegir descargar necesitarás una aplicación que sea capaz de descomprimir un archivo.tar.gz. Una de esas aplicaciones es 7-Zip. Puedes descargar 7-Zip aquí

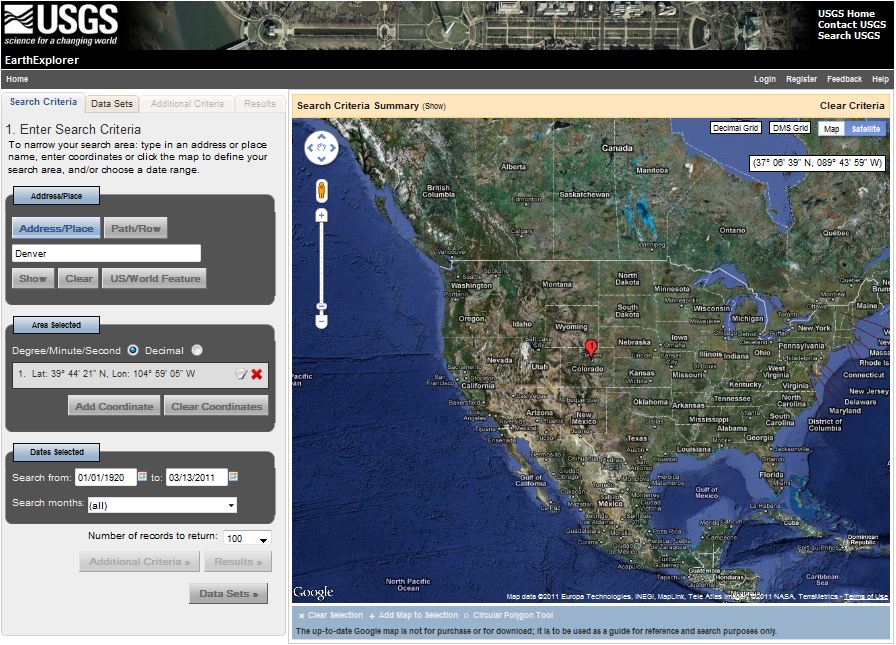

1. Introduce tus criterios de búsqueda

- Ingresar Dirección/Nombre del lugar: Denver en la primera pestaña Criterios de búsqueda

- Haga clic en el botón Dirección/Nombre del lugar Mostrar

- Se devuelve “Denver, CO, USA” (al igual que varias otras coincidencias en la cadena “Denver”), junto con las coordenadas de latitud y longitud necesarias para realizar una búsqueda espacial en la base de datos de EarthExplorer. Haga clic en la opción Denver, CO, USA de la lista. Puede tomar varios segundos, pero la pantalla de la izquierda cambiará para mostrar solo las coordenadas de ubicación para Denver, CO, y aparecerá un marcador de ubicación en el mapa. Ver abajo.

Página de inicio de EarthExplorer, marzo de 2011.

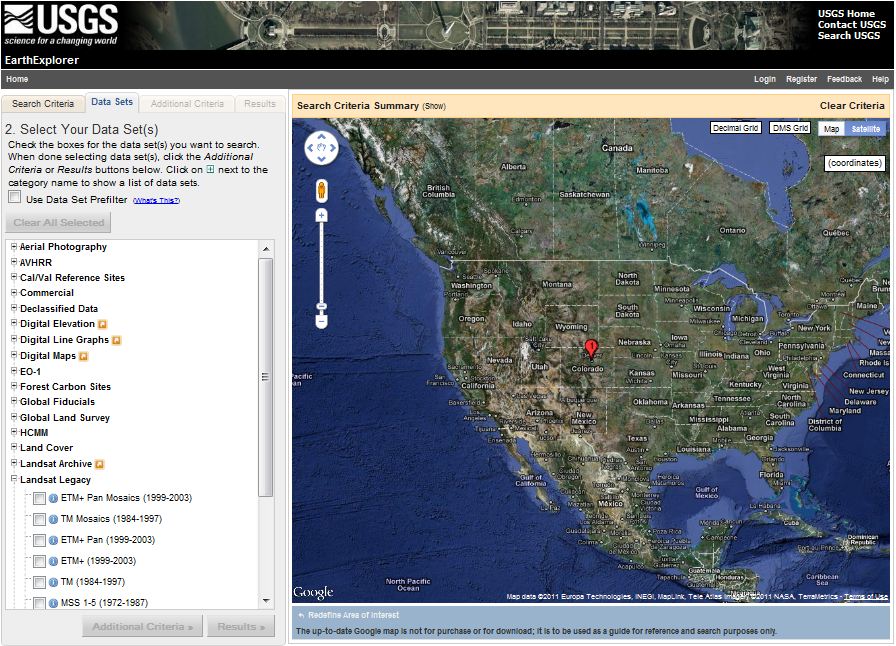

2. Selecciona tu (s) Conjunto (s) de Datos Nuestro objetivo es encontrar los datos de Landsat ETM+ que se ilustran, banda por banda, en la página anterior.

- En el marco en el lado izquierdo de la ventana haga clic en la segunda pestaña Conjuntos de datos

- Marque la casilla de verificación para seleccionar ETM+ (1999-2003) en Landsat Legacy.

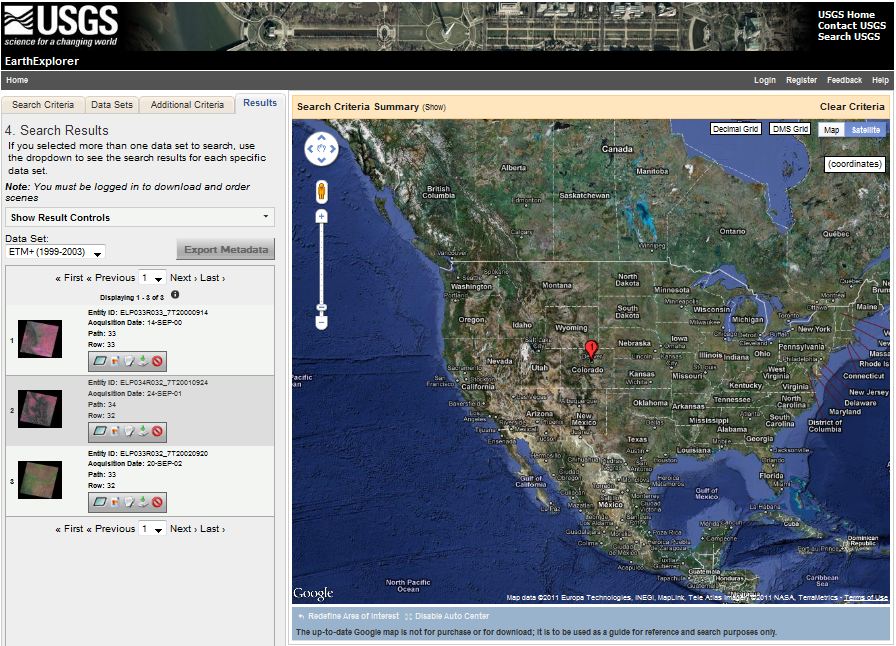

3. Ver tus resultados

- La lista de Resultados se mostrará en la cuarta pestaña.

- Haga clic en el icono de imagen de uno de los resultados para mostrar una visualización completa de ese resultado, incluida la información de atributos.

- Haga clic en el icono “Mostrar superposición de navegación” o en el icono “Mostrar huella” para mostrar y superponer o colocar sobre el mapa de Google.

- Haga clic en “Descargar” para descargar un resultado específico. (NOTA: Deberá iniciar sesión o registrarse y luego iniciar sesión en el USGS para descargar datos.)

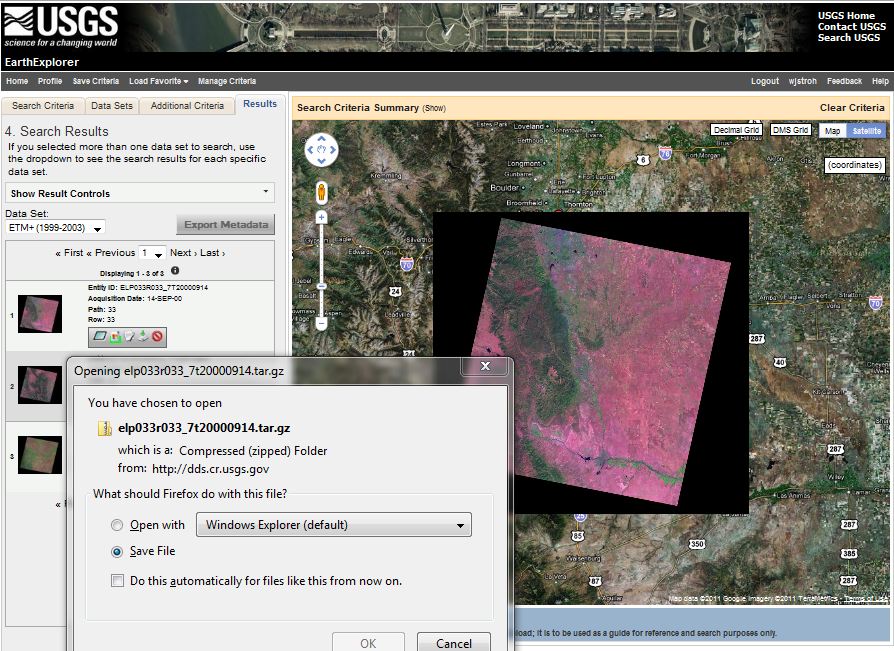

Imagen de superposición y huella de escena Landsat y cuadro de diálogo de descarga, EarthExplorer, marzo de 2011.

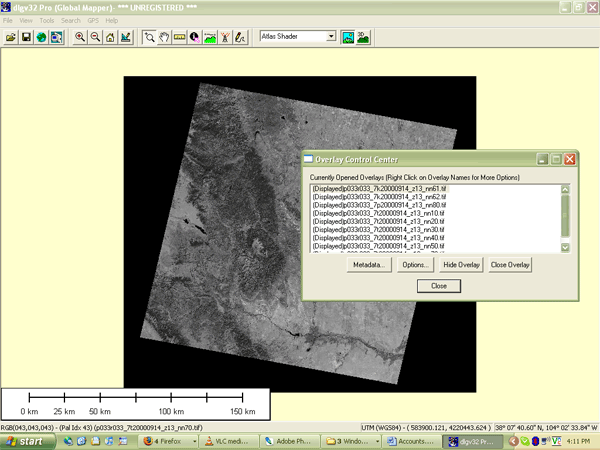

Los datos descargados llegan a tu escritorio en un formato de archivo comprimido doble. Por ejemplo, el archivo que descargué se llama “elp033r033_7t20000914.tar.gz” Para abrir y ver los datos en Global Mapper/dlgv32 Pro, primero tuve que extraer el archivo.tar del archivo.gz, luego extraer los archivos.tif del archivo.tar. Utilicé la aplicación 7-Zip, que mencioné anteriormente, para extraer los archivos: haga clic derecho en un archivo, luego elija 7-Zip > Extraer archivos... La captura de pantalla a continuación muestra una de las ocho imágenes de Landsat (correspondientes a las ocho bandas de ETM+) en Global Mapper.

Escena Landsat vista en el software Global Mapper.

Utilice EarthExplorer para encontrar datos de Landsat para su propia área de interés

- Use el enlace Redefinir Criterios en la parte inferior de la página de Resultados para comenzar una nueva búsqueda. Intenta buscar tu ciudad natal o un lugar que siempre has querido visitar.

PRÁCTICA

Los estudiantes registrados de Penn State deben regresar ahora a la carpeta Capítulo 8 en ANGEL (a través del menú Recursos a la izquierda) para realizar un cuestionario de autoevaluación sobre Datos Visibles e Infrarrojos.

Puedes tomar cuestionarios de práctica tantas veces como desees. No se califican y no afectan tu calificación de ninguna manera.

8.14. Procesamiento de imágenes multiespectrales

Una de las principales ventajas de los datos digitales es que pueden procesarse fácilmente usando computadoras digitales. En las siguientes páginas nos centramos en las técnicas de procesamiento de imágenes digitales utilizadas para corregir, mejorar y clasificar los datos de imágenes de detección remota.

8.15. Corrección de imagen

Como se sugirió anteriormente, escanear la superficie de la Tierra desde el espacio es como escanear un documento en papel con un escáner de escritorio, solo que mucho más complicado. Los datos brutos de imágenes de detección remota están llenos de defectos geométricos y radiométricos causados por la forma curva de la Tierra, la atmósfera imperfectamente transparente, las variaciones diarias y estacionales en la cantidad de radiación solar recibida en la superficie y las imperfecciones en los instrumentos de escaneo, entre otras cosas. Comprensiblemente, la mayoría de los usuarios de datos de imágenes de detección remota no están satisfechos con los datos brutos transmitidos desde los satélites a las estaciones terrestres. La mayoría prefiere los datos preprocesados de los que se han eliminado estos defectos.

CORRECCIÓN GEOMÉTRICA

Se lee en el Capítulo 6 que la escala varía en imágenes aéreas no rectificadas debido al desplazamiento del relieve causado por las variaciones en la elevación del terreno. El desplazamiento en relieve es una fuente de distorsión geométrica en los datos de imágenes digitales, aunque es menos factor en la teledetección satelital que en las imágenes aéreas porque los satélites vuelan a altitudes mucho mayores que los aviones. Otra fuente de distorsiones geométricas es la propia Tierra, cuya curvatura y movimiento giratorio hacia el este son más evidentes desde el espacio que a altitudes más bajas.

La Tierra gira sobre su eje de oeste a este. Al mismo tiempo, los satélites de teledetección como IKONOS, Landsat y los satélites de la NOAA que transportan el sensor AVHRR, orbitan la Tierra de polo a polo. Si tuvieras que trazar en una proyección cilíndrica la trayectoria de vuelo que traza un satélite en órbita polar durante un periodo de 24 horas, verías una serie de ondas en forma de S. A medida que un satélite de teledetección sigue su trayectoria orbital sobre el globo giratorio, cada fila de exploración comienza en una posición ligeramente al oeste de la fila que la precedió. En los datos escaneados sin procesar, sin embargo, el primer píxel de cada fila parece estar alineado con los otros píxeles iniciales. Para georeferenciar correctamente los píxeles en una imagen de detección remota, los píxeles deben desplazarse ligeramente hacia el oeste en cada fila sucesiva. Es por ello que las escenas procesadas tienen la forma de paralelogramos sesgados cuando se trazan en proyecciones geográficas o planas, como se muestra en la ilustración que viste anteriormente que mostraba ocho bandas de una escena Landsat 7 ETM+.

Además del error sistemático causado por la rotación de la Tierra, las distorsiones geométricas aleatorias resultan del desplazamiento del relieve, las variaciones en la altitud y actitud del satélite, los malos comportamientos de los instrumentos y otras anomalías. Los errores geométricos aleatorios se corrigen a través de un proceso conocido como lámina de caucho. Como su nombre lo indica, la lámina de caucho implica estirar y deformar una imagen para georegistrar los puntos de control mostrados en la imagen a ubicaciones conocidas de puntos de control en el suelo. Primero, se deriva un par de ecuaciones de transformación de coordenadas planas analizando las diferencias entre las ubicaciones de los puntos de control en la imagen y en el suelo. Las ecuaciones permiten a los analistas de imágenes generar una cuadrícula ráster rectificada. A continuación, los valores de reflectancia en la cuadrícula escaneada original se asignan a las celdas en la cuadrícula rectificada. Dado que las celdas de la cuadrícula rectificada no se alinean perfectamente con las celdas de la cuadrícula original, los valores de reflectancia en las celdas de la cuadrícula rectificada deben interpolarse a partir de los valores de la cuadrícula original. Este proceso se llama remuestreo. El remuestreo también se utiliza para aumentar o disminuir la resolución espacial de una imagen para que sus píxeles puedan ser georegistrados con los de otra imagen.

CORRECCIÓN RADIOMÉTRICA

La reflectancia a una longitud de onda dada de un objeto medida por un instrumento de teledetección varía en respuesta a varios factores, incluyendo la iluminación del objeto, su reflectividad y la transmisividad de la atmósfera. Además, la respuesta de un sensor dado puede degradarse con el tiempo. Con estos factores en mente, no debería sorprender que un objeto escaneado en diferentes momentos del día o año exhiba diferentes características radiométricas. Tales diferencias pueden ser ventajosas a veces, pero también pueden plantear problemas para los analistas de imagen que desean mosaicos de imágenes contiguas, o detectar cambios significativos en el uso del suelo y la cobertura del suelo a lo largo del tiempo. Para hacer frente a tales problemas, los analistas han desarrollado numerosas técnicas de corrección radiométrica, incluyendo correcciones de distancia Tierra-Sol, correcciones de elevación del sol y correcciones de neblina atmosférica.

Para compensar las diferentes cantidades de iluminación de escenas capturadas en diferentes momentos del día, o en diferentes latitudes o estaciones, los analistas de imagen pueden dividir los valores medidos en una banda por valores en otra banda, o pueden aplicar funciones matemáticas que normalizan los valores de reflectancia. Dichas funciones están determinadas por la distancia entre la Tierra y el Sol y la altitud del sol sobre el horizonte en un lugar determinado, hora del día y época del año. Los analistas dependen de metadatos que incluyen la ubicación, la fecha y la hora en que se capturó una escena en particular.

Los analistas de imagen también pueden corregir los efectos de disminución del contraste de la neblina atmosférica. La compensación de neblina se asemeja a la técnica de corrección diferencial utilizada para mejorar la precisión de los datos GPS en el sentido de que implica medir el error (o, en este caso, reflectancia espuria) en una ubicación conocida, restando entonces ese error de otra medición. Los analistas comienzan midiendo la reflectancia de un objeto conocido por exhibir reflectancia cercana a cero en condiciones no turbias, como agua profunda y clara en la banda del infrarrojo cercano. Cualquier valor de reflectancia en esos píxeles se puede atribuir a la radiancia de trayectoria de la neblina atmosférica. Suponiendo que las condiciones atmosféricas son uniformes en toda la escena, el factor de opacidad puede restarse de todos los valores de reflectancia de píxeles. Algunos sensores nuevos permiten la “autocalibración” midiendo directamente el contenido de agua atmosférica y polvo.

Los servicios de corrección geométrica y radiométrica son comúnmente ofrecidos por agencias gubernamentales y empresas privadas que venden datos de teledetección. Por ejemplo, aunque el USGS ofrece datos Landsat 7 en bruto (Nivel Cero R) por solo $475 por 185 km por 170 km de escena, muchos usuarios encuentran que los $600 corregidos radiométricamente, ortorrectificados y proyectados a medida los datos de Nivel Uno G bien valen la pena el gasto agregado. GeoEye (anteriormente Space Imaging) entrega rutinariamente datos IKONOS preprocesados que han sido corregidos radiométricamente, ortorrectificados, proyectados y mosaicos según las especificaciones del usuario. Cuatro niveles de precisión geométrica están disponibles, desde 12 metros (que cumple con los Estándares Nacionales de Precisión de Mapa a escala 1:50 ,000) hasta 1 metro (1:2 ,400 NMAS).

8.16. Mejora de imagen

Las técnicas de corrección se utilizan rutinariamente para resolver problemas geométricos, radiométricos y otros que se encuentran en datos brutos de detección remota. Otra familia de técnicas de procesamiento de imágenes se utiliza para facilitar la interpretación de los datos de imagen. Estas llamadas técnicas de mejora de imagen incluyen estiramiento de contraste, mejora de bordes y derivación de nuevos datos calculando diferencias, relaciones u otras cantidades a partir de valores de reflectancia en dos o más bandas, entre muchas otras. En esta sección se consideran brevemente dos técnicas comunes de mejora, el estiramiento de contraste y los datos derivados. Más adelante aprenderá cómo se utilizan los índices de vegetación derivados de dos bandas de imágenes AVHRR para monitorear el crecimiento de la vegetación a escala global.

ESTIRAMIENTO EN CONTRASTE

Considera el par de imágenes que se muestran lado a lado a continuación. Si bien ambos fueron producidos a partir de los mismos datos de Landsat MSS, notará que la imagen de la izquierda es considerablemente más tenue que la de la derecha. La diferencia es resultado del estiramiento de contraste. Como usted recuerda, los datos MSS tienen una precisión de 8 bits, es decir, los valores de reflectancia se codifican como 256 (28) niveles de intensidad. Como suele ser el caso, las reflectancias en la banda del infrarrojo cercano de la escena parcialmente mostrada a continuación oscilaron entre solo 30 y 80 en los datos de imagen sin procesar. Este rango limitado da como resultado una imagen que carece de contraste y, en consecuencia, aparece tenue. La imagen de la derecha muestra el efecto de estirar el rango de valores de reflectancia en la banda del infrarrojo cercano de 30-80 a 0-255, y luego estirar de manera similar las bandas visibles verdes y rojas visibles. Como puede ver, la imagen estirada en contraste es más brillante y más clara.

Par de imágenes producidas a partir de datos de Landsat MSS capturados en 1988. La banda del infrarrojo cercano se muestra en rojo, el rojo visible se muestra en verde y la banda verde visible se muestra en azul. Las imágenes derecha e izquierda muestran los efectos antes y después del estiramiento de contraste. Las imágenes muestran patrones agrícolas característicos del riego de pivote central en una porción de un condado en el suroeste de Kansas. (USGS, 2001a).

DATOS DERIVADOS: NDVI

Una ventaja de los datos multiespectrales es la capacidad de derivar nuevos datos calculando diferencias, relaciones u otras cantidades a partir de valores de reflectancia en dos o más bandas de longitud de onda. Por ejemplo, detectar vegetación estresada entre vegetación sana puede ser difícil en cualquier banda, particularmente si las diferencias en la elevación del terreno o la pendiente hacen que algunas partes de una escena se iluminen de manera diferente a otras. Sin embargo, la relación de los valores de reflectancia en la banda roja visible y la banda del infrarrojo cercano compensa las variaciones en la iluminación de la escena. Dado que la relación de los dos valores de reflectancia es considerablemente menor para la vegetación estresada independientemente de las condiciones de iluminación, la detección es más fácil y confiable.

Además de las relaciones simples, los científicos de teledetección han derivado otras fórmulas matemáticas para obtener nuevos datos útiles a partir de imágenes multiespectrales. Uno de los ejemplos más utilizados es el Índice de Vegetación de Diferencia Normalizada (NDVI). Como recordará, el sensor AVHRR mide la radiación electromagnética en cinco bandas de longitudes de onda. Las puntuaciones NDVI se calculan píxel a píxel usando el siguiente algoritmo:

NDVI = (NIR — R)/(NIR + R)

R representa la banda roja visible (AVHRR canal 1), mientras que NIR representa la banda de infrarrojo cercano (AVHRR canal 2). La clorofila en plantas verdes absorbe fuertemente la radiación en la banda roja visible de AVHRR (0.58-0.68 µm) durante la fotosíntesis. En contraste, las estructuras foliares hacen que las plantas reflejen fuertemente la radiación en la banda del infrarrojo cercano (0.725-1.10 µm). Los puntajes NDVI van de -1.0 a 1.0. Un píxel asociado con bajos valores de reflectancia en la banda visible y alta reflectancia en la banda del infrarrojo cercano produciría una puntuación NDVI cercana a 1.0, indicando la presencia de vegetación saludable. Por el contrario, las puntuaciones NDVI de píxeles asociados con alta reflectancia en la banda visible y baja reflectancia en la banda del infrarrojo cercano se aproximan a -1.0, lo que indica nubes, nieve o agua. Las puntuaciones NDVI cercanas a 0 indican suelo rocoso y no vegetado.

Las aplicaciones del NDVI van desde locales hasta globales. A escala local, los Viñedos Mondavi en Napa Valley California pueden dar fe de la utilidad de los datos NDVI en el monitoreo de la salud de las plantas. En el 1993, los viñedos sufrieron una infestación de filoxera, una especie de piojos de plantas que ataca las raíces y es impermeable a los pesticidas. La plaga solo se pudo superar eliminando las vides infestadas y reemplazándolas por un stock de raíces más resistente. El viñedo encargó a una empresa de consultoría que adquiriera imágenes visibles e infrarrojas cercanas de alta resolución (2-3 metros) durante temporadas de crecimiento consecutivas utilizando un sensor aerotransportado. Una vez georegistrados los datos de las dos estaciones, la comparación de las puntuaciones de NDVI reveló áreas en las que la densidad del dosel de la vid había disminuido. La detección de cambios de NDVI demostró ser un enfoque tan fructífero que los viñedos lo adoptaron para su uso rutinario como parte de su estrategia general de cultivo de precisión (Colucci, 1998).

El siguiente ejemplo describe los pasos de procesamiento de imágenes involucrados en la producción de un conjunto global de datos NDVI.

8.17. Procesando el Dataset Global Land de 1Km

Los sensores de Radiómetro Avanzado de Muy Alta Resolución (AVHRR) a bordo de los satélites NOAA exploran diariamente toda la Tierra a longitudes de onda visibles rojas, infrarrojas cercanas e infrarrojas térmicas. A finales de la década de 1980 y principios de la década de 1990, varias agencias internacionales identificaron la necesidad de compilar un conjunto de datos de NDVI globales de referencia, sin nubes, en apoyo de los esfuerzos para monitorear la cobertura vegetal global. Por ejemplo, las Naciones Unidas encomendaron a su Organización para la Agricultura y la Alimentación que realizara un inventario forestal mundial como parte de su proyecto de Evaluación de los Recursos Forestales. Los científicos que participan en el programa del Sistema de Observación de la Tierra de la NASA también necesitaron un conjunto global de datos AVHRR de calidad uniforme para calibrar modelos informáticos destinados a monitorear y predecir el cambio ambiental global. En 1992, bajo contrato con el USGS, y en cooperación con el Programa Internacional de la Biosfera de la Geosfera, comenzaron a trabajar científicos del Centro de Datos EROS en Sioux Falls, Dakota del Sur. Sus objetivos eran crear no solo una sola imagen compuesta de 10 días, sino también una serie temporal de compuestos de 30 meses que ayudaría a los científicos del sistema de la Tierra a comprender los cambios estacionales en la cubierta vegetal a escala global. En este ejemplo se destacan los procedimientos de procesamiento de imágenes utilizados para producir el conjunto de datos. Más información está disponible en Eidenshink & Faundeen (1994) y en la página principal del proyecto.

De 1992 a 1996, una red de 30 estaciones receptoras terrestres adquirió y archivó decenas de miles de escenas de un sensor AVHRR a bordo de uno de los satélites de órbita polar de la NOAA. Las escenas individuales fueron cosidas en pasadas orbitales diarias como las que se ilustran a continuación. La creación de pases orbitales permitió al equipo del proyecto descartar los datos redundantes en escenas superpuestas adquiridas por diferentes estaciones receptoras.

Imágenes en color falsas producidas a partir de datos AVHRR adquiridos el 24 de junio de 1992 para el proyecto 1-Km AVHRR Global Land Dataset. Las imágenes representan pasadas orbitales creadas al empalmar escenas consecutivas. Las franjas de 2400-km de ancho cubren Europa, África y el Cercano Oriente. Tenga en cuenta la nubosidad y la distorsión geométrica. (Eidenshink & Faundeen, 1994).

Una vez que se juntaron las escenas orbitales diarias, el equipo del proyecto se puso a trabajar preparando conjuntos de datos compuestos de 10 días libres de nubes que incluían puntuaciones del Índice de Vegetación de Diferencia Normalizada (NDVI). Los pasos de procesamiento de imágenes involucrados incluyeron calibración radiométrica, corrección atmosférica, cálculo NDVI, corrección geométrica, composición regional y proyección de escenas compuestas. Cada paso se describe brevemente a continuación.

CALIBRACIÓN RADIOMÉTRICA

Calibración radiométrica significa definir la relación entre los valores de reflectancia registrados por un sensor desde el espacio y las radiancias reales medidas con espectrómetros en el suelo. La precisión de los sensores AVHRR de color rojo visible y de IR cercano se degrada con el tiempo. Los analistas de imagen no podrían producir series temporales útiles de conjuntos de datos compuestos a menos que las reflectancias fueran calibradas de manera confiable. El equipo del proyecto se basó en investigaciones que mostraron cómo los datos AVHRR adquiridos en diferentes momentos podrían normalizarse utilizando un factor de corrección derivado mediante el análisis de valores de reflectancia asociados con áreas desérticas homogéneas.

CORRECCIÓN ATMOSFÉRICA

Se sabía que varios fenómenos atmosféricos, incluyendo la dispersión de Rayleigh, el ozono, el vapor de agua y los aerosoles, afectaban a las reflectancias medidas por sensores como AVHRR. La investigación arrojó correcciones para compensar algunos de estos.

Una corrección comprobada fue para la dispersión de Rayleigh. Llamado así por un físico inglés que trabajó a principios del siglo XX, Rayleigh scatter es el fenómeno que explica el hecho de que el cielo aparece azul. Las longitudes de onda cortas de la radiación solar entrante tienden a ser difundidas por partículas diminutas en la atmósfera. Dado que las longitudes de onda azules son las más cortas en la banda visible, tienden a dispersarse más que el verde, el rojo y otros colores de luz. La dispersión de Rayleigh también es la causa principal de la neblina atmosférica.

Debido a que el sensor AVHRR escanea una franja tan amplia, los analistas de imagen no pudieron estar satisfechos con aplicar un factor de compensación de turbidez constante en todas las escenas. Para escanear su franja de 2400 km de ancho, el sensor AVHRR barre un cabezal de escaneo a través de un arco de 110°. En consecuencia, el ángulo de visión entre el cabezal de exploración y la superficie de la Tierra varía de 0° en el medio de la franja a aproximadamente 55° en los bordes. Obviamente, las longitudes de las trayectorias recorridas por la radiación reflejada hacia el sensor varían considerablemente dependiendo del ángulo de visión. Los científicos del proyecto tuvieron que tener esto en cuenta a la hora de compensar la neblina atmosférica. Cuanto más lejos se ubicaba un píxel del centro de una franja, mayor era su longitud de trayectoria y más neblina necesitaba ser compensada. Mientras estaban en ello, los analistas de imagen también tuvieron en cuenta la elevación del terreno, ya que eso también afecta la longitud del camino. Se utilizó ETOPO5, el modelo digital de elevación global más detallado disponible en ese momento, para calcular longitudes de trayectoria ajustadas por elevación. (Aprendió sobre el ETOPO1 más detallado en el Capítulo 7.)

CÁLCULO NDVI

El Índice de Vegetación de Diferencia Normalizada (NDVI) es la diferencia de los valores de reflectancia de IR cercano y rojo visible normalizados sobre la suma de los dos valores. El resultado, calculado por cada píxel en cada pasada orbital diaria, es un valor entre -1.0 y 1.0, donde 1.0 representa la actividad fotosintética máxima, y por lo tanto la densidad y vigor máximos de la vegetación verde.

CORRECCIÓN GEOMÉTRICA Y PROYECCIÓN

Como puede ver en las pasadas orbitales cosidas ilustradas anteriormente, la amplia gama de ángulos de visión producidos por el sensor AVHRR da como resultado una gran distorsión geométrica. El desplazamiento de relieve empeora las cosas, distorsionando aún más las imágenes hacia los bordes de cada franja. El equipo del proyecto realizó tanto ortorrectificación como láminas de caucho para rectificar los datos. El modelo digital global de elevación ETOPO5 se utilizó nuevamente para calcular las correcciones de las distorsiones de escala causadas por el desplazamiento del relieve. Para corregir las distorsiones causadas por la amplia gama de ángulos de visión de los sensores, los analistas identificaron características bien definidas como costas, lagos y ríos en las imágenes que podrían coincidir con ubicaciones conocidas en el suelo. Derivaron ecuaciones de transformación de coordenadas mediante el análisis de las diferencias entre las posiciones de los puntos de control en las imágenes y ubicaciones conocidas en el suelo. Se demostró que la precisión de las ubicaciones de control en las imágenes rectificadas no fue peor que los 1,000 metros de las ubicaciones reales. Igualmente importante, se demostró que el error de georegistro entre pasadas orbitales diarias rectificadas era menor de un píxel.

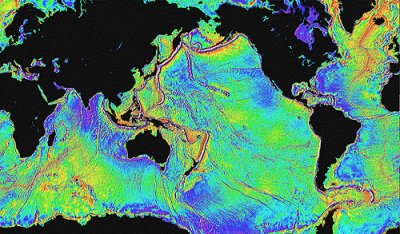

Después de rectificar los pases orbitales diarios, se transformaron en una proyección cartográfica llamada Homolosine de Goode. Se trata de una proyección de igual área que minimiza la distorsión de forma de las masas terrestres interrumpiendo la retícula sobre los océanos. El equipo del proyecto seleccionó la proyección de Goode en parte porque sabían que la equivalencia de área sería una cualidad útil para el análisis espacial. Más importante aún, la proyección interrumpida permitió al equipo procesar el conjunto de datos como doce regiones separadas que podrían ser empalmadas nuevamente más tarde. La siguiente ilustración muestra los pases orbitales del 24 de junio de 1992 proyectados juntos en una sola imagen global basada en la proyección de Goode.

Pases orbitales AVHRR adquiridos el 24 de junio de 1992, proyectados juntos en una proyección mundial de Homolosina de Goode. (Eidenshink & Faundeen, 1994).

COMPOSICIÓN

Una vez que se rectificaron los pases orbitales diarios por un período de diez días, cada píxel cuadrado de un kilómetro podría asociarse con píxeles correspondientes en la misma ubicación en otras pasadas orbitales. En esta etapa, con los pases orbitales ensamblados en doce regiones derivadas de la proyección interrumpida de Goode, los analistas de imagen identificaron el valor NDVI más alto para cada píxel en un periodo dado de diez días. Luego produjeron regiones compuestas de diez días combinando todos los píxeles de valor máximo en un solo conjunto de datos regionales. Este procedimiento minimizó las posibilidades de que los píxeles contaminados por la nube fueran incluidos en el conjunto final de datos compuestos. Finalmente, las regiones compuestas se ensamblaron en un solo conjunto de datos, ilustrado a continuación. Este mismo procedimiento se ha repetido para crear 93 compuestos de diez días del 1 al 10 de abril de 1992 al 21 al 30 de mayo de 1996.

Imagen AVHRR compuesta de diez días. Los píxeles más verdes representan los valores NDVI más altos. (Eidenshink & Faundeen, 1994).

8.18. Clasificación de la imagen

Junto con la vigilancia militar y el pronóstico del tiempo, un uso común de los datos de imágenes de teledetección es monitorear la cobertura del suelo e informar la planificación del uso del suelo. El término cobertura terrestre se refiere a los tipos de vegetación que cubren la superficie de la Tierra, o los tipos de materiales que forman la superficie donde la vegetación está ausente. El uso del suelo, por el contrario, se refiere a los roles funcionales que la tierra juega en las actividades económicas humanas (Campbell, 1983).

Tanto el uso del suelo como la cobertura del suelo se especifican en términos de categorías generalizadas. Por ejemplo, un sistema de clasificación temprana adoptado por una Comisión Mundial de Uso de la Tierra en 1949 constaba de nueve categorías primarias, entre ellas asentamientos y tierras no agrícolas asociadas, horticultura, cultivos arbóreos y otros cultivos perennes, tierras de cultivo, pastos permanentes mejorados, tierras de pastoreo no mejoradas, bosques, pantanos y marismas, y tierras improductivas. Antes de la era del procesamiento digital de imágenes, personal especialmente capacitado dibujó mapas de uso del suelo interpretando visualmente la forma, el tamaño, el patrón, el tono, la textura y las sombras proyectadas por las características mostradas en las fotografías aéreas. Como se puede imaginar, este fue un proceso costoso y lento. No es de extrañar entonces que la Comisión nombrada en 1949 fracasara en su intento de producir un detallado mapa global de uso de la tierra.

Parte del atractivo del procesamiento digital de imágenes es el potencial para automatizar el uso del suelo y la cartografía de la cobertura del suelo. Para realizar este potencial, los analistas de imagen han desarrollado una familia de técnicas de clasificación de imágenes que clasifican automáticamente píxeles con valores similares de reflectancia multiespectral en clústeres que, idealmente, corresponden a categorías funcionales de uso del suelo y cobertura del suelo. Se han desarrollado dos tipos generales de técnicas de clasificación de imágenes: técnicas supervisadas y no supervisadas.

CLASIFICACIÓN SUPERVISADA

Los analistas de imagen humana desempeñan un papel crucial en los procedimientos de clasificación de imágenes supervisados y no supervisados. En la clasificación supervisada, el papel del analista es especificar de antemano los valores de reflectancia multiespectral o (en el caso de la banda térmica infrarroja) de emisión típicos de cada clase de uso del suelo o cobertura del suelo.

Porción de la escena Landsat TM adquirida el 17 de julio de 1986 mostrando campos agrícolas en el condado de Tippecanoe, Indiana. Las reflectancias registradas en las bandas TM 2 (verde visible), 3 (rojo visible) y 4 (infrarrojo cercano) se muestran en azul, verde y rojo respectivamente. Software de procesamiento de imágenes multispec © 2001 Purdue Research Foundation, Inc.

Por ejemplo, para realizar una clasificación supervisada de los datos de Landsat Thematic Mapper (TM) mostrados anteriormente en dos categorías de cobertura del suelo, Vegetación y Otro, primero delinearía varios campos de capacitación que son representativos de cada clase de cobertura del suelo. La siguiente ilustración muestra dos campos de entrenamiento para cada clase, sin embargo, para lograr la clasificación más confiable posible, definirías hasta 100 o más campos de entrenamiento por clase.

Campos de capacitación definidos para dos clases de cobertura terrestre, vegetación y otras. Software de procesamiento de imágenes multispec © 2001 Purdue Research Foundation, Inc.

Los campos de entrenamiento definidos consisten en clústeres de píxeles con valores similares de reflectancia o emisividad. Si hiciste un buen trabajo supervisando la etapa de capacitación de la clasificación, cada cluster representaría el rango de características espectrales exhibidas por su correspondiente clase de cobertura terrestre. Una vez definidos los clústeres, aplicaría un algoritmo de clasificación para ordenar los píxeles restantes de la escena en la clase con las características espectrales más similares. Uno de los algoritmos más utilizados calcula la probabilidad estadística de que cada píxel pertenezca a cada clase. Los píxeles se asignan entonces a la clase asociada con la probabilidad más alta. Los algoritmos de este tipo se conocen como clasificadores de máxima verosimilitud. El resultado es una imagen como la que se muestra a continuación, en la que cada píxel ha sido asignado a una de las dos clases de cobertura terrestre.

Mapa de cobertura terrestre de dos clases producido por clasificación supervisada de datos Landsat TM. Software de procesamiento de imágenes multispec © 2001 Purdue Research Foundation, Inc.

CLASIFICACIÓN NO SUPERVISADA