2.1: Introducción

- Page ID

- 123188

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\( \newcommand{\id}{\mathrm{id}}\) \( \newcommand{\Span}{\mathrm{span}}\)

( \newcommand{\kernel}{\mathrm{null}\,}\) \( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\) \( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\) \( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\id}{\mathrm{id}}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\kernel}{\mathrm{null}\,}\)

\( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\)

\( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\)

\( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\) \( \newcommand{\AA}{\unicode[.8,0]{x212B}}\)

\( \newcommand{\vectorA}[1]{\vec{#1}} % arrow\)

\( \newcommand{\vectorAt}[1]{\vec{\text{#1}}} % arrow\)

\( \newcommand{\vectorB}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vectorC}[1]{\textbf{#1}} \)

\( \newcommand{\vectorD}[1]{\overrightarrow{#1}} \)

\( \newcommand{\vectorDt}[1]{\overrightarrow{\text{#1}}} \)

\( \newcommand{\vectE}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash{\mathbf {#1}}}} \)

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

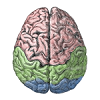

Una de las principales razones por las que el cerebro puede ser tan plástico y aprender a hacer tantas cosas diferentes, es que se compone de una forma altamente esculpible de masilla tonta: miles de millones de neuronas individuales que están densamente interconectadas entre sí, y capaces de dar forma a lo que hacen cambiando estos patrones de interconexiones. El cerebro es como un conjunto masivo de LEGO, donde cada una de las piezas individuales es bastante simple (como una sola pieza LEGO), y todo el poder proviene de las formas casi infinitas en que estas simples piezas pueden recombinarse para hacer cosas diferentes.

Entonces la buena noticia para ti el estudiante es, la neurona es fundamentalmente simple. Mucha gente intentará decirte lo contrario, pero como verás a medida que avanzas a través de este libro, las neuronas simples pueden dar cuenta de gran parte de lo que sabemos sobre cómo funciona el cerebro. Entonces, a pesar de que tienen muchas partes móviles y puedes pasar toda una carrera aprendiendo incluso sobre una pequeña parte de una neurona, creemos firmemente que toda esta complejidad está al servicio de una función general muy simple.

¿Cuál es esa función? Fundamentalmente, se trata de detección. Las neuronas reciben miles de señales de entrada diferentes de otras neuronas, buscando patrones específicos que sean “significativos” para ellas. Una analogía muy simple es con un detector de humo, que toma muestras del aire y busca rastros de humo delatores. Cuando estos exceden un límite de umbral especificado, la alarma se apaga. De igual manera, la neurona tiene un umbral y solo envía una señal de “alarma” a otras neuronas cuando detecta algo lo suficientemente significativo como para cruzar este umbral. La alarma se denomina potencial de acción o pico y es la unidad fundamental de comunicación entre neuronas.

Nuestro objetivo en este capítulo es entender cómo la neurona recibe señales de entrada de otras neuronas, las integra en una intensidad de señal general que se compara con el umbral, y comunica el resultado a otras neuronas. Veremos cómo estos procesos se pueden caracterizar matemáticamente en simulaciones por computadora (resumidas en la Figura 2.1). En el resto del libro, veremos cómo esta sencilla función general de la neurona nos permite en última instancia percibir el mundo, pensar, comunicar y recordar.

Advertencia matemática: Este capítulo y el Capítulo de Mecanismos de Aprendizaje son los dos únicos en todo el libro con cantidades significativas de matemáticas (porque estos dos capítulos describen en detalle las ecuaciones para nuestras simulaciones). Hemos separado lo conceptual del contenido matemático, y aquellos con aversión a las matemáticas pueden arreglárselas sin entender todos los detalles. Entonces, ¡no se desplace ni se sienta abrumado por las matemáticas aquí!