7.2: Diagramas de probabilidad

- Page ID

- 82343

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\( \newcommand{\dsum}{\displaystyle\sum\limits} \)

\( \newcommand{\dint}{\displaystyle\int\limits} \)

\( \newcommand{\dlim}{\displaystyle\lim\limits} \)

\( \newcommand{\id}{\mathrm{id}}\) \( \newcommand{\Span}{\mathrm{span}}\)

( \newcommand{\kernel}{\mathrm{null}\,}\) \( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\) \( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\) \( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\id}{\mathrm{id}}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\kernel}{\mathrm{null}\,}\)

\( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\)

\( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\)

\( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\) \( \newcommand{\AA}{\unicode[.8,0]{x212B}}\)

\( \newcommand{\vectorA}[1]{\vec{#1}} % arrow\)

\( \newcommand{\vectorAt}[1]{\vec{\text{#1}}} % arrow\)

\( \newcommand{\vectorB}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vectorC}[1]{\textbf{#1}} \)

\( \newcommand{\vectorD}[1]{\overrightarrow{#1}} \)

\( \newcommand{\vectorDt}[1]{\overrightarrow{\text{#1}}} \)

\( \newcommand{\vectE}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash{\mathbf {#1}}}} \)

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\(\newcommand{\longvect}{\overrightarrow}\)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

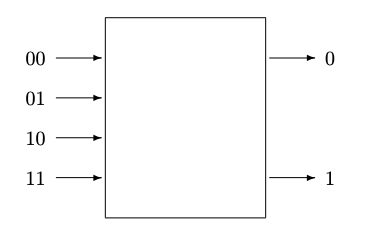

\(\newcommand{\avec}{\mathbf a}\) \(\newcommand{\bvec}{\mathbf b}\) \(\newcommand{\cvec}{\mathbf c}\) \(\newcommand{\dvec}{\mathbf d}\) \(\newcommand{\dtil}{\widetilde{\mathbf d}}\) \(\newcommand{\evec}{\mathbf e}\) \(\newcommand{\fvec}{\mathbf f}\) \(\newcommand{\nvec}{\mathbf n}\) \(\newcommand{\pvec}{\mathbf p}\) \(\newcommand{\qvec}{\mathbf q}\) \(\newcommand{\svec}{\mathbf s}\) \(\newcommand{\tvec}{\mathbf t}\) \(\newcommand{\uvec}{\mathbf u}\) \(\newcommand{\vvec}{\mathbf v}\) \(\newcommand{\wvec}{\mathbf w}\) \(\newcommand{\xvec}{\mathbf x}\) \(\newcommand{\yvec}{\mathbf y}\) \(\newcommand{\zvec}{\mathbf z}\) \(\newcommand{\rvec}{\mathbf r}\) \(\newcommand{\mvec}{\mathbf m}\) \(\newcommand{\zerovec}{\mathbf 0}\) \(\newcommand{\onevec}{\mathbf 1}\) \(\newcommand{\real}{\mathbb R}\) \(\newcommand{\twovec}[2]{\left[\begin{array}{r}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\ctwovec}[2]{\left[\begin{array}{c}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\threevec}[3]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\cthreevec}[3]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\fourvec}[4]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\cfourvec}[4]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\fivevec}[5]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\cfivevec}[5]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\mattwo}[4]{\left[\begin{array}{rr}#1 \amp #2 \\ #3 \amp #4 \\ \end{array}\right]}\) \(\newcommand{\laspan}[1]{\text{Span}\{#1\}}\) \(\newcommand{\bcal}{\cal B}\) \(\newcommand{\ccal}{\cal C}\) \(\newcommand{\scal}{\cal S}\) \(\newcommand{\wcal}{\cal W}\) \(\newcommand{\ecal}{\cal E}\) \(\newcommand{\coords}[2]{\left\{#1\right\}_{#2}}\) \(\newcommand{\gray}[1]{\color{gray}{#1}}\) \(\newcommand{\lgray}[1]{\color{lightgray}{#1}}\) \(\newcommand{\rank}{\operatorname{rank}}\) \(\newcommand{\row}{\text{Row}}\) \(\newcommand{\col}{\text{Col}}\) \(\renewcommand{\row}{\text{Row}}\) \(\newcommand{\nul}{\text{Nul}}\) \(\newcommand{\var}{\text{Var}}\) \(\newcommand{\corr}{\text{corr}}\) \(\newcommand{\len}[1]{\left|#1\right|}\) \(\newcommand{\bbar}{\overline{\bvec}}\) \(\newcommand{\bhat}{\widehat{\bvec}}\) \(\newcommand{\bperp}{\bvec^\perp}\) \(\newcommand{\xhat}{\widehat{\xvec}}\) \(\newcommand{\vhat}{\widehat{\vvec}}\) \(\newcommand{\uhat}{\widehat{\uvec}}\) \(\newcommand{\what}{\widehat{\wvec}}\) \(\newcommand{\Sighat}{\widehat{\Sigma}}\) \(\newcommand{\lt}{<}\) \(\newcommand{\gt}{>}\) \(\newcommand{\amp}{&}\) \(\definecolor{fillinmathshade}{gray}{0.9}\)El modelo de probabilidad de un proceso con\(n\) entradas y\(m\) salidas, donde\(n\) y\(m\) son enteros, se muestra en la Figura 7.5. Los estados\(n\) de entrada son mutuamente excluyentes, al igual que los estados\(m\) de salida. Si este proceso es implementado por puertas lógicas, la entrada necesitaría al menos\(\log_2(n)\) pero no tantos como\(n\) cables.

Este modelo de procesos es conceptualmente simple y general. Funciona bien para procesos con un pequeño número de bits. Se utilizó para el canal binario en el Capítulo 6.

Desafortunadamente, el modelo de probabilidad es incómodo cuando el número de bits de entrada es moderado o grande. La razón es que las entradas y salidas se representan en términos de conjuntos de eventos mutuamente excluyentes. Si los eventos describen señales en, digamos, cinco cables, cada uno de los cuales puede llevar un voltaje alto o bajo que significa un booleano 1 o 0, habría 32 eventos posibles. Es mucho más fácil dibujar una puerta lógica, con cinco entradas que representan variables físicas, que un proceso de probabilidad con 32 estados de entrada. Esta “explosión exponencial” del número de posibles estados de entrada se vuelve aún más severa cuando el proceso representa la evolución del estado de un sistema físico con un gran número de átomos. Por ejemplo, el número de moléculas en un mol de gas es el número de Avogadro\(N_A = 6.02 × 10^{23}\). Si cada átomo tuviera solo una variable booleana asociada, habría 2\(^{N_A}\) estados, mucho mayor que el número de partículas en el universo. Y no habría tiempo para siquiera enumerar todas las partículas, mucho menos hacer algún cálculo: el número de microsegundos ya que el big bang es menor a 5 × 10\(^{23}\). A pesar de esta limitación, el modelo de diagrama de probabilidad es útil conceptualmente.

Revisemos las ideas fundamentales en las comunicaciones, introducidas en el Capítulo 6, en el contexto de tales diagramas.

Suponemos que cada posible estado de entrada de un proceso puede conducir a uno o más estados de salida. Para cada

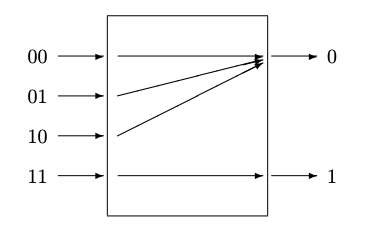

entrada\(i\) denotan la probabilidad de que esta entrada conduzca a la salida\(j\) como\(c_{ji}\). Estas probabilidades de transición se\(c_{ji}\) pueden considerar como una tabla, o matriz, con tantas columnas como estados de entrada haya, y tantas filas como estados de salida. Utilizaremos\(i\) como índice sobre los estados de entrada y\(j\) sobre los estados de salida, y denotaremos el evento asociado con la selección de entrada\(i\) como\(A_i\) y el evento asociado con la salida\(j\) como\(B_j\).

Las probabilidades de transición son propiedades del proceso, y no dependen de las entradas al proceso. Las probabilidades de transición se encuentran entre 0 y 1, y para cada uno\(i\) su suma sobre el índice de salida\(j\) es 1, ya que para cada posible evento de entrada ocurre exactamente un evento de salida. Si el número de estados de entrada es el mismo que el número de estados de salida entonces\(c_{ji}\) es una matriz cuadrada; de lo contrario, tiene más columnas que filas o viceversa.

\(0 \leq c_{ji} \leq 1 \tag{7.1}\)

\(1 = \displaystyle \sum_{j} c_{ji} \tag{7.2}\)

Esta descripción tiene gran generalidad. Se aplica a un proceso determinista (aunque puede no ser el más conveniente, una tabla de verdad que da la salida para cada una de las entradas suele ser más sencilla de pensar). Para tal proceso, cada columna de la\(c_{ji}\) matriz contiene un elemento que es 1 y todos los demás elementos son 0. También se aplica a un canal no determinista (es decir, uno con ruido). Se aplica al codificador y decodificador fuente, al compresor y expansor, y al codificador y decodificador de canal. Se aplica a puertas lógicas y a dispositivos que realizan cálculos arbitrarios sin memoria (a veces llamada “lógica combinacional” en distinción de “lógica secuencial” que puede involucrar estados anteriores). Incluso se aplica a las transiciones tomadas por un sistema físico de uno de sus estados al siguiente. Se aplica si el número de estados de salida es mayor que el número de estados de entrada (por ejemplo, codificadores de canal) o menor (por ejemplo, decodificadores de canal).

Si una entrada de proceso está determinada por eventos aleatorios\(A_i\) con distribución de probabilidad\(p(A_i)\), entonces se pueden calcular las otras probabilidades. Las probabilidades de salida condicionales, condicionadas a la entrada, son

\(p(B_j \; |\; A_i) = c_{ji} \tag{7.3}\)

La probabilidad incondicional de cada salida\(p(B_j)\) es

\(p(B_j = \displaystyle \sum_{i} c_{ji}p(A_i) \tag{7.4}\)

Finalmente, la probabilidad conjunta de cada entrada con cada salida\(p(A_i, B_j)\) y las probabilidades condicionales hacia atrás se\(p(A_i \;|\; B_j)\) pueden encontrar usando el Teorema de Bayes:

\[\begin{align*} p(A_i, B_j) & = p(B_j)p(A_i \;|\; B_j) \tag{7.5} \\ & = p(A_i)p(B_j \;|\; A_i) \tag{7.6} \\ & = p(A_i)c_{ji} \tag{7.7} \end{align*} \]