4.4: Procesos de Renovación-Recompensa y Promedios de Tiempo

( \newcommand{\kernel}{\mathrm{null}\,}\)

Hay muchas situaciones en las que, junto con un proceso de conteo de renovación{N(t);t>0}, hay otra función del tiempo que varía aleatoriamente, llamada función de recompensa{R(t);t>0}. R(t)modela una tasa a la que el proceso está acumulando una recompensa. Ilustraremos muchos ejemplos de tales procesos y veremos que una “recompensa” también podría ser un costo o cualquier cantidad de interés que varíe aleatoriamente. La restricción importante sobre estas funciones de recompensa es queR(t) en un determinadot depende únicamente de la ubicación det dentro del intervalo inter-renovación que contienet y quizás otras variables aleatorias locales a ese intervalo. Antes de definir esto precisamente, comenzamos con varios ejemplos.

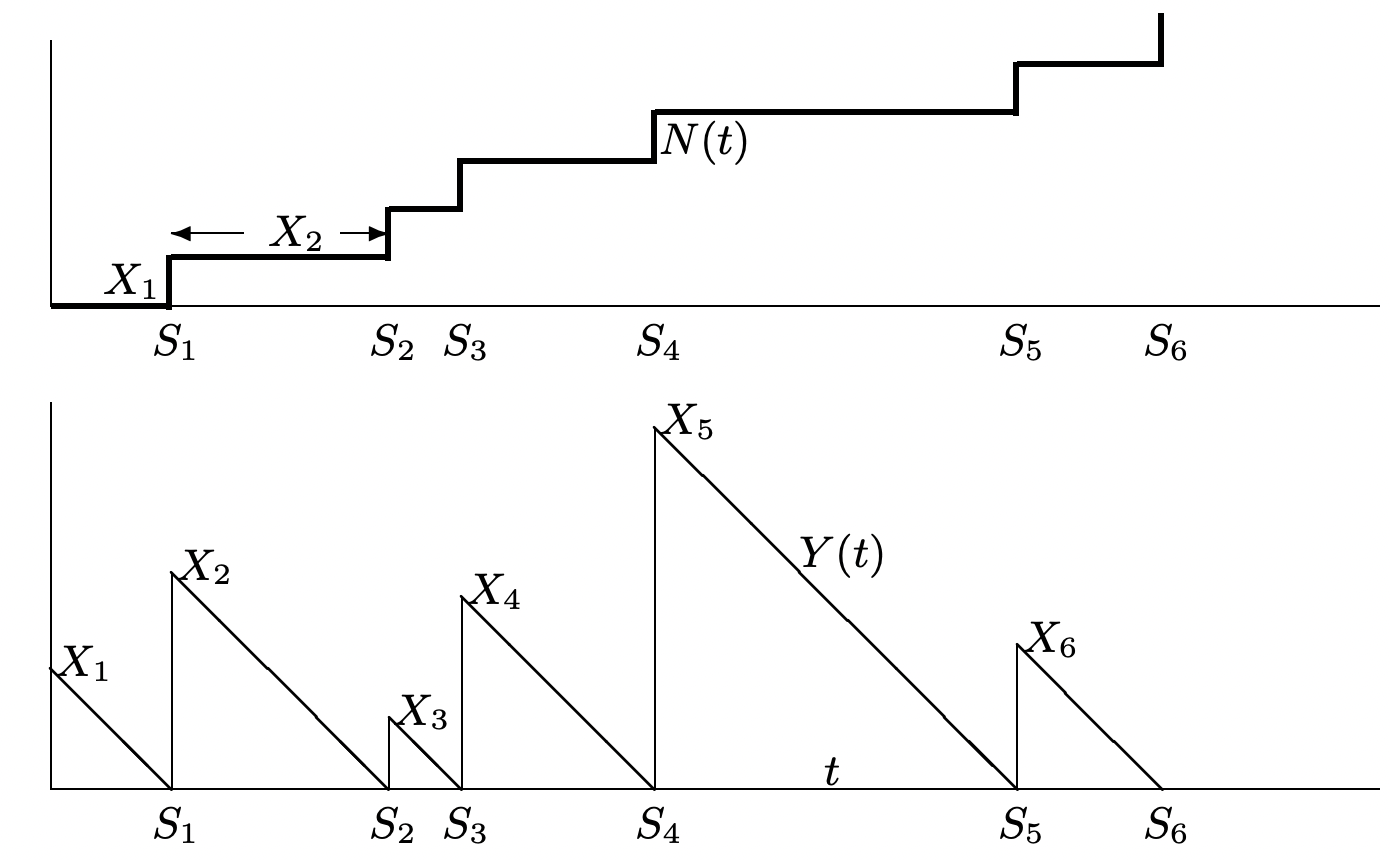

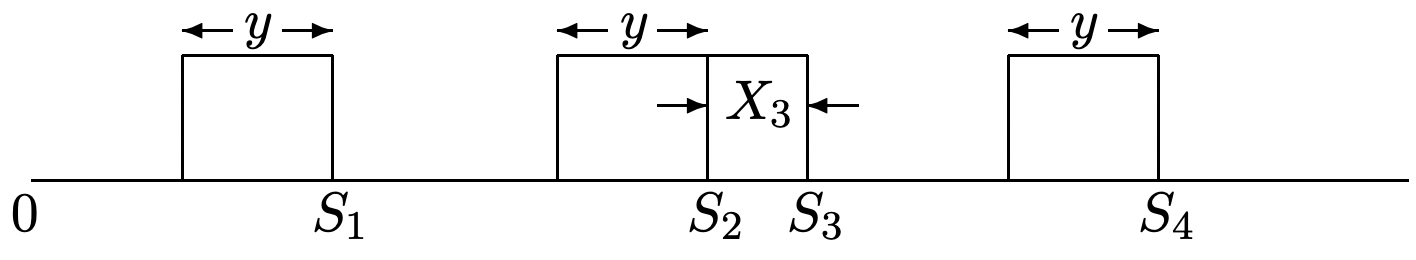

Para un proceso de conteo de renovación{N(t),t>0}, dejaY(t) ser la vida residual en el momentot. La vida residual se define como el intervalo desdet hasta la siguiente época de renovación, es decir, comoSN(t)+1−t. Por ejemplo, si llegamos a una parada de autobús a la horat y los autobuses llegan de acuerdo a un proceso de renovación,Y(t) es el tiempo que tenemos que esperar a que llegue un autobús (ver Figura 4.5). Interpretamos{Y(t);t≥0} como una función de recompensa. El promedio de tiempo deY(t), a lo largo del intervalo(0,t], viene dado por 5(1/t)∫t0Y(τ)dτ. Nos interesa el límite de esta media comot→∞ (asumiendo que existe en algún sentido). La Figura 4.5 ilustra una función de muestra de un proceso de recuento de renovación{N(t);t>0} y muestra la vida residualY(t) para esa función de muestra. Tenga en cuenta que, para una función de muestra dada{Y(t)=y(t)}, la integral∫t0y(τ)dτ es simplemente una suma de triángulos rectos isósceles, con parte de un triángulo final al final. Por lo tanto, se puede expresar como

∫t0y(τ)dτ=12∑n(t)i=1x2i+∫tτ=sn(t)y(τ)dτ

donde{xi;0<i<∞} es el conjunto de valores de muestra para los intervalos entre renovaciones.

Dado que esta relación se mantiene para cada punto de muestra, vemos que la variable aleatoria se∫t0Y(τ)dτ puede expresar en términos de las variables aleatorias entre renovacionesXn como

∫tτ=0Y(τ)dτ=12∑N(t)n=1X2n+∫tτ=SN(t)Y(τ)dτ

Si bien el término final anterior puede evaluarse fácilmente para un determinadoSN(t)(t), es más conveniente utilizar el siguiente encuadernado:

12tN(t)∑n=1X2n≤1t∫tτ=0Y(τ)dτ≤12tN(t)+1∑n=1X2n

El término de la izquierda ahora se puede evaluar en el límitet→∞ (para todas las funciones de muestra excepto un conjunto de probabilidad cero) de la siguiente manera:

limt→∞∑N(t)n=1X2n2t=limt→∞∑N(t)n=1X2nN(t)N(t)2t

Considere cada término en el lado derecho de\ ref {4.12} por separado. Para el primer término, recordemos quelimt→0N(t)=∞ con probabilidad 1. Así comot→∞,∑N(t)n=1X2n/N(t) pasa por el mismo conjunto de valores que∑kn=1X2n/k ask→∞. Así, utilizando el SLLN,

limt→∞∑N(t)n=1X2nN(t)=limk→∞∑kn=1X2nk=E[X2]WP1,

El segundo término en el lado derecho de\ ref {4.12} es simplementeN(t)/2t. Por la fuerte ley para procesos de renovación,limt→∞N(t)/2t=1/(2E[X]) WP1. Así existen ambos límites WP1 y

limt→∞∑N(t)n=1X2n2t=E[X2]2E[X]WP1

El término derecho de\ ref {4.11} se maneja casi de la misma manera:

limt→∞∑N(t)+1n=1X2n2t=limt→∞∑N(t)+1n=1X2nN(t)+1N(t)+1N(t)N(t)2t=E[X2]2E[X]

Combinando estos dos resultados, vemos que, con probabilidad 1, la vida residual promedio en el tiempo viene dada por

limt→∞∫tτ=0Y(τ)dτt=E[X2]2E[X]

Tenga en cuenta que este promedio de tiempo depende del segundo momento deX; esto esˉX2+σ2≥ˉX2, por lo que la vida residual promedio en el tiempo es al menos la mitad del intervalo esperado entre renovaciones (lo cual no es sorprendente). Por otro lado, el segundo momento deX puede ser arbitrariamente grande (incluso infinito) para cualquier valor dado deE[X], de manera que la vida residual promedio en el tiempo puede ser arbitrariamente grande en relación conE[X]. Esto se puede explicar intuitivamente observando que los intervalos interrenovaciones grandes se ponderan más fuertemente en este promedio de tiempo que los intervalos pequeños entre renovaciones.

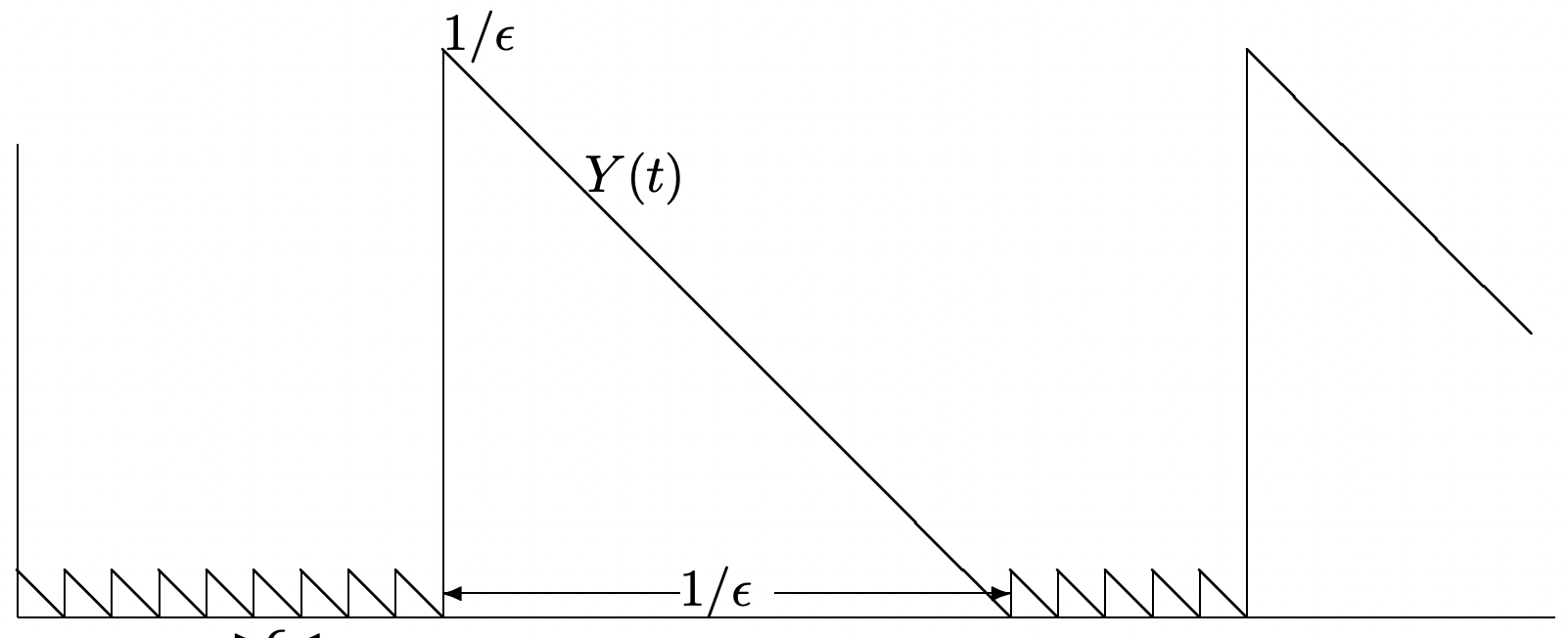

Como ejemplo del efecto de intervalos interrenovatorios improbables pero grandes, vamosX a tomar el valorϵ con probabilidad1−ϵ y valor1/ϵ con probabilidadϵ. Entonces, para pequeñosϵ,E[X]∼1,E[X2]∼1/ϵ, y el tiempo promedio de vida residual es aproximadamente1/(2ϵ) (ver Figura 4.6).

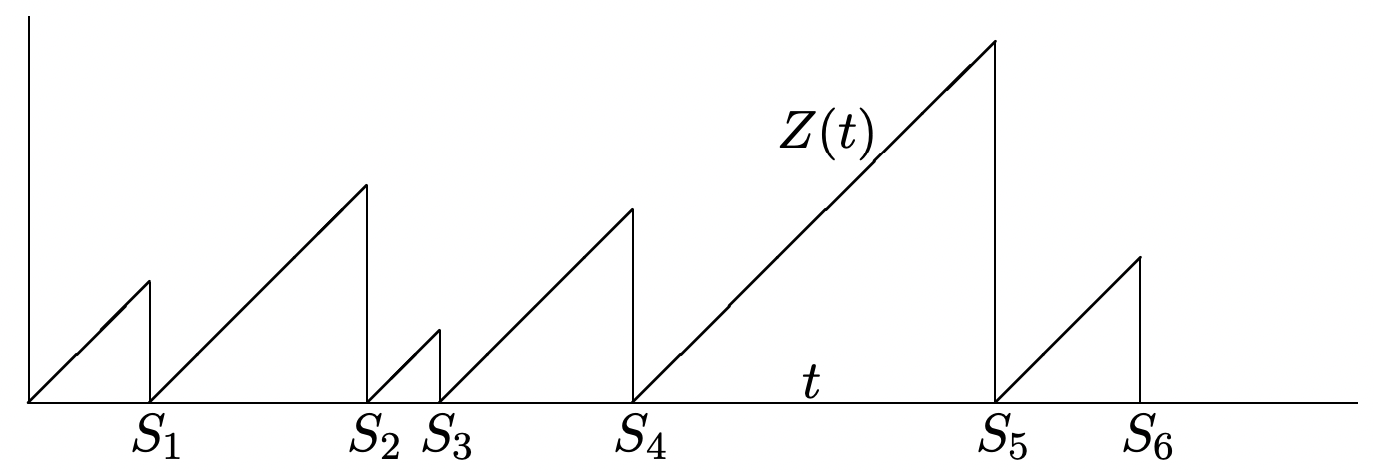

DejarZ(t) ser la edad de un proceso de renovación en el momento ent que la edad se define como el intervalo desde la llegada más reciente antes (o en)t hastat, es decir,Z(t)=t−SN(t). Por convención, si no se han producido llegadas por tiempot, tomamos la edad para sert (es decir, en este caso,N(t)=0 y tomamosS0 para ser 0).

Como se ve en la Figura 4.16, el proceso de edad, para una función de muestra dada del proceso de renovación, es casi el mismo que el proceso de vida residual: los triángulos rectos isósceles simplemente se dan la vuelta. Así, se puede utilizar el mismo análisis que antes para demostrar que el promedio de tiempo deZ(t) es el mismo que el promedio de tiempo de la vida residual,

limt→∞∫tτ=0Z(τ)dτt=E[X2]2E[X]WP1

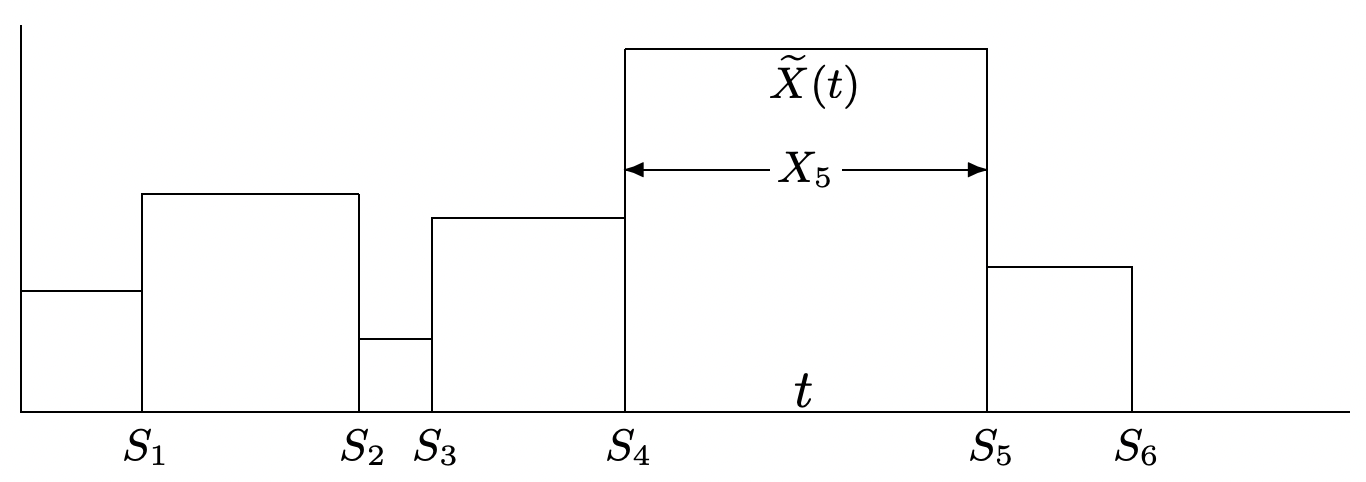

˜X(t)Sea la duración del intervalo entre renovaciones que contiene el tiempot, es decir,˜X(t)=XN(t)+1=SN(t)+1−SN(t) (ver Figura 4.8). Es claro que˜X(t)=Z(t)+Y(t), y así el promedio de tiempo de la duración viene dado por

limt→∞∫tτ=0˜X(τ)dτt=E[X2]E[X]WP1

Nuevamente, los intervalos largos están fuertemente ponderados en este promedio, de manera que la duración promedio de tiempo es al menos tan grande como el intervalo medio entre renovaciones y a menudo mucho más grande.

Procesos generales de renovación-recompensa

En cada uno de estos ejemplos, y en muchas otras situaciones, tenemos una función aleatoria del tiempo (es decir,,Y(t)Z(t), o˜X(t)) cuyo valor en el tiempot depende únicamente de dóndet se encuentre en el intervalo interrenovador actual (es decir, de la edadZ(t) y la duración˜X(t) del intervalo entre renovaciones actuales). Ahora investigamos la clase general de funciones de recompensa para las cuales la recompensa en el momentot depende como máximo de la edad y la duración ent, es decir, la recompensaR(t) en el momentot se da explícitamente como una función 6R(Z(t),˜X(t)) de la edad y duración ent.

Para los tres ejemplos anteriores, la funciónR es trivial. Es decir, la vida residual,Y(t), viene dada por˜X(t)−Z(t) y la edad y duración se dan directamente.

Ahora encontramos el valor promedio de tiempo deR(t), es decir,limt→∞1t∫t0R(τ)dτ. Al igual que en los ejemplos t 0 4.4.1 a 4.4.4 anteriores, primero queremos ver la recompensa acumulada en cada periodo inter-renovación por separado. DefinirRn como la recompensa acumulada en el enésimo intervalo de renovación,

Rn=∫SnSn−1R(τ)d(τ)=∫SnSn−1R[Z(τ),˜X(τ)]dτ

Para la vida residual (ver Ejemplo 4.4.1),Rn es el área del enésimo triángulo rectángulo isósceles en la Figura 4.5. En general, ya queZ(τ)=τ−Sn−1,

Rn=∫SnSn−1R(τ−Sn−1,Xn)dτ=∫Xnz=0R(z,Xn)dz

Tenga en cuenta queRn es una función solamente deXn, donde la forma de la función está determinada porR(Z,X). A partir de esto, queda claro que{Rn;n≥1} es esencialmente 7 un conjunto de variables aleatorias IID. Para la vida residual,R(z,Xn)=Xn−z, por lo que la integral en\ ref {4.19} esX2n/2, según se calculó por inspección antes. En general, a partir de (4.19), el valor esperado deRn viene dado por

E[Rn]=∫∞x=0∫xz=0R(z,x)dz d FX(x)

Al∫t0R(τ)dτ irrumpir en la recompensa durante los sucesivos períodos de renovación, obtenemos

\ [\ begin {alineado}

\ int_ {0} ^ {t} R (\ tau) d\ tau &=\ int_ {0} ^ {S_ {1}} R (\ tau) d\ tau+\ int_ {S_ {1}} ^ {S_ {2}} R (\ tau) d\ tau+\ cdots+\ int_ {S_ {N (t) -1}} ^ {S_ {N (t)}} R (\ tau) d\ tau+\ int_ {S_ {N (t)}} ^ {t} R (\ tau) d\ tau\

&=\ sum_ {n=1} ^ {N (t)}\ mathrm {R} _ _ {n} +\ int_ {S_ {N (t)}} ^ {t} (\ tau) d\ tau

\ end {alineado}\ etiqueta {4.21}\]

El siguiente teorema ahora generaliza los resultados de los Ejemplos 4.4.1, 4.4.3 y 4.4.4 a las funciones generales de renovación-recompensa.

Dejar{R(t);t>0}≥0 ser una función de renovación-recompensa no negativa para un proceso de renovación con tiempo esperado entre renovacionesE[X]=ˉX<∞. SiE[Rn]<∞, entonces con probabilidad 1

limt→∞1t∫tτ=0R(τ)dτ=E[Rn]ˉX

- Prueba

-

Usando (4.21), la recompensa acumulada hasta el tiempo set puede limitar entre la recompensa acumulada hasta la renovación anteriort y aquella hasta la siguiente renovación posteriort,

∑N(t)n=1Rnt≤∫tτ=0R(τ)dτt≤∑N(t)+1n=1Rnt

El lado izquierdo de\ ref {4.23} ahora se puede romper en

∑N(t)n=1Rnt=∑N(t)n=1RnN(t)N(t)t

Cada unoRn es una función dada deXn, por lo que losRn son IID. Comot→∞,N(t)→∞, y, así, como hemos visto antes, la fuerte ley de los números grandes se puede utilizar en el primer término del lado derecho de (4.24), obteniendoE[Rn] con probabilidad 1. También el segundo término se acerca1/ˉX por la ley fuerte para los procesos de renovación. Dado que0<ˉX<∞ yE[Rn] es finito, el producto de los dos términos se acerca al límiteE[Rn]/ˉX. La desigualdad de la mano derecha de\ ref {4.23} se maneja casi de la misma manera,

∑N(t)+1n=1Rnt=∑N(t)+1n=1RnN(t)+1N(t)+1N(t)N(t)t

Se ve que los términos del lado derecho de\ ref {4.25} se acercan a los límites como antes y así el término de la izquierda se acercaE[Rn]/ˉX con probabilidad 1. Dado que el límite superior e inferior en\ ref {4.23} se acercan al mismo límite,(1/t)∫t0R(τ)dτ se acerca al mismo límite y se prueba el teorema.

La restricción a las funciones de renovación-recompensa no negativas en el Teorema 4.4.1 es ligeramente artificial. El mismo resultado se aplica para las funciones de recompensa no positivas simplemente cambiando las direcciones de las desigualdades en (4.23). Suponiendo que esoE[Rn] existe (es decir, que tanto sus partes positivas como negativas son finitas), el mismo resultado se aplica en general dividiendo una función de recompensa arbitraria en una parte positiva y negativa. Esto nos da el corolario:

Let{R(t);t>0} Ser una función de renovación-recompensa para un proceso de renovación con tiempo esperado entre renovacionesE[X]=ˉX<∞. SiE[Rn] existe, entonces con probabilidad 1

limt→∞1t∫tτ=0R(τ)dτ=E[Rn]ˉX

El Ejemplo 4.4.1 trató el valor promedio de tiempo de la vida residualY(t). Supongamos, sin embargo, que nos gustaría encontrar la función de distribución de tiempo promedio deY(t), es decir, la fracción de tiempoY(t)≤y que en función dey. El enfoque, que se aplica a una amplia variedad de aplicaciones, es utilizar una función de indicador (para un valor dado dey) como función de recompensa. Es decir, definirR(t) tener el valor 1 para todost tales queY(t)≤y y tener el valor 0 en caso contrario. La Figura 4.9 ilustra esta función para una ruta de muestra dada. Expresando esta función de recompensa en términos deZ(t) y˜X(t), tenemos

R(t)=R(Z(t),˜X(t))={1;˜X(t)−Z(t)≤y0; otherwise

Tenga en cuenta que si un intervalo entre renovaciones es menor quey (como el tercer intervalo en la Figura 4.9), entoncesR(t) tiene el valor uno sobre todo el intervalo, mientras que si el intervalo es mayor

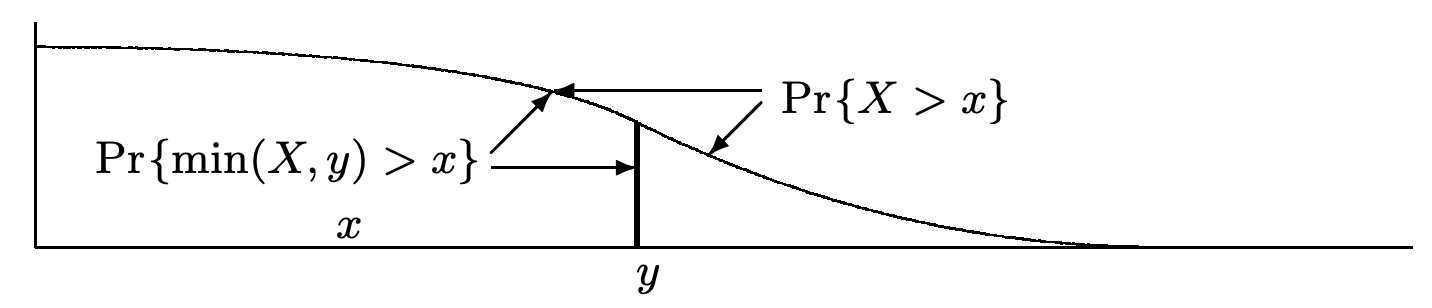

quey, entoncesR(t) tiene el valor uno solo sobre lasy unidades finales del intervalo. AsíRn=min[y,Xn]. Tenga en cuenta que la variable aleatoriamin[y,Xn] es igual aXn forXn≤y, y por lo tanto tiene la misma función de distribución queXn en el rango 0 ay. La Figura 4.10 ilustra esto en términos de la función de distribución complementaria. De la figura, vemos que

E[Rn]=E[min(X,y)]=∫∞x=0Pr{min(X,y)>x}dx=∫yx=0Pr{X>x}dx

DejarFY(y)=limt→∞(1/t)∫t0R(τ)dτ denotar la fracción de tiempo promedio de tiempo que la vida residual es menor o igual ay. Del Teorema 4.4.1 y la Eq. (4.27), tenemos entonces

FY(y)=E[Rn]ˉX=1ˉX∫yx=0Pr{X>x}dxWP1

Como cheque, tenga en cuenta que esta integral está aumentando eny y se acerca a 1 comoy→∞. Obsérvese también que el valor esperado deY, calculado a partir de (4.28), viene dado porE[X2]/2ˉX, de acuerdo con (4.15).

El mismo argumento se puede aplicar a la distribución tiempo-promedio de la edad (ver Ejercicio 4.12). La fracción de tiempo promedio de tiempoFZ(z),, que la edad es como máximoz viene dada por

FZ(z)=1ˉX∫zx=0Pr{X>x}dxWP1

En el desarrollo hasta el momento, la función de recompensaR(t) ha sido una función únicamente de los intervalos de edad y duración, y la recompensa agregada sobre el enésimo intervalo inter-renovación es una función únicamente deXn. En situaciones más generales, donde el proceso de renovación está incrustado en algún proceso más complejo, a menudo es deseable definirR(t) depender de otros aspectos del proceso también. Lo importante aquí es{Rn;n≥1} que sea una secuencia IID. En la Sección 4.5.3 se describe cómo lograrlo y cómo se relaciona con los sistemas de colas. Teorema 4.4.1 claramente sigue siendo válido si{Rn;n≥1} es IID. Este tipo más general de función de renovación-recompensa será requerido y discutido más a fondo en las Secciones 4.5.3 a Rss7 donde discutimos el teorema de Little y el retraso de cola esperado M/G/1, ambos utilizan esta estructura más general.

Los promedios de tiempo limitantes a veces se visualizan mediante el siguiente tipo de experimento. Para algunos dado gran tiempot, dejarT ser una variable aleatoria uniformemente distribuida sobre(0,t];T es independiente del proceso de renovación-recompensa bajo consideración. Entonces(1/t)∫t0R(τ)dτ es el valor esperado (sobreT) deR(T) para una ruta de muestra dada de{R(τ);τ>0}. El teorema 4.4.1 establece que en el límitet→∞, todas las rutas de muestreo (excepto un conjunto de probabilidad 0) arrojan el mismo valor esperado sobreT. Este enfoque de ver un promedio de tiempo como una elección aleatoria de tiempo se conoce como incidencia aleatoria. La incidencia aleatoria es incómoda matemáticamente, ya que la variable aleatoriaT cambia con el tiempo generalt y no tiene límite razonable. También difumina la distinción entre tiempo y ensemble-promedios, por lo que no se utilizará en lo que sigue.

5∫t0Y(τ)dτ es un rv como cualquier otra función de un conjunto de rv. Tiene un valor de muestra para cada función de muestra de{N(t);t>0}, y su función de distribución podría calcularse de una manera sencilla pero tediosa. Para procesos estocásticos arbitrarios, la integración y diferenciación pueden requerir una gran sofisticación matemática, pero ninguna de esas sutilezas se presenta aquí.

6 Esto significa que seR(t) puede determinar en cualquierat de conocerZ(t) yX(t). No quiere decir queR(t) deba variar ya que se cambia cualquiera de esas cantidades. Así, por ejemplo,R(t) podría depender de solo uno de los dos o incluso podría ser una constante.

7 Ciertamente se pueden definir funcionesR(Z,X) para las cuales la integral en\ ref {4.19} es infinita o indefinida para algunos valores deXn, y asíRn se convierte en una rv defectuosa. Parece mejor manejar este tipo de situaciones cuando surge en lugar de manejarla en general.