3.5: Comportamiento, Lenguaje y Recursión

- Page ID

- 143765

El conductismo veía el lenguaje como un comportamiento meramente observable cuyo desarrollo y provocación estaba controlado por estímulos externos:

Un hablante posee un repertorio verbal en el sentido de que respuestas de diversas formas aparecen en su comportamiento de vez en cuando en relación con condiciones identificables. Un repertorio, como colección de operantes verbales, describe el comportamiento potencial de un hablante. Preguntar dónde está un operante verbal cuando una respuesta no está en el curso de ser emitida es como preguntar dónde está el instintivo cuando el médico no está golpeando el tendón rotuliano. (Skinner, 1957, p. 21)

El tratamiento del lenguaje por parte de Skinner (1957) como comportamiento verbal rechazó explícitamente la noción cartesiana de que el lenguaje expresaba ideas o significados. Para Skinner, las explicaciones del lenguaje que apelaban a estados internos tan inobservables eran necesariamente poco científicas:

Es función de una ficción explicativa disipar la curiosidad y poner fin a la indagación. La doctrina de las ideas ha tenido este efecto al parecer asignar importantes problemas de comportamiento verbal a una psicología de las ideas. Los problemas han parecido entonces ir más allá del alcance de las técnicas del estudiante de la lengua, o se han vuelto demasiado oscuros para rentabilizar más estudios. (Skinner, 1957, p. 7)

La lingüística moderna ha rechazado explícitamente el enfoque conductista, argumentando que el conductismo no puede dar cuenta de las ricas regularidades que gobiernan el lenguaje (Chomsky, 1959b).

La composición y producción de una enunciación no es estrictamente una cuestión de encadenar una secuencia de respuestas bajo el control de la estimulación externa y la asociación intraverbal, y que la organización sintáctica de una expresión no es algo directamente representado de manera simple en el estructura física de la propia enunciación. (Chomsky, 1959b, p. 55)

La lingüística moderna ha avanzado más allá de las teorías conductistas del comportamiento verbal al adoptar una forma particularmente técnica de logicismo. Los lingüistas asumen que el comportamiento verbal es el resultado de una sofisticada manipulación de símbolos: una gramática generativa interna.

Por gramática generativa me refiero simplemente a un sistema de reglas que de alguna manera explícita y bien definida asigna descripciones estructurales a las oraciones. Obviamente, cada hablante de un idioma ha dominado e interiorizado una gramática generativa que expresa su conocimiento de su idioma. (Chomsky, 1965, p. 8)

La descripción estructural de una oración se representa mediante el uso de un marcador de frase, que es una estructura de símbolo organizada jerárquicamente que puede ser creada por un conjunto recursivo de reglas llamado gramática libre de contexto. En una gramática generativa se utiliza otro tipo de regla, llamada transformación, para convertir un marcador de frase en otro.

Las gramáticas recursivas que se han desarrollado en la lingüística tienen dos propósitos. Primero, formalizan aspectos estructurales clave de los lenguajes humanos, como la incrustación de cláusulas dentro de las oraciones. En segundo lugar, explican cómo los recursos finitos son capaces de producir una infinita variedad de expresiones potenciales. Este último logro representa una refutación moderna al dualismo; hemos visto que Descartes (1996) utilizó el aspecto creativo del lenguaje para argumentar a favor de la existencia separada, no física de la mente. Para Descartes, las máquinas no eran capaces de generar lenguaje por su naturaleza finita.

Curiosamente, se dispone de una versión actual del análisis de Descartes (1996) de las limitaciones de las máquinas. Reconoce que existe una serie de diferentes dispositivos de procesamiento de información que varían en complejidad, y pregunta cuáles de estos dispositivos son capaces de acomodar gramáticas modernas y recursivas. La respuesta a esta pregunta proporciona evidencia adicional contra las teorías conductistas o asociacionistas del lenguaje (Bever, Fodor, & Garrett, 1968).

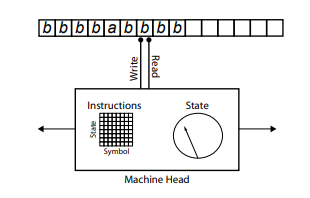

Figura 3-8. Cómo una máquina de Turing procesa su cinta.

En el capítulo 2, se nos presentó un dispositivo simple, pero muy potente, la máquina Turing (Figura 3-8). Consiste en un cabezal de máquina que manipula los símbolos en una cinta de ticker, donde la cinta de ticker se divide en celdas, y cada celda es capaz de contener solo un símbolo a la vez. El cabezal de la máquina puede moverse hacia adelante y hacia atrás a lo largo de la cinta, una celda a la vez. A medida que se mueve puede leer el símbolo en la celda actual, lo que puede hacer que el cabezal de la máquina cambie su estado físico. También es capaz de escribir un nuevo símbolo en la cinta. El comportamiento de la cabeza de la máquina —su nuevo estado físico, la dirección en la que se mueve, el símbolo que escribe—es controlado por una tabla de máquina que depende únicamente del símbolo actual que se está leyendo y del estado actual del dispositivo. Uno usa una máquina de Turing escribiendo una pregunta en su cinta y poniendo el cabezal de la máquina en acción. Cuando el cabezal de la máquina se detiene, la respuesta de la máquina Turing a la pregunta se ha escrito en la cinta.

¿Qué se entiende por la afirmación de que hay disponibles diferentes dispositivos de procesamiento de información? Significa que también deben existir sistemas que sean diferentes a las máquinas Turing. Una de esas alternativas a una máquina Turing se llama autómata de estado finito (Minsky, 1972; Parkes, 2002), que se ilustra en la Figura 3-9. Al igual que una máquina de Turing, un autómata de estado finito puede describirse como un cabezal de máquina que interactúa con una cinta de ticker. Hay dos diferencias clave entre una máquina de estado finito y una máquina Turing.

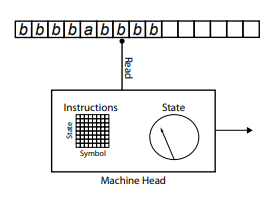

Figura 3-9. Cómo un autómata de estado finito procesa la cinta. Obsérvese las diferencias entre las Figuras 3-9 y 3-8.

Primero, una máquina de estado finito solo puede moverse en una dirección a lo largo de la cinta, nuevamente una celda a la vez. Segundo, una máquina de estado finito sólo puede leer los símbolos de la cinta; no escribe nuevos. Los símbolos que encuentra, en combinación con el estado físico actual del dispositivo, determinan el nuevo estado físico del dispositivo. Nuevamente, se escribe una pregunta en la cinta, y se inicia el autómata de estado finito. Cuando llega al final de la pregunta, el estado físico final del autómata de estado finito representa su respuesta a la pregunta original en la cinta.

Es obvio que un autómata de estado finito es un dispositivo más simple que una máquina Turing, porque no puede cambiar la cinta de ticker, y porque solo puede moverse en una dirección a lo largo de la cinta. Sin embargo, las máquinas de estado finito son importantes procesadores de información. Muchos de los comportamientos de la robótica basada en el comportamiento se producen utilizando máquinas de estado finito (Brooks, 1989, 1999, 2002). También se ha argumentado que tales dispositivos son todo lo que se requiere para formalizar relatos conductistas o asociacionistas de comportamiento (Bever, Fodor, & Garrett., 1968).

¿Qué se entiende por la afirmación de que un dispositivo de procesamiento de información puede “acomodar” una gramática? En el análisis formal de las capacidades de los procesadores de información (Gold, 1967), hay dos respuestas a esta pregunta. Supongamos que el conocimiento de alguna gramática se ha incorporado en el cabezal de la máquina de un dispositivo. Entonces se podría preguntar si el dispositivo es capaz de aceptar una gramática. En este caso, la “pregunta” en la cinta sería una expresión, y la tarea del procesador de información sería aceptar la cadena, si es gramatical según la gramática del dispositivo, o rechazar la expresión, si no pertenece a la gramática. Otra pregunta que hacer sería si el procesador de información es capaz de generar la gramática. Es decir, dada una expresión gramatical, ¿puede el dispositivo utilizar su gramática existente para replicar la expresión (Wexler & Culicover, 1980)?

En el Capítulo 2, se argumentó que un nivel de investigación a realizar por la ciencia cognitiva era computacional. A nivel computacional de análisis, se utilizan métodos formales para investigar los tipos de problemas de procesamiento de información que un dispositivo está resolviendo. Cuando se utilizan métodos formales para determinar si algún dispositivo es capaz de aceptar o generar alguna gramática de interés, se está realizando una investigación a nivel computacional.

Un ejemplo famoso de tal análisis computacional fue proporcionado por Bever, Fodor y Garrett (1968). Preguntaron si un autómata de estado finito era capaz de aceptar expresiones que se construían a partir de una gramática artificial particular. Las expresiones construidas a partir de esta gramática se construyeron a partir de solo dos símbolos, a y b. Las cadenas gramaticales en la oración eran “imágenes especulares”, porque el patrón utilizado para generar expresiones era b N ab N donde N es el número de bs en la cadena. Las expresiones válidas generadas a partir de esta gramática incluyen a, bbbbabbbb y bbabb. Las expresiones que no se pueden generar a partir de la gramática incluyen ab, babb, bb y bbbabb.

Si bien esta gramática artificial es muy sencilla, tiene una propiedad importante: es recursiva. Es decir, se puede definir una gramática simple y libre de contexto para generar sus expresiones potenciales. Esta gramática libre de contexto consta de dos reglas, donde la Regla 1 es S → a, y la Regla 2 es un → bab. Una cadena se inicia usando la Regla 1 para generar una a. La regla 2 se puede aplicar entonces para generar la cadena bab. Si la Regla 2 se aplica recursivamente al bab central entonces se producirán expresiones más largas que siempre serán consistentes con el patrón b N ab N.

Bever, Fodor y Garrett (1968) demostraron que un autómata de estado finito no era capaz de aceptar cadenas generadas a partir de esta gramática recursiva. Esto se debe a que una máquina de estado finito solo puede moverse en una dirección a lo largo de la cinta y no puede escribir en la cinta. Si comienza en el primer símbolo de una cadena, entonces no es capaz de realizar un seguimiento del número de bs leídos antes de la a, y compararlo con el número de bs leídos después de la a. debido a que no puede ir hacia atrás a lo largo de la cinta, no puede tratar con lenguajes recursivos que tienen estructura clausal incrustada.

Bever, Fodor y Garrett (1968) utilizaron este resultado para concluir que el asociacionismo (y el conductismo radical) no era lo suficientemente poderoso como para hacer frente a las cláusulas incrustadas del lenguaje humano natural. En consecuencia, argumentaron que el asociacionismo debe ser abandonado como teoría de la mente. El impacto de esta prueba se mide por las largas respuestas a este argumento por parte de investigadores asociacionistas de la memoria (Anderson & Bower, 1973; Paivio, 1986). Volvemos a las implicaciones de este argumento cuando discutimos la ciencia cognitiva conexionista en el Capítulo 4.

Si bien los autómatas de estado finito no pueden aceptar la gramática recursiva utilizada por Bever, Fodor y Garrett (1968), las máquinas Turing pueden (Révész, 1983). Su capacidad para moverse en ambas direcciones a lo largo de la cinta les proporciona una memoria que les permite hacer coincidir el número de bs iniciales en una cadena con el número de bs finales.

La lingüística moderna ha concluido que la estructura del lenguaje humano debe ser descrita por gramáticas recursivas. Los autómatas de estado finito no son poderossuficientes dispositivos para acomodar gramáticas de esta naturaleza, pero las máquinas Turing lo son. Esto sugiere que una arquitectura de procesamiento de información que sea lo suficientemente rica para explicar la cognición humana debe tener el mismo poder, debe ser capaz de responder al mismo conjunto de preguntas, como lo hacen las máquinas Turing. Esta es la esencia de la hipótesis del sistema de símbolos físicos (Newell, 1980), que se discuten con más detalle a continuación. La máquina de Turing, como vimos en el Capítulo 2 y discutimos más adelante, es una máquina universal, y la ciencia cognitiva clásica plantea la hipótesis de que “esta noción de sistema de símbolos resultará adecuada para toda la actividad simbólica que este universo físico nuestro puede exhibir, y en particular toda la simbólica actividades de la mente humana” (Newell, 1980, p. 155).