5.4: Audiencia

- Page ID

- 149269

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\( \newcommand{\dsum}{\displaystyle\sum\limits} \)

\( \newcommand{\dint}{\displaystyle\int\limits} \)

\( \newcommand{\dlim}{\displaystyle\lim\limits} \)

\( \newcommand{\id}{\mathrm{id}}\) \( \newcommand{\Span}{\mathrm{span}}\)

( \newcommand{\kernel}{\mathrm{null}\,}\) \( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\) \( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\) \( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\id}{\mathrm{id}}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\kernel}{\mathrm{null}\,}\)

\( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\)

\( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\)

\( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\) \( \newcommand{\AA}{\unicode[.8,0]{x212B}}\)

\( \newcommand{\vectorA}[1]{\vec{#1}} % arrow\)

\( \newcommand{\vectorAt}[1]{\vec{\text{#1}}} % arrow\)

\( \newcommand{\vectorB}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vectorC}[1]{\textbf{#1}} \)

\( \newcommand{\vectorD}[1]{\overrightarrow{#1}} \)

\( \newcommand{\vectorDt}[1]{\overrightarrow{\text{#1}}} \)

\( \newcommand{\vectE}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash{\mathbf {#1}}}} \)

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\(\newcommand{\avec}{\mathbf a}\) \(\newcommand{\bvec}{\mathbf b}\) \(\newcommand{\cvec}{\mathbf c}\) \(\newcommand{\dvec}{\mathbf d}\) \(\newcommand{\dtil}{\widetilde{\mathbf d}}\) \(\newcommand{\evec}{\mathbf e}\) \(\newcommand{\fvec}{\mathbf f}\) \(\newcommand{\nvec}{\mathbf n}\) \(\newcommand{\pvec}{\mathbf p}\) \(\newcommand{\qvec}{\mathbf q}\) \(\newcommand{\svec}{\mathbf s}\) \(\newcommand{\tvec}{\mathbf t}\) \(\newcommand{\uvec}{\mathbf u}\) \(\newcommand{\vvec}{\mathbf v}\) \(\newcommand{\wvec}{\mathbf w}\) \(\newcommand{\xvec}{\mathbf x}\) \(\newcommand{\yvec}{\mathbf y}\) \(\newcommand{\zvec}{\mathbf z}\) \(\newcommand{\rvec}{\mathbf r}\) \(\newcommand{\mvec}{\mathbf m}\) \(\newcommand{\zerovec}{\mathbf 0}\) \(\newcommand{\onevec}{\mathbf 1}\) \(\newcommand{\real}{\mathbb R}\) \(\newcommand{\twovec}[2]{\left[\begin{array}{r}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\ctwovec}[2]{\left[\begin{array}{c}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\threevec}[3]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\cthreevec}[3]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\fourvec}[4]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\cfourvec}[4]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\fivevec}[5]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\cfivevec}[5]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\mattwo}[4]{\left[\begin{array}{rr}#1 \amp #2 \\ #3 \amp #4 \\ \end{array}\right]}\) \(\newcommand{\laspan}[1]{\text{Span}\{#1\}}\) \(\newcommand{\bcal}{\cal B}\) \(\newcommand{\ccal}{\cal C}\) \(\newcommand{\scal}{\cal S}\) \(\newcommand{\wcal}{\cal W}\) \(\newcommand{\ecal}{\cal E}\) \(\newcommand{\coords}[2]{\left\{#1\right\}_{#2}}\) \(\newcommand{\gray}[1]{\color{gray}{#1}}\) \(\newcommand{\lgray}[1]{\color{lightgray}{#1}}\) \(\newcommand{\rank}{\operatorname{rank}}\) \(\newcommand{\row}{\text{Row}}\) \(\newcommand{\col}{\text{Col}}\) \(\renewcommand{\row}{\text{Row}}\) \(\newcommand{\nul}{\text{Nul}}\) \(\newcommand{\var}{\text{Var}}\) \(\newcommand{\corr}{\text{corr}}\) \(\newcommand{\len}[1]{\left|#1\right|}\) \(\newcommand{\bbar}{\overline{\bvec}}\) \(\newcommand{\bhat}{\widehat{\bvec}}\) \(\newcommand{\bperp}{\bvec^\perp}\) \(\newcommand{\xhat}{\widehat{\xvec}}\) \(\newcommand{\vhat}{\widehat{\vvec}}\) \(\newcommand{\uhat}{\widehat{\uvec}}\) \(\newcommand{\what}{\widehat{\wvec}}\) \(\newcommand{\Sighat}{\widehat{\Sigma}}\) \(\newcommand{\lt}{<}\) \(\newcommand{\gt}{>}\) \(\newcommand{\amp}{&}\) \(\definecolor{fillinmathshade}{gray}{0.9}\)Nuestro sistema auditivo convierte las ondas de presión en sonidos significativos. Esto se traduce en nuestra capacidad de escuchar los sonidos de la naturaleza, de apreciar la belleza de la música y de comunicarnos entre nosotros a través del lenguaje hablado. En esta sección se brindará una visión general de la anatomía básica y la función del sistema auditivo. Incluirá una discusión sobre cómo el estímulo sensorial se traduce en impulsos neuronales, dónde en el cerebro se procesa esa información, cómo percibimos el tono y cómo sabemos de dónde viene el sonido.

Anatomía del Sistema Auditivo

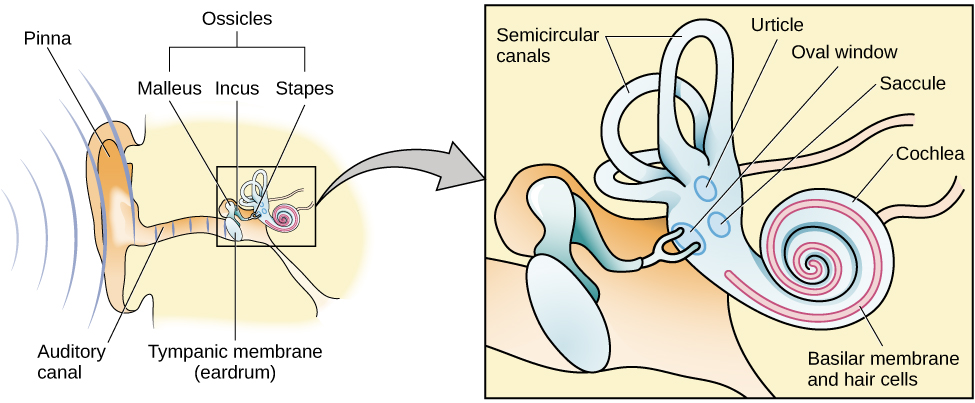

La oreja se puede separar en múltiples secciones. El oído externo incluye el pabellón auricular, que es la parte visible del oído que sobresale de nuestras cabezas, el canal auditivo y la membrana timpánica, o tímpano. El oído medio contiene tres huesos diminutos conocidos como los huesecillos, que se llaman el malleo (o martillo), el incus (o yunque) y el estribo (o estribo). El oído interno contiene los canales semicirculares, que intervienen en el equilibrio y el movimiento (el sentido vestibular), y la cóclea. La cóclea es una estructura llena de líquido, en forma de caracol que contiene las células receptoras sensoriales (células ciliadas) del sistema auditivo (Figura 5.18).

Las ondas sonoras viajan a lo largo del canal auditivo y golpean la membrana timpánica, provocando que vibre. Esta vibración da como resultado el movimiento de los tres huesecillos. A medida que los huesecillos se mueven, el estribo presiona en una fina membrana de la cóclea conocida como ventana ovalada. A medida que el estribo presiona hacia la ventana ovalada, el líquido dentro de la cóclea comienza a moverse, lo que a su vez estimula las células ciliadas, que son células receptoras auditivas del oído interno incrustadas en la membrana basilar. La membrana basilar es una delgada tira de tejido dentro de la cóclea.

La activación de las células ciliadas es un proceso mecánico: la estimulación de la célula pilosa finalmente conduce a la activación de la célula. A medida que las células ciliadas se activan, generan impulsos neuronales que viajan a lo largo del nervio auditivo hasta el cerebro. La información auditiva se traslada al colículo inferior, al núcleo geniculado medial del tálamo y finalmente a la corteza auditiva en el lóbulo temporal del cerebro para su procesamiento. Al igual que el sistema visual, también hay evidencia que sugiere que la información sobre el reconocimiento auditivo y la localización se procesa en corrientes paralelas (Rauschecker & Tian, 2000; Renier et al., 2009).

Percepción de tono

Diferentes frecuencias de ondas sonoras están asociadas con diferencias en nuestra percepción del tono de esos sonidos. Los sonidos de baja frecuencia son de tono más bajo y los sonidos de alta frecuencia son de tono más alto. ¿Cómo se diferencia el sistema auditivo entre varios tonos?

Se han propuesto varias teorías para dar cuenta de la percepción del tono. Aquí discutiremos dos de ellos: teoría temporal y teoría de lugar. La teoría temporal de la percepción del tono afirma que la frecuencia está codificada por el nivel de actividad de una neurona sensorial. Esto significaría que una célula pilosa dada dispararía potenciales de acción relacionados con la frecuencia de la onda sonora. Si bien esta es una explicación muy intuitiva, detectamos un rango de frecuencias tan amplio (20—20,000 Hz) que la frecuencia de los potenciales de acción disparados por las células ciliadas no puede dar cuenta de todo el rango. Debido a las propiedades relacionadas con los canales de sodio en la membrana neuronal que están involucrados en los potenciales de acción, hay un punto en el que una célula no puede disparar más rápido (Shamma, 2001).

La teoría del lugar de la percepción de tono sugiere que diferentes partes de la membrana basilar son sensibles a sonidos de diferentes frecuencias. Más específicamente, la base de la membrana basilar responde mejor a las altas frecuencias y la punta de la membrana basilar responde mejor a las frecuencias bajas. Por lo tanto, las células ciliadas que están en la porción base serían etiquetadas como receptores de alto tono, mientras que las de la punta de la membrana basilar serían etiquetadas como receptores de tono bajo (Shamma, 2001).

En realidad, ambas teorías explican diferentes aspectos de la percepción del tono. A frecuencias de hasta cerca de 4000 Hz, es claro que tanto la tasa de potenciales de acción como el lugar contribuyen a nuestra percepción del tono. Sin embargo, los sonidos de frecuencia mucho más alta solo pueden codificarse usando señales de lugar (Shamma, 2001).

Localización de sonido

La capacidad de ubicar el sonido en nuestros entornos es una parte importante de la audición. La localización del sonido podría considerarse similar a la forma en que percibimos la profundidad en nuestros campos visuales. Al igual que las señales monoculares y binoculares que proporcionaron información sobre la profundidad, el sistema auditivo utiliza señales monoaurales (de una oreja) y binaurales (de dos orejas) para localizar el sonido.

Cada pabellón interactúa con las ondas sonoras entrantes de manera diferente, dependiendo de la fuente del sonido en relación con nuestros cuerpos. Esta interacción proporciona una señal monoaural que es útil para localizar sonidos que ocurren por encima o por debajo y delante o detrás de nosotros. Las ondas sonoras recibidas por tus dos oídos de sonidos que vienen directamente de arriba, abajo, delante o detrás de ti serían idénticas; por lo tanto, las señales monoaurales son esenciales (Grothe, Pecka, & McAlpine, 2010).

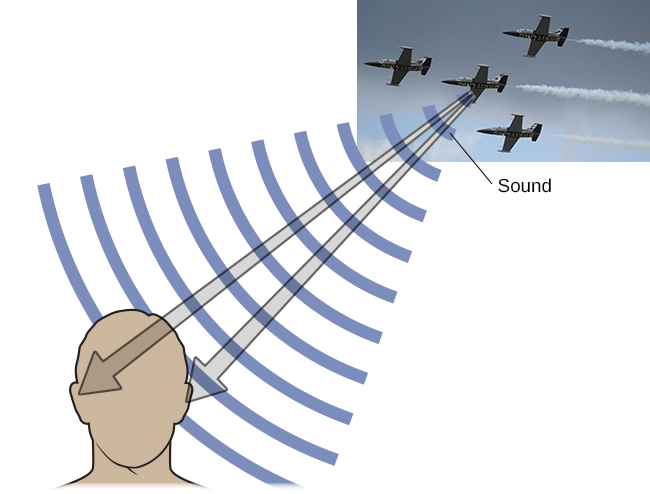

Las señales binaurales, por otro lado, proporcionan información sobre la ubicación de un sonido a lo largo de un eje horizontal al basarse en diferencias en los patrones de vibración del tímpano entre nuestros dos oídos. Si un sonido proviene de una ubicación descentrada, crea dos tipos de señales binaurales: diferencias de nivel interaural y diferencias de tiempo interaural. La diferencia de nivel interaural se refiere al hecho de que un sonido proveniente del lado derecho de tu cuerpo es más intenso en tu oído derecho que en tu oído izquierdo debido a la atenuación de la onda sonora a medida que pasa por tu cabeza. La diferencia de tiempo interaural se refiere a la pequeña diferencia en el tiempo en el que una onda sonora dada llega a cada oído (Figura 5.19). Ciertas áreas cerebrales monitorean estas diferencias para construir donde a lo largo de un eje horizontal se origina un sonido (Grothe et al., 2010).

Pérdida Auditiva

La sordera es la incapacidad parcial o completa de escuchar. Algunas personas nacen sin oír, lo que se conoce como sordera congénita. Otras personas sufren de pérdida auditiva conductiva, que se debe a un problema al entregar energía sonora a la cóclea. Las causas de la pérdida auditiva conductiva incluyen el bloqueo del canal auditivo, un orificio en la membrana timpánica, problemas con los huesecillos o líquido en el espacio entre el tímpano y la cóclea. Otro grupo de personas sufre de pérdida auditiva neurosensorial, que es la forma más común de pérdida auditiva. La pérdida auditiva neurosensorial puede ser causada por muchos factores, como el envejecimiento, traumatismos craneales o acústicos, infecciones y enfermedades (como el sarampión o las paperas), medicamentos, efectos ambientales como la exposición al ruido (pérdida auditiva inducida por ruido, como se muestra en la Figura 5.20), tumores y toxinas ( como los que se encuentran en ciertos solventes y metales).

Dada la naturaleza mecánica por la que el estímulo de onda sonora se transmite desde el tímpano a través de los huesecillos hasta la ventana oval de la cóclea, es inevitable cierto grado de pérdida auditiva. Con la pérdida auditiva conductiva, los problemas auditivos se asocian con una falla en la vibración del tímpano y/o movimiento de los huesecillos. Estos problemas a menudo se tratan a través de dispositivos como audífonos que amplifican las ondas sonoras entrantes para hacer que sea más probable que se produzca la vibración del tímpano y el movimiento de los huesecillos.

Cuando el problema auditivo se asocia con una falta de transmisión de señales neuronales desde la cóclea al cerebro, se denomina pérdida auditiva neurosensorial. Una enfermedad que resulta en hipoacusia neurosensorial es la enfermedad de Ménière. Aunque no se entiende bien, la enfermedad de Ménière resulta en una degeneración de las estructuras del oído interno que puede conducir a pérdida auditiva, tinnitus (zumbido o zumbido constante), vértigo (sensación de giro) y un aumento de la presión dentro del oído interno (Semaan & Megerian, 2011). Este tipo de pérdida no se puede tratar con audífonos, pero algunos individuos podrían ser candidatos a un implante coclear como opción de tratamiento. Los implantes cocleares son dispositivos electrónicos que consisten en un micrófono, un procesador de voz y una matriz de electrodos. El dispositivo recibe información sonora entrante y estimula directamente el nervio auditivo para que transmita información al cerebro.

En Estados Unidos y en otros lugares del mundo, las personas sordas tienen su propio idioma, escuelas y costumbres. A esto se le llama cultura sorda. En Estados Unidos, las personas sordas a menudo se comunican usando el lenguaje de señas americano (ASL); ASL no tiene componente verbal y se basa completamente en signos y gestos visuales. El modo primario de comunicación es la firma. Uno de los valores de la cultura sorda es continuar tradiciones como usar el lenguaje de señas en lugar de enseñar a los niños sordos a tratar de hablar, leer los labios o someterse a una cirugía de implante coclear.

Cuando un niño es diagnosticado como sordo, los padres tienen decisiones difíciles de tomar. ¿Se debe inscribir al niño en las escuelas ordinarias y enseñarle a verbalizar y leer los labios? ¿O se debe enviar al niño a una escuela para que los niños sordos aprendan ASL y tengan una exposición significativa a la cultura sorda? ¿Crees que podría haber diferencias en la forma en que los padres abordan estas decisiones dependiendo de si también son sordos o no?