5: Valores propios y vectores propios

( \newcommand{\kernel}{\mathrm{null}\,}\)

Resolver la ecuación matricialAx=λx.

Este capítulo constituye el núcleo de cualquier primer curso sobre álgebra lineal: los valores propios y los vectores propios juegan un papel crucial en la mayoría de las aplicaciones del mundo real del tema.

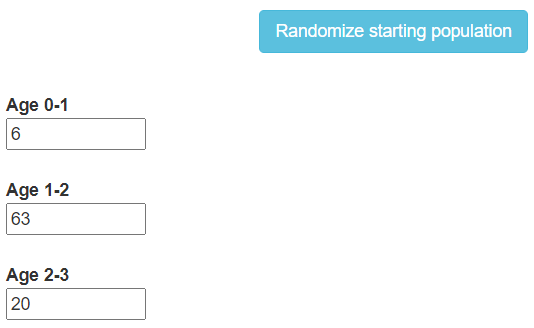

En una población de conejos,

- la mitad de los conejos recién nacidos sobreviven a su primer año;

- de ellos, la mitad sobrevive a su segundo año;

- la vida útil máxima es de tres años;

- los conejos producen 0, 6, 8 conejos bebés en su primer, segundo y tercer año, respectivamente.

¿Cuál es el comportamiento asintótico de este sistema? ¿Cómo será la población de conejos en 100 años?

En la Sección 5.1, definiremos valores propios y vectores propios, y mostraremos cómo computar estos últimos; en la Sección 5.2 aprenderemos a computar los primeros. En la Sección 5.3 se introduce la noción de matrices similares y se demuestra que las matrices similares se comportan de manera similar. En la Sección 5.4 estudiamos matrices que son similares a las matrices diagonales y en la Sección 5.5 estudiamos matrices que son similares a las matrices de escala de rotación, obteniendo así una comprensión geométrica sólida de grandes clases de matrices. Finalmente, pasamos la Sección 5.6 presentando un tipo común de aplicación de valores propios y vectores propios a problemas del mundo real, incluida la búsqueda en Internet utilizando el algoritmo PageRank de Google.

- 5.1: Valores propios y vectores propios

- En esta sección, definimos valores propios y vectores propios. Estos forman la faceta más importante de la teoría de la estructura de las matrices cuadradas. Como tal, los valores propios y los vectores propios tienden a desempeñar un papel clave en las aplicaciones de la vida real del álgebra lineal.

- 5.2: El polinomio característico

- En la Sección 1 discutimos cómo decidir si un número dado λ es un valor propio de una matriz, y si es así, cómo encontrar todos los vectores propios asociados. En esta sección, daremos un método para computar todos los valores propios de una matriz. Esto no reduce a resolver un sistema de ecuaciones lineales: de hecho, requiere resolver una ecuación no lineal en una variable, es decir, encontrar las raíces del polinomio característico.

- 5.4: Diagonalización

- Las matrices diagonales son el tipo de matrices más fáciles de entender: simplemente escalan las direcciones de coordenadas por sus entradas diagonales. Esta sección está dedicada a la pregunta: “¿Cuándo es una matriz similar a una matriz diagonal?” Esta sección está dedicada a la pregunta: “¿Cuándo es una matriz similar a una matriz diagonal?” Veremos que el álgebra y geometría de tal matriz es relativamente fácil de entender.

- 5.5: Valores propios complejos

- Una matriz n×n cuyo polinomio característico tiene n raíces reales distintas es diagonalizable: es similar a una matriz diagonal, que es mucho más simple de analizar. La otra posibilidad es que una matriz tenga raíces complejas, y ese es el foco de esta sección. Resulta que dicha matriz es similar (en el caso 2×2) a una matriz de escala de rotación, que también es relativamente fácil de entender.

- 5.6: Matrices Estocásticas

- Esta sección está dedicada a un tipo común de aplicación de los valores propios: al estudio de ecuaciones de diferencia, en particular a las cadenas de Markov. Introduciremos matrices estocásticas, que codifican este tipo de ecuaciones de diferencia, y cubriremos en detalle el ejemplo más famoso de una matriz estocástica: la Matriz de Google.

- 5.3: Similaridad

- En esta sección, estudiamos en detalle la situación cuando dos matrices se comportan de manera similar con respecto a diferentes sistemas de coordenadas. En la Sección 5.4 y la Sección 5.5, mostraremos cómo usar valores propios y vectores propios para encontrar una matriz más simple que se comporte como una matriz dada.